ChatGPT جیسے ماڈلز روزمرہ کی زندگی کا حصہ بننے سے پہلے، AI سسٹمز ٹیکسٹ بنانے میں ناقابل یقین حد تک ماہر ہو چکے تھے۔ تاہم، اب بھی بڑی حدود موجود تھیں۔ زیادہ تر ماڈل صرف وہ کام انجام دے سکتے تھے جن کے لیے انہیں خاص طور پر تربیت دی گئی تھی۔

اگر آپ متن کا ترجمہ کرنے، مضمون کا خلاصہ کرنے، یا کسی سوال کا جواب دینے کے لیے ماڈل چاہتے ہیں، تو آپ کو عام طور پر لیبل لگا ڈیٹا اکٹھا کرنا ہوگا اور ہر کام کے لیے اسے الگ سے تربیت دینا ہوگی۔ AI طاقتور تھا، لیکن پھر بھی دائرہ کار میں بہت تنگ تھا۔

پھر GPT-2 نے ایک مختلف خیال پیش کیا۔

ماڈل کو ہر کام کو انفرادی طور پر سکھانے کے بجائے، محققین نے تحقیق کی کہ آیا ماڈل کو صرف انٹرنیٹ ٹیکسٹ کی بڑی مقدار میں اگلے لفظ کی پیشن گوئی کرنے کی تربیت دینا خود ہی مفید صلاحیتوں کو کھول سکتا ہے۔

اور حیرت انگیز طور پر، اس نے کام کیا.

ماڈل عام ہونے کی ابتدائی علامات دکھانا شروع کر رہا ہے۔ آپ سوالات کے جواب دے سکتے ہیں، متن کا خلاصہ کر سکتے ہیں، زبانوں کے درمیان ترجمہ کر سکتے ہیں، اور اشارے مکمل کر سکتے ہیں۔ یہ سب کام کی مخصوص تربیت کے بغیر یا نیچے دھارے کے کاموں کو ٹھیک کرنے کے بغیر پورا کیا جا سکتا ہے۔

اب، ان نئے خیالات کو متعارف کرانے والے تحقیقی مقالے پڑھنا مشکل اور وقت طلب ہو سکتا ہے۔ خاص طور پر جب وہ تکنیکی اصطلاحات اور تجرباتی تفصیلات سے بھرے ہوں۔ لہذا، اس مضمون میں، میں ایک سادہ اور عملی طریقے سے کاغذ کو توڑوں گا.

ہم دیکھیں گے کہ یہ مقالہ کس مسئلے کو حل کرنے کی کوشش کر رہا تھا، GPT-2 کے بنیادی خیالات، زیرو شاٹ لرننگ کیسے کام کرتی ہے، اور یہ پیپر جدید بڑے پیمانے پر لینگویج ماڈلز کی جانب ایک اہم قدم کیوں ہے۔

آخر میں، آپ کو پوری دستاویز کو خود پڑھے بغیر GPT-2 کی اہم بصیرت کو سمجھنا چاہیے۔

مقالہ کا خاکہ

اس مضمون میں، ہم کاغذ کا جائزہ لیں گے. زبان کے ماڈل غیر زیر نگرانی ملٹی ٹاسک سیکھنے والے ہیں۔ مصنفین: ایلک ریڈفورڈ، جیفری وو، ریون چائلڈ، ڈیوڈ لوان، ڈاریو آمودی، اور الیا سوٹسکیور۔

اس مقالے نے GPT-2 کو متعارف کرایا اور یہ دکھایا کہ کس طرح متن کی بڑی مقدار پر تربیت یافتہ زبان کے ماڈل ٹاسک مخصوص تربیت کے بغیر متعدد کام انجام دے سکتے ہیں۔

اگر آپ اسے خود پڑھنا چاہتے ہیں تو اصل کاغذ یہ ہے:

زبان کے ماڈل غیر زیر نگرانی ملٹی ٹاسکنگ سیکھنے والے ہیں (PDF)

یہاں ایک فوری انفوگرافک ہے جس کا ہم اس جائزے میں احاطہ کریں گے:

اشاریہ:

شرائط

اس تجزیہ سے زیادہ سے زیادہ فائدہ اٹھانے کے لیے، چند بنیادی خیالات سے واقف ہونا مفید ہے:

اگر آپ ان سب سے پوری طرح واقف نہیں ہیں تو یہ ٹھیک ہے۔ میں وضاحت کو ہر ممکن حد تک آسان اور بدیہی رکھوں گا۔ میں تکنیکی تفصیلات میں کھو جانے کے بجائے خیال کو سمجھنے پر زیادہ توجہ دوں گا۔

خلاصہ

GPT-2 سے پہلے، زیادہ تر NLP نظام زیر نگرانی سیکھنے پر بہت زیادہ انحصار کرتے تھے۔ ہر کام – ترجمہ، سوال کا جواب، خلاصہ – عام طور پر اس کا اپنا لیبل لگا ڈیٹاسیٹ اور اس کے لیے خاص طور پر تربیت یافتہ ماڈل کی ضرورت ہوتی ہے۔

یہ کاغذ اس نقطہ نظر کو چیلنج کرتا ہے۔

مصنفین کے مطابق، متن کے ایک سیٹ میں اگلے لفظ کی پیشن گوئی کرنے کے لیے تربیت یافتہ ایک ہی بڑی زبان کا ماڈل ٹاسک مخصوص تربیت کے بغیر مختلف قسم کے کام انجام دینا سیکھ سکتا ہے۔

ہر مسئلہ کو حل کرنے کا طریقہ واضح طور پر سکھائے جانے کے بجائے، ماڈل ڈیٹا میں موجود نمونوں سے ان صلاحیتوں کو چنتا ہے۔

سیدھے الفاظ میں، ماڈلز کو ترجمہ کرنے، سوالات کے جواب دینے، یا خلاصہ کرنے کے لیے براہ راست تربیت نہیں دی جاتی ہے۔ بلکہ، ہم یہ سیکھتے ہیں کہ متن کی بڑی مقدار کی نمائش کے ذریعے ان کاموں کو واضح طور پر کیسے انجام دیا جائے۔

یہ ایک اہم تبدیلی کی نشاندہی کرتا ہے۔ ہر کام کے لیے زیر نگرانی سیکھنے پر انحصار کرنے کے بجائے، یہ مقالہ ظاہر کرتا ہے کہ ماڈل تمام کاموں کو عام کرنا شروع کر سکتا ہے جسے اب زیرو شاٹ سیٹنگ کے نام سے جانا جاتا ہے۔

کاغذ کا مقصد

اس کام کے محرک کو سمجھنے کے لیے، موجودہ NLP سسٹمز کی حدود کو دیکھنا مفید ہے۔

مصنفین کے مطابق، زیادہ تر موجودہ نقطہ نظر لیبل لگے ہوئے ڈیٹاسیٹس پر بہت زیادہ انحصار کرتے ہیں، ہر کام کے لیے علیحدہ تربیت کی ضرورت ہوتی ہے، اور اس مخصوص مسئلے کو عام کرنے کے لیے جدوجہد کرتے ہیں جس کے لیے وہ ڈیزائن کیے گئے تھے۔

عملی طور پر، یہ نظام کو طاقتور بناتا ہے لیکن دائرہ کار میں تنگ ہے۔ یعنی، یہ ان مضامین میں اچھی کارکردگی کا مظاہرہ کرتا ہے جن کے لیے اسے تربیت دی جاتی ہے، لیکن اس علم کو آسانی سے دوسروں تک منتقل نہیں کرتا۔

یہ مقالہ ایک مختلف سمت تلاش کرتا ہے۔

مصنفین پوچھتے ہیں کہ آیا ایک ماڈل واضح نگرانی کے بغیر ایک سے زیادہ کام کرنا سیکھ سکتا ہے، محض متن کی بڑی مقدار سیکھ کر۔

ہم یہ بھی تحقیق کرتے ہیں کہ کیا صرف زبان کی ماڈلنگ عام خصوصیات کو حاصل کرنے کے لیے کافی ہے اور کیا ماڈل کے سائز اور ڈیٹا کے حجم میں اضافہ اس طرز عمل کو بہتر بنا سکتا ہے۔

کلید یہ ہے کہ ایک زیادہ عام نظام کی طرف جانا ہے جو احتیاط سے لیبل لگائے گئے ڈیٹاسیٹس کی بجائے خود زبان سے سیکھتا ہے۔

بنیادی خیال

کاغذ کا بنیادی حصہ ایک سادہ لیکن طاقتور خیال ہے۔ یعنی، ماڈل کو روایتی نگرانی کے انداز میں تربیت دینے کے بجائے (ان پٹ کو براہ راست آؤٹ پٹس پر نقشہ بنانا)، مصنفین ماڈل کو صرف ایک کام کرنے کی تربیت دیتے ہیں: متن کے سیٹ میں اگلے لفظ کی پیش گوئی کریں۔

سب سے پہلے، یہ محدود لگ سکتا ہے. تاہم، ایک اہم بصیرت یہ ہے کہ قدرتی زبان پہلے سے ہی اس کے اندر موجود کارروائیوں کی بہت سی مثالوں پر مشتمل ہے۔

انٹرنیٹ پر متن میں سوالات اور جوابات، زبانوں کے درمیان ترجمہ، طویل مواد کے خلاصے، اور تفصیلی وضاحتیں شامل ہیں۔

کاغذ کے مطابق، ماڈل بالواسطہ طور پر یہ سیکھتا ہے کہ یہ کام کیسے کام کرتے ہیں یہ سیکھ کر کہ متن کی پیشن گوئی اور تخلیق کیسے کی جاتی ہے۔ دوسرے لفظوں میں، ہم اس طرح کے رشتے کی ماڈلنگ شروع کرتے ہیں: p(آؤٹ پٹ | ان پٹ، ایکشن) آپ کو واضح طور پر بتائے بغیر کہ کام کیا ہے۔

یہ ماڈل کو ایک مقصد سے آگے جانے اور ایک باقاعدہ نظام کی طرح برتاؤ کرنے کی اجازت دیتا ہے۔

طریقہ کار

یہ سمجھنے کے لیے کہ یہ آئیڈیا عملی طور پر کیسے کام کرتا ہے، یہ دیکھنے میں مدد کرتا ہے کہ ماڈل کی تربیت کیسے کی جاتی ہے۔

مصنفین کے مطابق، یہ سب معیاری زبان کے ماڈلنگ کے اہداف سے شروع ہوتا ہے۔

ماڈل کو پچھلے ٹوکن کی بنیاد پر ایک ترتیب میں اگلے ٹوکن کی پیشن گوئی کرنے کی تربیت دی جاتی ہے۔

یہ سادہ لگ سکتا ہے، لیکن یہ ماڈل کو وقت کے ساتھ ساتھ زبان کی بنیادی ساخت سیکھنے کی اجازت دیتا ہے۔

رسمی طور پر، اس کا مطلب ہے کہ ماڈل متن کی ترتیب کے امکانات سیکھ رہا ہے۔ درحقیقت، یہ صلاحیت ہمیں مربوط متن، مکمل جملے، اور یہاں تک کہ تقلید کے نمونے تیار کرنے کی اجازت دیتی ہے جو مخصوص کاموں سے مشابہت رکھتے ہوں۔

یہ وہی ہے جو نقطہ نظر کو اتنا طاقتور بناتا ہے۔ ماڈل کو اگلے لفظ کی پیشن گوئی کرنے کے لیے تربیت دی جاتی ہے، لیکن اس کے نتیجے میں بہت زیادہ امیر سلوک ہوتا ہے جسے مختلف کاموں پر لاگو کیا جا سکتا ہے۔

زیرو شاٹ کی ترتیبات

پچھلے طریقوں سے سب سے اہم فرق یہ ہے کہ تربیت کے بعد ماڈل کو کس طرح استعمال کیا جاتا ہے۔

GPT-1 کے برعکس، کوئی فائن ٹیوننگ یا ٹاسک مخصوص تربیت نہیں ہے۔ ماڈل کو ہر نئے کام کے لیے ڈھال یا دوبارہ تربیت نہیں دی جاتی ہے۔ اس کے بجائے، ہر چیز کو ان پٹ کے ذریعے ہی پروسیس کیا جاتا ہے۔

مصنفین کے مطابق، کاموں کا اظہار براہ راست متن کے اشارے میں کیا جاتا ہے۔ مثال کے طور پر، آپ "فرانسیسی میں ترجمہ کریں:” کے بعد کوئی جملہ لکھ سکتے ہیں یا "سوال کا جواب دیں:” کے بعد ایک پرامپٹ لکھ سکتے ہیں پھر ماڈل متن کو اس طرح سے جاری رکھتا ہے جس سے عمل کی عکاسی ہو۔

عملی طور پر، اس کا مطلب یہ ہے کہ ماڈل ان پٹ ڈھانچے سے کارروائی کا اندازہ لگاتا ہے اور اس کے مطابق جواب دیتا ہے، بجائے اس کے کہ تربیت کے ذریعے واضح طور پر بتایا جائے کہ کیا کرنا ہے۔

فائن ٹیوننگ اور زیرو شاٹ لرننگ

|

طرف |

فائن ٹیوننگ (ملازمت کے لیے مخصوص تربیت) |

زیرو شاٹ لرننگ |

|

تعریف |

ماڈل کو ایک مخصوص کام کے لیے لیبل والے ڈیٹا پر مزید تربیت دی جاتی ہے۔ |

ماڈل بغیر کسی اضافی تربیت کے کام انجام دیتا ہے۔ |

|

تعلیم کے تقاضے |

آپ کو کام کے لیے مخصوص لیبل والے ڈیٹاسیٹس کی ضرورت ہے۔ |

آپریشن کے لیے لیبل والے ڈیٹا کی ضرورت نہیں ہے۔ |

|

ترتیب |

ہر کام کے لیے الگ الگ تربیتی مراحل |

کاموں کو قدرتی زبان کے اشارے کے طور پر پیش کیا جاتا ہے۔ |

|

لچکدار |

تربیت یافتہ کاموں تک محدود |

بہت سے آپریشن جو پوشیدہ ہیں عام کیے جا سکتے ہیں۔ |

|

کارکردگی |

عام طور پر کچھ کاموں کے لیے زیادہ |

کم لیکن پیمانے کے ساتھ بہتر ہوتا ہے۔ |

|

خرچ |

مہنگا (فی کام تربیت) |

موثر (دوبارہ تربیت کی ضرورت نہیں) |

|

موافقت |

نئے کاموں کے لیے دوبارہ تربیت کی ضرورت ہے۔ |

اشارے کے ساتھ فوری طور پر موافقت کریں۔ |

|

مثال (NLP) |

جذباتی تجزیہ ڈیٹاسیٹ کے لیے ایک ماڈل کی تربیت |

"جذبات کی درجہ بندی: …” پرامپٹ |

|

میں استعمال ہوتا ہے۔ |

GPT-1، موجودہ NLP سسٹم |

GPT-2، GPT-3، تازہ ترین LLM |

|

کلیدی فوائد |

متعین کاموں کے لیے اعلیٰ درستگی |

اعلی لچک اور عمومی کاری |

|

اہم حدود |

متعدد کاموں میں توسیع پذیر نہیں۔ |

ٹھیک ٹیونڈ ماڈلز سے کم درست |

ٹریننگ ڈیٹا (ویب ٹیکسٹ)

اس کام کا ایک اور اہم حصہ ماڈل کی تربیت کے لیے استعمال ہونے والا ڈیٹاسیٹ ہے۔

روایتی ذرائع جیسے ویکیپیڈیا، کتابوں اور خبروں کے مضامین پر مکمل انحصار کرنے کے بجائے، مصنفین نے ایک نیا ڈیٹا سیٹ بنایا: ویب متن.

یہ لاکھوں دستاویزات (تقریباً 40GB متن) پر مشتمل ہے جو Reddit پر شیئر کیے گئے لنکس سے جمع کیے گئے ہیں جنہیں ایک خاص سطح کی مصروفیت ملی ہے۔

کاغذ کے مطابق، فلٹرنگ کا یہ مرحلہ ڈیٹا کے مجموعی معیار کو بہتر بنانے میں مدد کرتا ہے کیونکہ مواد کے قارئین کے لیے دلچسپ یا مفید ہونے کا زیادہ امکان ہوتا ہے۔

جو چیز اس ڈیٹا سیٹ کو اہم بناتی ہے وہ اس کا تنوع ہے۔ اس میں متعدد ڈومینز کی حقیقی زبان شامل ہے، اور اس سے بھی اہم بات یہ ہے کہ کاموں کی فطری مثالیں جیسے کہ وضاحتیں، سوال جواب کے جوڑے، اور ترجمہ خود متن میں شامل ہیں۔

ان پٹ اظہار

متن پر کارروائی کرنے کے لیے، ماڈل درج ذیل تکنیکوں کا استعمال کرتا ہے: بائٹ پیئر انکوڈنگ (BPE).

مصنفین کے مطابق، BPE لفظ کی سطح اور کردار کی سطح کی نمائندگی کے درمیان درمیانی بنیاد کے طور پر کام کرتا ہے۔

متن کو پورے الفاظ یا انفرادی حروف کے طور پر سختی سے سمجھنے کے بجائے، اسے چھوٹی اکائیوں میں تقسیم کریں جو کہ ڈیٹا میں پیٹرن کے ظاہر ہونے کی بنیاد پر ایڈجسٹ کیے جاسکتے ہیں۔

درحقیقت، یہ ماڈل کو متن کی ایک وسیع رینج پر زیادہ مؤثر طریقے سے کارروائی کرنے کی اجازت دیتا ہے، بشمول نایاب الفاظ اور متنوع زبانیں۔ جنرلائزیشن کو بھی بہتر بنایا گیا ہے کیونکہ ماڈل مکمل الفاظ کی ایک مقررہ ذخیرہ الفاظ تک محدود نہیں ہے۔

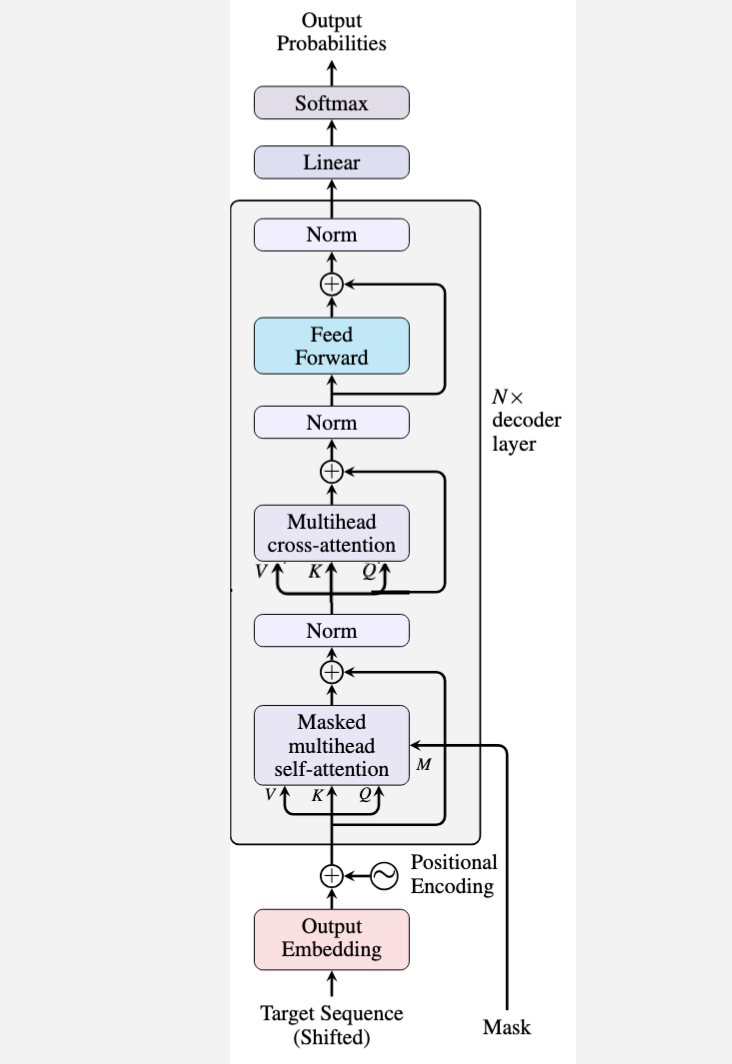

ماڈل فن تعمیر

اس کاغذ میں استعمال شدہ ماڈل پر مبنی ہے: ٹرانسفارمر (صرف ڈیکوڈر) یہ GPT-1 کی طرح ہے، لیکن اس میں نمایاں طور پر توسیع شدہ فن تعمیر ہے۔

مصنفین کے مطابق، یہ ماڈل پر انحصار کرتا ہے: خود غرضی کا نقاب پوشیہ آپ کو اگلے ٹوکن کی پیشین گوئی کرتے ہوئے پچھلے ٹوکن کو ترتیب سے دیکھنے کی اجازت دیتا ہے۔

اس کا مطلب یہ ہے کہ یہ قدم بہ قدم متن پر کارروائی کرتا ہے، اگلا ٹوکن بنانے کے لیے ہمیشہ ماضی کے سیاق و سباق کا استعمال کرتا ہے۔

GPT-1 کے مقابلے میں کئی اہم تبدیلیاں متعارف کرائی گئی ہیں۔

یہ ماڈل 1024 ٹوکنز تک کی ترتیب کے ساتھ طویل سیاق و سباق کو سنبھال سکتا ہے اور تقریباً 50,000 ٹوکنز کی ایک بڑی ذخیرہ الفاظ استعمال کرتا ہے۔ یہ بہت گہرا بھی ہے، مزید تہوں اور بہت زیادہ پیرامیٹرز کے ساتھ۔

مصنفین نے 117 ملین سے 1.5 بلین پیرامیٹرز تک کے ماڈل کے مختلف ورژنز کو تربیت دی۔

ان میں سے سب سے بڑا وہ ہے جسے ہم اب GPT-2 کہتے ہیں، جو پیپر میں رپورٹ کیے گئے زیادہ تر طاقتور نتائج کے لیے ذمہ دار ہے۔

ٹرانسفارمر (صرف ڈیکوڈر)

میمو: اصل شکل پورے ٹرانسفارمر فن تعمیر (انکوڈر-ڈیکوڈر) کو ظاہر کرتی ہے۔ آپ کو صرف توجہ کی ضرورت ہے۔. GPT طرز کے ماڈل کی وضاحت اور مطابقت کے لیے، یہاں استعمال ہونے والی تصاویر کو صرف فن تعمیر کے ڈیکوڈر پہلو پر فوکس کرنے کے لیے کاٹا گیا ہے۔ اس کی وجہ یہ ہے کہ GPT ماڈل صرف ڈیکوڈر ٹرانسفارمر ڈیزائن پر مبنی ہے۔

حوالہ: براؤنلی، جے ٹرانسفارمر ماڈل انکوڈرز اور مشین لرننگ ماسٹری میں ڈیکوڈر۔

تجربہ

ماڈل کا جائزہ لینے کے لیے، مصنفین نے اسے کاموں کی ایک وسیع رینج میں آزمایا، لیکن اہم رکاوٹوں کے ساتھ۔ کاغذ کے مطابق، ماڈل کو ان کاموں کے لیے تربیت یا ٹھیک ٹیون نہیں کیا گیا تھا۔

اس کے بجائے، ہر چیز کا جائزہ صفر شاٹ کی ترتیب میں کیا گیا، جہاں ماڈل کو صرف ایک اشارہ دیا گیا اور متن کے ساتھ جاری رکھنے کو کہا گیا۔

انہوں نے اس سیٹ اپ کو مختلف قسم کے مسائل پر لاگو کیا، بشمول زبان کے ماڈلنگ کے معیارات، پڑھنے کی سمجھ، ترجمہ، خلاصہ، سوال کے جوابات، اور عام فہم استدلال۔

یہاں مقصد صرف کارکردگی کی پیمائش کرنا نہیں تھا، بلکہ یہ دیکھنا تھا کہ ایک ماڈل (صرف خام متن پر تربیت یافتہ) اضافی تربیت کے بغیر کاموں کو کس حد تک عام کر سکتا ہے۔

کلیدی نتائج

مختلف کاموں میں ماڈل کا جائزہ لینے سے بہت سے توقعات سے زیادہ مضبوط نتائج برآمد ہوئے۔

مصنفین کے مطابق، GPT-2 نے صفر شاٹ سیٹنگز میں آٹھ میں سے سات لینگویج ماڈلنگ بینچ مارکس پر جدید ترین نتائج حاصل کیے ہیں۔

سب سے اہم مشاہدات میں سے ایک یہ ہے کہ تقریباً لاگ لکیری رجحان کے بعد ماڈل کے سائز میں اضافے کے ساتھ کارکردگی میں بہتری آتی رہتی ہے۔

اس کا مطلب ہے کہ آپ کے ماڈل کو اسکیل کرنے سے تمام کاموں میں بہتر نتائج مل سکتے ہیں۔

کاغذ یہ بھی ظاہر کرتا ہے کہ بڑے ماڈلز زیادہ مستقل ملٹی ٹاسکنگ رویے کی نمائش کرتے ہیں۔

مثال کے طور پر، GPT-2 ان کاموں پر اچھی کارکردگی کا مظاہرہ کرتا ہے جن کے لیے طویل مدتی سمجھ کی ضرورت ہوتی ہے، جیسے LAMBADA، اور CoQA جیسے ڈیٹا سیٹس پر پڑھنے کی سمجھ میں مسابقتی نتائج دکھاتا ہے۔

یہاں تک کہ یہ ترجمے کی ابتدائی صلاحیتوں کا مظاہرہ کر سکتا ہے اور کام کے لیے واضح طور پر تربیت حاصل کیے بغیر حقائق پر مبنی سوالات کے جوابات دے سکتا ہے۔

دراصل بات واضح ہے۔ بات یہ ہے کہ ماڈل کے سائز اور ڈیٹا میں اضافہ ان صلاحیتوں کو کھولنے میں کلیدی کردار ادا کرتا ہے۔

کام سے

انفرادی کاموں کو زیادہ قریب سے دیکھ کر، کاغذ اس بات کی واضح تصویر فراہم کرتا ہے کہ ماڈل کہاں اچھی کارکردگی کا مظاہرہ کرتا ہے اور کہاں یہ اب بھی جدوجہد کر رہا ہے۔

GPT-2 کام کی مخصوص تربیت کے بغیر فہم پڑھنے میں حیرت انگیز طور پر مضبوط نتائج دکھاتا ہے۔ تاہم، خلاصہ کارکردگی اب بھی محدود ہے۔

اگرچہ وہ ایسے خلاصے تیار کر سکتے ہیں جو معقول معلوم ہوتے ہیں، لیکن وہ اکثر نگرانی شدہ طریقوں سے کم درست ہوتے ہیں۔

ترجمہ کے لیے، ماڈل کچھ قابلیت کو ظاہر کرتا ہے، لیکن نتائج اب بھی مسابقتی نہیں ہیں۔

دوسری طرف، ماڈل کے سائز میں اضافہ کے طور پر سوالوں کے جواب دینے میں نمایاں بہتری آئی ہے، یہ تجویز کرتا ہے کہ پیمانہ اس فنکشن میں اہم کردار ادا کرتا ہے۔

مجموعی طور پر، ماڈل کامل نہیں ہے. تاہم، حیرت انگیز بات یہ ہے کہ انہوں نے بغیر کسی واضح تربیت کے تمام کاموں میں عمومی مہارتیں سیکھنا شروع کر دی ہیں۔

جنرلائزیشن بمقابلہ حفظ

ایک فطری سوال یہ پیدا ہوتا ہے کہ آیا ماڈل درحقیقت کارآمد نمونوں کو سیکھ رہا ہے، یا محض تربیتی ڈیٹا کو یاد کر رہا ہے۔

مصنف اس مسئلے کو براہ راست حل کرتا ہے۔ وہ تربیتی ڈیٹاسیٹس اور تشخیصی معیارات کے درمیان اوورلیپ کا تجزیہ کرنے کے لیے n-gram موازنہ کا استعمال کرتے ہیں اور ان علامات کی تلاش کرتے ہیں جن کو عام کرنے کے بجائے ماڈل کاپی کر رہا ہو۔

کاغذ کے مطابق، کچھ اوورلیپ ہے (جو بڑے ڈیٹا سیٹس میں عام ہے)، لیکن یہ ماڈل کی کارکردگی کی وضاحت کے لیے کافی نہیں ہے۔

انہوں نے یہ بھی مشاہدہ کیا کہ ماڈل اب بھی ڈیٹا کو کم کرتا ہے۔ اس کا مطلب یہ ہے کہ یہ تربیتی سیٹ میں ہر چیز کو مکمل طور پر حاصل نہیں کرتا ہے۔

یہ ایک اہم نکتہ ہے۔ اگر آپ کا ماڈل بنیادی طور پر حفظ ہے، تو آپ توقع کریں گے کہ یہ ڈیٹا کے بہت قریب فٹ ہو جائے گا۔

عملی طور پر، اس سے پتہ چلتا ہے کہ سادہ یادداشت کے بجائے حقیقی سیکھنے میں بہتری لائی جا رہی ہے، چاہے کچھ فالتو پن ناگزیر ہو۔

دلیل

اس حصے میں، مصنفین ایک قدم پیچھے ہٹتے ہیں اور غور کرتے ہیں کہ ان نتائج کا اصل مطلب کیا ہے۔

مقالے کے مطابق، بڑے اور متنوع ڈیٹاسیٹس پر تربیت یافتہ زبان کے ماڈل محض متنی نمائندگی نہیں سیکھتے ہیں۔ میں نے بغیر نگرانی کے کام خود کرنے کا طریقہ سیکھنا شروع کیا۔

دوسرے لفظوں میں، پری ٹریننگ مفید فعالیت فراہم کرنے سے کہیں زیادہ کام کرتی ہے۔ یعنی، ایسے نمونوں کو پکڑنا جو اصل کام کے رویے سے ملتے جلتے ہوں۔

ایک ہی وقت میں، مصنفین محتاط ہیں کہ نتائج کو بڑھا چڑھا کر پیش نہ کریں۔

اگرچہ زیرو شاٹ کی صلاحیت متاثر کن ہے، لیکن کارکردگی اب بھی بہت سے کاموں کے لیے عملی نہیں ہے۔

کچھ آؤٹ پٹ سطح پر قائل معلوم ہو سکتے ہیں، لیکن جب زیادہ احتیاط سے پیمائش کی جائے تو ان میں درستگی کی کمی ہوتی ہے۔

درحقیقت یہ حصہ کہانی کے دونوں پہلوؤں کو اجاگر کرتا ہے۔ یہ نقطہ نظر یقینی طور پر امید افزا ہے، لیکن یہ اب بھی زیادہ عام نظام کی طرف ایک ابتدائی قدم ہے۔

پابندیاں

کاغذ میں پیش رفت کے باوجود، اس نقطہ نظر میں اب بھی کچھ اہم حدود ہیں۔

مصنفین کے مطابق، زیرو شاٹ کی کارکردگی، جب کہ متاثر کن ہے، عام طور پر بہت سے کاموں کے لیے مکمل طور پر زیر نگرانی ماڈلز سے کمزور ہے۔

ماڈل کے سائز اور استعمال شدہ ڈیٹا کی مقدار کے لحاظ سے نتائج بھی بڑے پیمانے پر منحصر ہیں۔ اس کا مطلب ہے کہ چھوٹے ماڈلز ایک جیسی فعالیت نہیں دکھاتے ہیں۔

مزید برآں، کچھ کام، جیسے خلاصہ، نسبتاً کمزور رہتے ہیں۔

ماڈل ایسے آؤٹ پٹ پیدا کر سکتے ہیں جو قابل فہم لگتا ہے، لیکن جب زیادہ احتیاط سے جائزہ لیا جائے تو ان میں اکثر درستگی یا مستقل مزاجی کی کمی ہوتی ہے۔

ایک اور عملی چیلنج لاگت ہے۔ ان ماڈلز کی تربیت کے لیے اہم کمپیوٹیشنل وسائل اور بڑے ڈیٹا سیٹس کی ضرورت ہوتی ہے، جس سے بہت سے محققین کے لیے اس نقطہ نظر کو دوبارہ تیار کرنا یا اسکیل کرنا مشکل ہو جاتا ہے۔

نتیجہ

کاغذ ایک سادہ لیکن طاقتور خیال کے ساتھ ختم ہوتا ہے۔

مصنفین کے مطابق، ایک بار جب کسی زبان کے ماڈل کو کافی بڑے اور متنوع ڈیٹاسیٹ پر اور کافی صلاحیت پر تربیت دی جاتی ہے، تو یہ تمام کاموں کو عام کرتا ہے اور واضح تربیت کے بغیر اس کام کو انجام دینا شروع کر دیتا ہے۔

اس کا مطلب یہ ہے کہ ماڈل نہ صرف زبان سیکھتا ہے بلکہ اس کے اندر موجود کاموں کی ساخت بھی۔

عملی طور پر، یہ AI سسٹمز کے بارے میں سوچنے کے ایک مختلف انداز کی نمائندگی کرتا ہے۔ ہر مخصوص کام کے لیے ایک ماڈل کو ڈیزائن اور تربیت دینے کے بجائے، آپ بڑے لسانی ڈیٹا پر ایک ماڈل کی تربیت پر توجہ مرکوز کر سکتے ہیں، اور مفید خصوصیات قدرتی طور پر سامنے آ سکتی ہیں۔

حتمی بصیرت

جبکہ GPT-1 نے پری ٹریننگ اور فائن ٹیوننگ کو یکجا کرنے کا آئیڈیا متعارف کرایا، GPT-2 اس خیال کو ایک قدم آگے لے جاتا ہے۔

مقالے کے مطابق، صرف پری ٹریننگ، اگر کافی پیمانے پر کی جائے تو، پہلے سے ہی ایسے ماڈل تیار کر سکتے ہیں جو بغیر کسی اضافی تربیت کے وسیع پیمانے پر کام انجام دینا شروع کر دیتے ہیں۔

یہ ایک لطیف لیکن اہم تبدیلی ہے۔ کیونکہ اس سے پتہ چلتا ہے کہ متن کی بڑی مقدار کی نمائش عام خصوصیات کے براہ راست ظہور کا باعث بن سکتی ہے۔

میری رائے میں، یہ وہ جگہ ہے جہاں چیزوں کا رخ بدلنا شروع ہوتا ہے۔

توجہ کام سے متعلق مخصوص نظاموں کو ڈیزائن کرنے اور مزید عام ماڈلز بنانے کی طرف ہٹ جاتی ہے جو خود کو ڈھال سکیں۔

یہ آئیڈیا براہ راست ماڈلز جیسے GPT-3، ChatGPT، اور انہی اصولوں پر بنے جدید بڑے پیمانے پر لینگویج سسٹم کے لیے اسٹیج سیٹ کرتا ہے۔

GPT-1 اور GPT-2 — کلیدی فرق

|

طرف |

GPT-1 |

GPT-2 |

|

بنیادی خیال |

پری ٹریننگ + فائن ٹیوننگ |

سولو پری ٹریننگ (زیرو شاٹ) |

|

تربیت کا نقطہ نظر |

مرحلہ 2: زبان سیکھنے کے بعد کام کو اپنانا |

واحد مرحلہ: زبان سیکھنا اور ٹاسک ریزننگ |

|

نگرانی |

ہمیں ٹھیک ٹیوننگ کے لیے لیبل والے ڈیٹا کی ضرورت ہے۔ |

آپریشن کے لیے لیبل والے ڈیٹا کی ضرورت نہیں ہے۔ |

|

ٹاسک پروسیسنگ |

وہ کام جن کے لیے علیحدہ فائن ٹیوننگ کی ضرورت ہوتی ہے۔ |

اشارے کے ذریعے کارروائی کی گئی (صفر شاٹ) |

|

عام کرنا |

محدود، ٹھیک ٹیوننگ پر منحصر ہے۔ |

تمام کاموں میں مضبوط جنرلائزیشن |

|

ماڈل کردار |

ایک زبان سیکھنے کے بعد، آپ موافقت کرتے ہیں۔ |

زبان اور کام ایک ساتھ سیکھیں۔ |

|

فن تعمیر |

ٹرانسفارمر (ڈیکوڈر پر مبنی) |

ٹرانسفارمر (صرف ڈیکوڈر، توسیع شدہ) |

|

ماڈل سائز |

چھوٹا (~117M پیرامیٹرز) |

بہت بڑا (1.5B پیرامیٹرز تک) |

|

سیاق و سباق کی لمبائی |

مختصر سیاق و سباق |

طویل سیاق و سباق (1024 ٹوکن تک) |

|

ڈیٹاسیٹ |

کتب کارپس + دوسرے کیوریٹڈ ڈیٹاسیٹس |

ویب ٹیکسٹ (بڑا، متنوع انٹرنیٹ ڈیٹا) |

|

اہم خصوصیات |

منتقلی سیکھنے |

زیرو شاٹ لرننگ |

|

کارکردگی کا انداز |

ٹھیک ٹیوننگ کے بعد مضبوط |

بغیر کسی نوکری کی تربیت کے بھی مضبوط |

|

پابندیاں |

لیبل شدہ ڈیٹا پر منحصر ہے۔ |

پیمانے پر بہت زیادہ انحصار (ڈیٹا + کمپیوٹ) |

|

اہم شراکت |

پری ٹریننگ پیراڈائم کا تعارف |

ملٹی ٹاسکنگ رویے کے ظہور کو ظاہر کرتا ہے۔ |

|

اثر و رسوخ |

ایک جدید NLP پائپ لائن کے بنیادی اصول |

یونیورسل ماڈل میں منتقلی۔ |