ہم ہر وقت AI ٹولز استعمال کرتے ہیں، چاہے سوالات پوچھیں، تصاویر بنائیں یا روزمرہ کے کاموں میں مدد حاصل کریں۔ لیکن ان میں سے زیادہ تر ٹولز کہیں سے ظاہر نہیں ہوئے۔ یہ تحقیقی مقالوں کی بنیاد پر تیار کیا گیا تھا جہاں اصل خیالات کو تیار کیا گیا تھا اور جانچا گیا تھا۔

اب، ہر کوئی تحقیقی مقالے پڑھنے سے لطف اندوز نہیں ہوتا ہے یا اس کے پاس تمام معلومات (بعض اوقات بہت گھنی) کو چھاننے اور ہضم کرنے کا وقت نہیں ہوتا ہے۔ اس لیے میں نے آپ کے لیے سخت محنت کرنے اور AI کاغذی جائزوں کی ایک سیریز سے اہم بصیرتیں شیئر کرنے کا فیصلہ کیا۔

مقصد اس کو ایک بھاری علمی بحث میں تبدیل کرنا نہیں ہے، بلکہ بنیادی خیالات کو واضح اور عملی انداز میں بیان کرنا ہے۔ اس مقالے میں، آپ جانیں گے کہ یہ کس مسئلے کو حل کرنے کی کوشش کر رہا ہے، کون سا طریقہ اختیار کیا گیا، اور یہ کیوں ضروری ہے۔

ہر مضمون کاغذ کا ایک مختصر تجزیہ فراہم کرتا ہے، یہ کیسے کام کرتا ہے، اور آپ کو اس سے کیا لینا چاہیے۔ آخر میں، آپ کو خود پورے تحقیقی مقالے سے گزرے بغیر بنیادی خیالات کو سمجھنا چاہیے۔

مقالہ کا خاکہ

پہلا مقالہ جس کا میں جائزہ لوں گا وہ ہے "Emproving Language Understanding through Generative Dictionary Training” by Alec Radford, Karthik Narasimhan, Tim Salimans, and Ilya Sutskever.

اگر آپ اسے خود پڑھنا چاہتے ہیں تو اصل کاغذ یہ ہے: پیپر پڑھیں۔

یہاں ایک فوری انفوگرافک ہے جس کا ہم یہاں احاطہ کریں گے:

انڈیکس

شرطیں

اس تجزیہ سے زیادہ سے زیادہ فائدہ اٹھانے کے لیے، چند بنیادی خیالات سے واقف ہونا مفید ہے:

-

نیچرل لینگویج پروسیسنگ (NLP) کے بارے میں ایک عام فہم اور مشینیں متن کو کیسے پروسیس کرتی ہیں۔

-

ٹرانسفارمر ماڈل کیا ہے اس کا ایک اعلیٰ سطحی خیال (کوئی گہری تفصیلات کی ضرورت نہیں، صرف تصور)۔

-

زیر نگرانی اور غیر زیر نگرانی سیکھنے کے درمیان فرق

-

مشین لرننگ کے بنیادی تصورات جیسے کہ تربیتی ڈیٹا اور ماڈل

اگر آپ ان سب سے پوری طرح واقف نہیں ہیں تو یہ ٹھیک ہے۔ آپ پیروی کرتے رہ سکتے ہیں۔ یہاں مقصد ہر چیز کو واضح اور بدیہی رکھنا ہے۔

خلاصہ

GPT جیسے ماڈل بننے سے پہلے جو ہم آج جانتے ہیں، ان کی اہم حدود تھیں۔ AI سسٹم مخصوص کاموں میں اچھے تھے لیکن عام فہم کے ساتھ جدوجہد کرتے تھے۔

اس مقالے میں مصنف نے ایک سادہ لیکن طاقتور خیال پیش کیا ہے۔ ہر کام کے لیے الگ سے ایک ماڈل کو تربیت دینے کے بجائے، ہم زبان کی ساخت سیکھنے کے لیے پہلے ماڈل کو بغیر لیبل والے متن کی بڑی مقدار پر تربیت دیتے ہیں۔ اس کے بعد اسے چھوٹے لیبل والے ڈیٹاسیٹس کا استعمال کرتے ہوئے مخصوص کاموں کے لیے تیار کیا جاتا ہے۔

مصنفین کے مطابق، یہ دو قدمی اپروچ (پہلے سے ٹریننگ کے بعد فائن ٹیوننگ) ایک ماڈل کو کم سے کم تبدیلیوں کے ساتھ مختلف قسم کے کاموں کو سنبھالنے کی اجازت دیتا ہے۔

درحقیقت اس سے بڑا فرق پڑا ہے۔ ہر مسئلے کے لیے ایک نیا ماڈل بنانے کے بجائے، آپ ایک عام ماڈل کو تربیت دے سکتے ہیں جو خود زبان سیکھتا ہے اور پھر اسے کاموں میں دوبارہ استعمال کرتا ہے۔

کاغذ کا مقصد

اس کام کے محرک کو سمجھنے کے لیے، اس وقت NLP کی اہم حدود کو دیکھنا مفید ہے۔

زیادہ تر ماڈلز بڑے لیبل والے ڈیٹاسیٹس پر بہت زیادہ انحصار کرتے تھے، جو ہمیشہ دستیاب نہیں ہوتے تھے۔ بہت سے کاموں میں موثر نظام کو تربیت دینے کے لیے کافی لیبل لگا ڈیٹا نہیں تھا۔ مزید برآں، موجودہ ماڈلز کو عام طور پر ایک ہی کام کے لیے ڈیزائن کیا جاتا ہے، جس سے انہیں دوبارہ استعمال یا موافقت کرنا مشکل ہو جاتا ہے۔

اس کی وجہ سے، مصنفین کا مقصد لیبل والے ڈیٹا پر انحصار کو کم کرنا اور زیادہ عام نقطہ نظر کی طرف بڑھنا ہے۔ ان کا مقصد زبان کا ایک ایسا ماڈل بنانا تھا جو خام متن کی بڑی مقدار سے سیکھ سکے اور پھر مختلف کاموں پر لاگو ہو۔

کاغذ کے مطابق، وہ ٹرانسفر لرننگ کو بھی فعال کرنا چاہتے تھے – سیکھے گئے علم کو ایک کام سے دوسرے کام پر لاگو کرنے کی صلاحیت۔ وہ ہر بار نئے ماڈل کو دوبارہ ڈیزائن کیے بغیر کارکردگی کو بہتر بنانا چاہتے تھے۔

طریقہ کار

یہ سمجھنے کے لیے کہ مصنف نے اس مسئلے سے کیسے رجوع کیا، آئیے اس کے طریقہ کار کے پیچھے کلیدی خیالات کو دیکھیں۔

پیشگی تربیت

اس مضمون کا بنیادی مقصد ایک سادہ لیکن طاقتور طریقہ ہے جو دو مراحل پر مشتمل ہے۔ پہلا مرحلہ پری ٹریننگ ہے، جہاں ماڈل خام متن سے براہ راست سیکھتا ہے۔

مصنفین کے مطابق، ماڈل کو لینگویج ماڈلنگ کے مقصد کا استعمال کرتے ہوئے بغیر لیبل والے متن کے ایک بڑے کارپس پر تربیت دی گئی تھی: ترتیب میں اگلے لفظ کی پیش گوئی کریں۔ خاص طور پر، یہ پچھلے لفظ کی بنیاد پر اگلے لفظ کی پیشین گوئی کر کے اعلیٰ جہتی امکان کے پیچیدہ مسئلے کو حل کرتا ہے۔ اس عمل کے ذریعے، ماڈل آہستہ آہستہ زبان کے اہم پہلوؤں کو سیکھتا ہے، بشمول گرامر، سیاق و سباق، ساخت، اور عمومی نمونے۔

مقالے میں اس بات پر زور دیا گیا ہے کہ اس مرحلے میں BooksCorpus جیسے ڈیٹاسیٹس کا استعمال کیا جاتا ہے کیونکہ ان میں لمبی اور مسلسل تحریریں ہوتی ہیں۔ یہ اہم ہے کیونکہ یہ ماڈل کو مختصر ٹکڑوں کے بجائے جملوں کے درمیان تعلقات کو سمجھنے میں مدد کرتا ہے۔

ٹھیک دھن (کام کے مطابق ڈھالنا)

ماڈل کے زبان کے عمومی نمونوں کو سیکھنے کے بعد، اگلا مرحلہ فائن ٹیوننگ ہے، جہاں اسے لیبل والے ڈیٹا کا استعمال کرتے ہوئے ایک مخصوص کام کے مطابق بنایا جاتا ہے۔

مصنفین کے مطابق، اس میں سوالوں کے جوابات، متن کی درجہ بندی، فطری زبان کی استدلال، اور معنوی مماثلت جیسے کام شامل ہیں۔ ہر کام کے لیے ایک نیا ماڈل بنانے کے بجائے، ہم پہلے سے تربیت یافتہ ماڈل کو معمولی ایڈجسٹمنٹ کے ساتھ دوبارہ استعمال کرتے ہیں۔

درحقیقت، یہ وہی ہے جو نقطہ نظر کو اتنا طاقتور بناتا ہے. چونکہ ماڈل پہلے سے ہی عام سطح پر زبان کو سمجھتا ہے، اس لیے یہ شروع سے نئے سرے سے ڈیزائن کیے بغیر مختلف کاموں کو تیزی سے ڈھال سکتا ہے۔

ٹرانسفارمرز بمقابلہ BERT بمقابلہ GPT

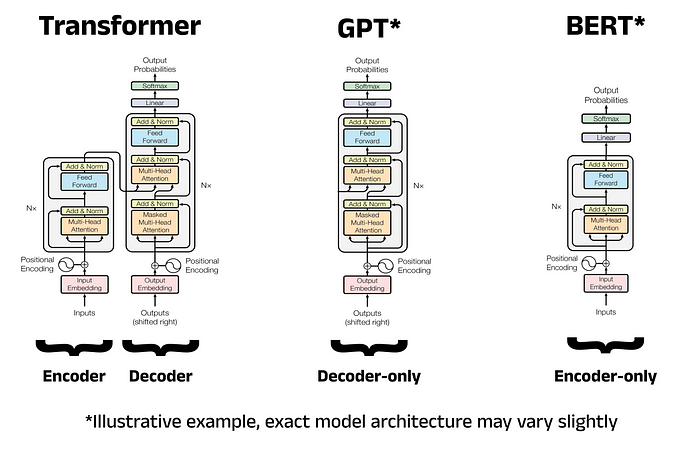

GPT-1 کے بارے میں سیکھنے سے پہلے، یہ سمجھنا مددگار ہے کہ جدید زبان کے ماڈلز کی ساخت کیسے بنتی ہے۔ زیادہ تر ٹرانسفارمر آرکیٹیکچر پر مبنی ہیں، لیکن اسے مختلف طریقوں سے استعمال کریں: صرف انکوڈر ماڈلز (جیسے BERT)، صرف ڈیکوڈر ماڈل (جیسے GPT)، یا مکمل انکوڈر-ڈیکوڈر ماڈل۔

اصل انکوڈر-ڈیکوڈر ٹرانسفارمر بنیادی طور پر مشینی ترجمہ جیسے کاموں کے لیے استعمال ہوتا تھا۔ صرف انکوڈر ماڈلز کو عام طور پر ٹیکسٹ کی درجہ بندی اور جذبات کے تجزیہ جیسے کاموں کو سمجھنے کے لیے استعمال کیا جاتا ہے، جب کہ صرف ڈیکوڈر ماڈلز تخلیقی کاموں جیسے کہ ٹیکسٹ جنریشن اور ڈرائیونگ سسٹم جیسے ChatGPT، Gemini، اور Claude کے لیے ڈیزائن کیے گئے ہیں۔

ٹرانسفارمر، GPT، اور BERT فن تعمیر کا موازنہ کرنے والی مثال۔ بڑے پیمانے پر زبان کے ماڈل کا موازنہ: GPT، BERT، T5 ہم انکوڈر-ڈیکوڈر، صرف ڈیکوڈر، اور صرف انکوڈر ڈیزائن دکھاتے ہیں۔

ٹرانسفارمر بمقابلہ BERT بمقابلہ GPT: کلیدی فرق

|

طرف |

ٹرانسفارمرز (اصل) |

بٹ |

جی پی ٹی |

|

کاغذ |

مجھے صرف توجہ کی ضرورت ہے (2017) |

برٹ (2018) |

GPT(2018~2019) |

|

فن تعمیر کی قسم |

انکوڈر + ڈیکوڈر |

صرف انکوڈر |

صرف ڈیکوڈر |

|

بنیادی مقصد |

انٹر سیکونس آپریشنز (مثلاً ترجمہ) |

زبان کی سمجھ |

زبان کی تخلیق |

|

تربیت کے مقاصد |

اگلی ٹوکن پیشن گوئی (seq2seq ترتیبات) |

نقاب پوش زبان کی ماڈلنگ (خالی جگہ پر کریں) |

اگلی ٹوکن پیشن گوئی (خودکارانہ) |

|

سمتیت |

دو طرفہ (انکوڈر) + بائیں سے دائیں (ڈیکوڈر) |

مکمل طور پر دو طرفہ |

صرف بائیں سے دائیں تک |

|

سیاق و سباق کو سمجھنا |

مضبوط (احتیاط سے) |

بہت طاقتور (مکمل طور پر انٹرایکٹو سیاق و سباق) |

طاقتور (لیکن صرف تاریخی تناظر میں) |

|

ان پٹ/آؤٹ پٹ اسٹائل |

ان پٹ → آؤٹ پٹ آرڈر |

ان پٹ → اظہار |

ان پٹ → تیار کردہ متن |

|

ٹھیک ٹیوننگ |

ہر کام کے لیے ضروری ہے۔ |

ہر کام کے لیے ضروری ہے۔ |

اختیاری (GPT-2+ صفر شاٹ کو سپورٹ کرتا ہے) |

|

عام کام |

ترجمہ، خلاصہ |

درجہ بندی، QA، NLI |

ٹیکسٹ جنریشن، QA، چیٹ |

|

طاقت |

لچکدار فن تعمیر پر مبنی |

متن کی گہری سمجھ |

عالمگیر نسل |

|

حد |

موافقت کے بغیر براہ راست استعمال نہیں کیا جا سکتا |

متن قدرتی طور پر نہیں بنایا جا سکتا۔ |

محدود انٹرایکٹو سیاق و سباق |

|

اہم اختراعات |

خود توجہ کا طریقہ کار |

گہری دو طرفہ انکوڈنگ |

توسیعی جنریٹو پری ٹریننگ |

|

ارتقاء کا کردار |

ہر جدید ایل ایل ایم کی بنیاد |

پیشہ ورانہ تفہیم ماڈل |

عام مقصد کے AI کا راستہ |

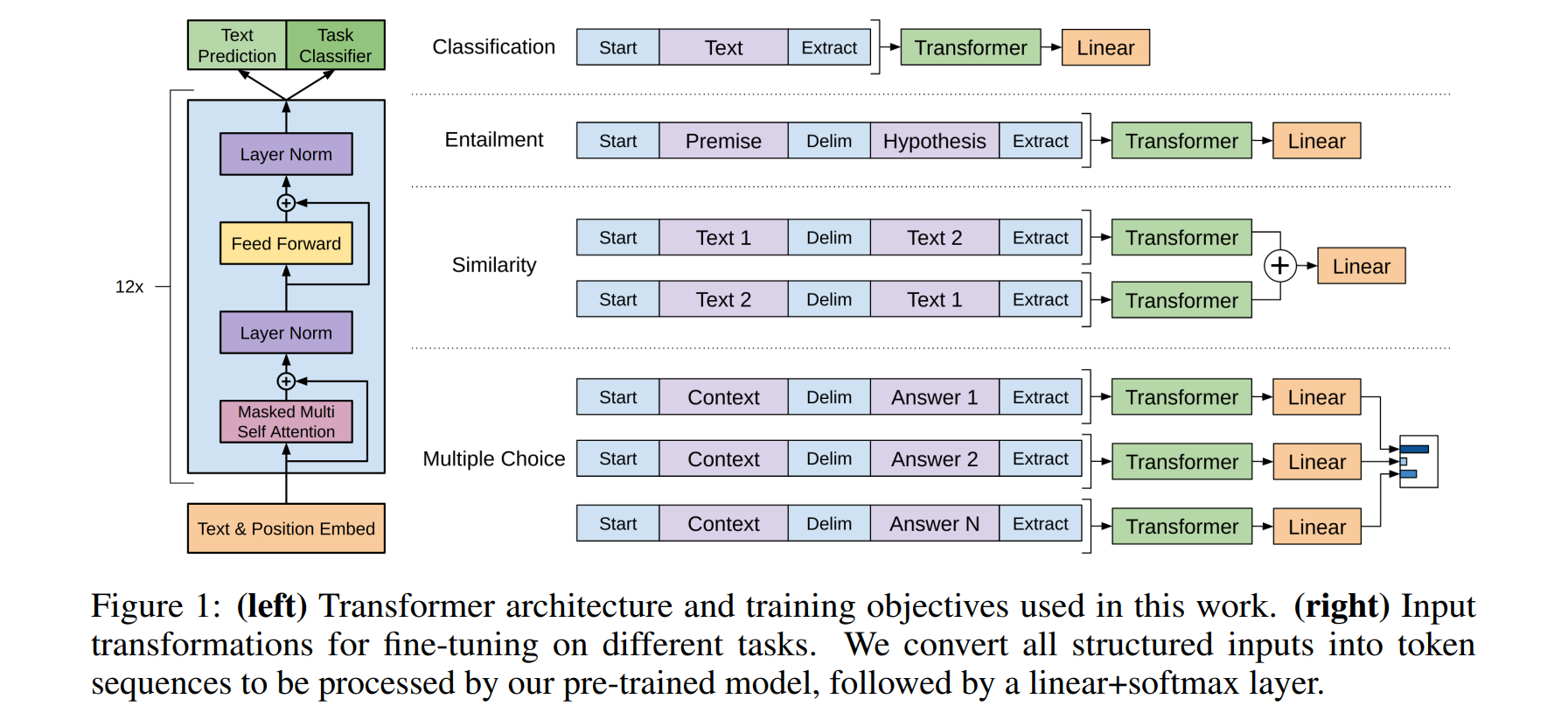

ماڈل فن تعمیر

اس پری ٹریننگ اور فائن ٹیوننگ اپروچ کو سپورٹ کرنے کے لیے، GPT-1 ماڈل ایک ٹرانسفارمر (ڈیکوڈر) فن تعمیر پر بنایا گیا ہے۔

مصنفین کے مطابق، یہ انتخاب کئی وجوہات کی بناء پر اہم ہے۔ LSTM جیسے پچھلے ماڈلز کے برعکس، ٹرانسفارمر طویل فاصلے تک انحصار کو زیادہ مؤثر طریقے سے ہینڈل کرتا ہے۔ اس کا مطلب ہے کہ آپ ایک جملے میں دور دراز کے الفاظ کے درمیان تعلقات کو بہتر طور پر سمجھ سکتے ہیں۔

یہ خود توجہ پر بھی انحصار کرتا ہے، ایک ایسا طریقہ کار جو ماڈل کو ہر لفظ پر کارروائی کرتے وقت متن کے انتہائی متعلقہ حصوں پر توجہ مرکوز کرنے کی اجازت دیتا ہے۔ اس سے ماڈل کو صورتحال کو زیادہ درست طریقے سے پکڑنے میں مدد ملتی ہے۔

دوسرا اہم فائدہ یہ ہے کہ ٹرانسفارمر ٹرانسفارمر سیکھنے کو زیادہ موثر بناتا ہے۔ اس کی وجہ یہ ہے کہ ایک ہی سیکھی ہوئی نمائندگی کو کم سے کم تبدیلیوں کے ساتھ مختلف کاموں میں دوبارہ استعمال کیا جا سکتا ہے۔

یہ مقالہ اس بات پر روشنی ڈالتا ہے کہ ٹرانسفارمر ان ٹرانسفر لرننگ منظرناموں میں LSTM پر مبنی ماڈلز سے بہتر کارکردگی کا مظاہرہ کرتا ہے۔

تصویر 1 "تخلیقی لغت کی تربیت کے ذریعے زبان کی سمجھ کو بہتر بنانا” (Radford et al.، 2018)، جو ٹرانسفارمر فن تعمیر اور ٹاسک مخصوص ان پٹ ٹرانسفارمیشن کو ظاہر کرتا ہے۔

اہم ٹیکنالوجی

مرکزی نقطہ نظر کے ساتھ، مصنفین ماڈل کو تمام کاموں میں مزید لچکدار بنانے کے لیے کئی عملی تکنیکیں متعارف کراتے ہیں۔

کاغذ کے مطابق، یہ متعدد کاموں کو متن پر مبنی فارمیٹ میں تبدیل کرکے سنبھالتا ہے تاکہ ان سب پر ایک ہی طرح سے کارروائی کی جاسکے۔ یہ ایک ہی ماڈل کو ہر بار دوبارہ ڈیزائن کیے بغیر متعدد مسائل میں استعمال کرنا آسان بناتا ہے۔

ایک اور اہم نکتہ یہ ہے کہ کاموں کے درمیان سوئچنگ کے لیے ماڈل میں صرف کم سے کم تعمیراتی تبدیلیوں کی ضرورت ہوتی ہے۔ پری ٹریننگ کے دوران سیکھے گئے زیادہ تر علم کو دوبارہ استعمال کیا جاتا ہے۔

مصنفین نے فائن ٹیوننگ کے دوران معاون زبان کے ماڈلنگ کے اہداف بھی شامل کیے ہیں، جو ماڈل کو مخصوص کاموں کے مطابق ڈھالتے ہوئے زبان کی عمومی سمجھ کو برقرار رکھنے میں مدد کرتے ہیں۔

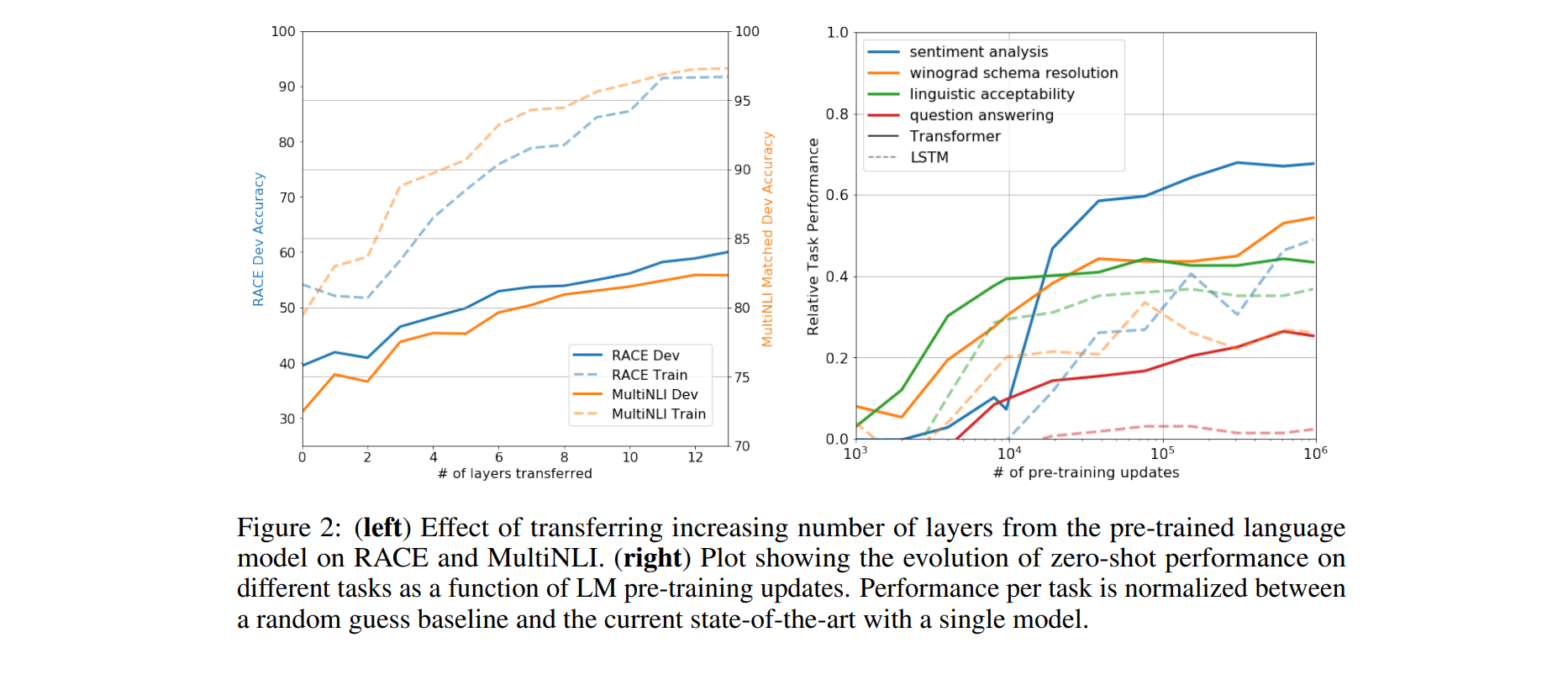

کلیدی نتائج

تربیت اور تشخیص کے بعد، نتائج صرف اچھے نہیں تھے، وہ ناقابل یقین حد تک مسابقتی تھے۔

مصنفین کے مطابق، ماڈل نے 12 میں سے 9 کاموں میں جدید ترین نظاموں سے بہتر کارکردگی کا مظاہرہ کیا۔ واضح بہتری آئی ہے، بشمول عام فہم استدلال میں +8.9% اور سوال جواب میں +5.7%۔

ایک اور اہم مشاہدہ یہ ہے کہ اگرچہ ماڈل نے مختلف سائز کے ڈیٹاسیٹس پر اچھی کارکردگی کا مظاہرہ کیا، لیکن کچھ چھوٹے ڈیٹاسیٹس پر اس کی کارکردگی کمزور تھی۔

اس سے پتہ چلتا ہے کہ پہلے سے تربیتی مرحلے نے بہتر عام کرنے میں مدد کی یہاں تک کہ جب لیبل لگا ڈیٹا محدود تھا۔

جو چیز ان نتائج کو عملی طور پر اہم بناتی ہے وہ یہ ہے کہ ایک ماڈل ہر انفرادی کام کے لیے خاص طور پر ڈیزائن کیے گئے ماہرانہ نظاموں کا مقابلہ کر سکتا ہے۔

تصویر 2 "تخلیقی لغت کی تربیت کے ذریعے زبان کی سمجھ کو بہتر بنانا” (Radford et al.، 2018)، پرت کی منتقلی اور زیرو شاٹ لرننگ آپریشنز کی وجہ سے کارکردگی میں بہتری دکھا رہا ہے۔

نتیجہ

نتیجہ اخذ کرنے کے لیے، اس مضمون نے AI سسٹمز کی تعمیر کے طریقے میں بڑی تبدیلیاں متعارف کرائی ہیں۔

مصنفین کے مطابق، ہر کام کے لیے ایک نئے ماڈل کو شروع سے تربیت دینے کے بجائے، ماڈل کو پہلے پری ٹریننگ کے ذریعے زبان کے ڈھانچے کو سکھایا جا سکتا ہے اور پھر اسے مخصوص کاموں کے مطابق ڈھالنے کے لیے ٹھیک بنایا جا سکتا ہے۔ یہ سادہ خیال بہت کارآمد ثابت ہوا ہے۔

اہم بات یہ ہے کہ زبان کے ماڈل متن کی عمومی تفہیم تیار کر سکتے ہیں، خاص طور پر جب ٹرانسفارمر فن تعمیر اور بڑے پیمانے پر ڈیٹا کے ساتھ ملایا جائے۔ یہ مختلف کاموں میں منتقلی سیکھنے کو عملی بناتا ہے۔

میری رائے میں، یہی چیز اس مقالے کو اتنا بااثر بناتی ہے۔ کارکردگی کے فوائد صرف چند بینچ مارکس تک محدود نہیں ہیں۔ یہ AI نظاموں کی تعمیر کے لیے مجموعی نقطہ نظر کو تبدیل کرتا ہے۔

یہ خیال بعد میں GPT-2، GPT-3، اور ChatGPT جیسے ماڈلز کی بنیاد بنا، اور آج بھی بڑے پیمانے پر زبان کے جدید ماڈلز کی تشکیل جاری رکھے ہوئے ہے۔

پابندیاں

دوسرے طریقوں کی طرح، اس طریقہ کار کی اپنی حدود ہیں۔

مقالے کے مطابق، ایک اہم چیلنج پری ٹریننگ مرحلے میں بڑی مقدار میں بغیر لیبل والے ڈیٹا کی ضرورت ہے، جسے حاصل کرنا ہمیشہ آسان نہیں ہوتا ہے۔ ایک ماڈل کی کارکردگی کا انحصار اس بات پر ہوتا ہے کہ فائن ٹیوننگ کے اقدامات کتنی اچھی طرح سے انجام پاتے ہیں۔

مصنفین یہ بھی نوٹ کرتے ہیں کہ اس کام میں ملٹی ٹاسک لرننگ کو مکمل طور پر تلاش نہیں کیا گیا تھا، جس سے اس بارے میں کچھ کھلے سوالات رہ گئے ہیں کہ ماڈل ایک ساتھ متعدد کاموں کو کس حد تک سنبھال سکتا ہے۔

عملی طور پر، ایک اور حد یہ ہے کہ بہت چھوٹے ڈیٹا سیٹ کے ساتھ کام کرتے وقت کارکردگی کمزور ہو سکتی ہے۔ یہ خاص طور پر درست ہے اگر ٹھیک ٹیوننگ کے عمل کو احتیاط سے نہیں سنبھالا جاتا ہے۔

متعلقہ کام اور سیاق و سباق

بہتر طور پر یہ سمجھنے کے لیے کہ یہ مضمون کہاں فٹ بیٹھتا ہے، ان خیالات کو دیکھنا مددگار ہے جو اس کی بنیاد رکھتے ہیں۔

مصنفین کے مطابق، ابتدائی نقطہ نظر جیسے کہ لفظ ایمبیڈنگز (جیسے Word2Vec اور GloVe)، LSTM پر مبنی زبان کے ماڈلز، اور نیم زیر نگرانی سیکھنے نے پہلے ہی زبان کی تفہیم میں پیش رفت کی ہے۔ تاہم، یہ طریقے اکثر الفاظ کی سطح کی نمائندگی کو سیکھنے تک محدود تھے یا مزید کام کے لیے مخصوص ڈیزائن کی ضرورت تھی۔

یہ کاغذ مختلف طریقے سے کیا کرتا ہے اس سے آگے جانا ہے۔ صرف انفرادی الفاظ پر توجہ مرکوز کرنے کے بجائے، یہ لسانی نمائندگیوں کی ایک وسیع رینج سیکھتا ہے جو پورے سلسلے میں سیاق و سباق اور معنی کو گرفت میں لیتے ہیں۔ یہ تبدیلیاں ماڈل کو مختلف کاموں میں بہتر طور پر عام کرنے کی اجازت دیتی ہیں۔

حتمی بصیرت

ایک خیال جو ہم اس مقالے سے نکالتے ہیں وہ یہ ہے کہ AI سسٹمز کو ہر کام کو انفرادی طور پر سکھانے کی ضرورت نہیں ہے۔

مصنفین کے مطابق، ایک بار جب ماڈل زبان کے ڈھانچے کو سیکھ لیتا ہے، تو یہ کم سے کم تبدیلیوں کے ساتھ وسیع پیمانے پر کاموں کو ڈھال سکتا ہے۔ یہی چیز اس کام کو بہت اہم بناتی ہے: کام کے مخصوص ماڈلز سے عام زبان کی سمجھ میں تبدیلی۔

میرے خیال میں یہ وہ لمحہ ہے جب چیزیں واقعی بدل گئی ہیں۔ یہاں جو GPT-1 کے طور پر شروع ہوا وہ ان سسٹمز کی بنیاد بن گیا جو ہم آج استعمال کرتے ہیں، بشمول ChatGPT اور دیگر جدید زبان کے ماڈلز۔