اوپن ویب پر بہت زیادہ ڈیٹا مسلسل تیار کیا جا رہا ہے۔ مصنوعات کی قیمتیں تبدیل ہوتی ہیں، ملازمت کی فہرستیں شائع اور شائع کی جاتی ہیں، خبروں کے مضامین شائع ہوتے ہیں، اور کمپنی کی معلومات کو اپ ڈیٹ کیا جاتا ہے۔

ڈویلپرز اور ٹیموں کے لیے جو اس قسم کے ڈیٹا پر انحصار کرتے ہیں، سوال یہ نہیں ہے کہ کیا ویب کو کھرچنا ہے، بلکہ وقت کے ساتھ ساتھ ایسا کیسے کیا جائے؟

ایک طویل وقت کے لئے، نقطہ نظر سادہ تھا. صفحات کا معائنہ کرنے، سلیکٹرز بنانے اور ڈیٹا نکالنے کے لیے BeautifulSoup یا Playwright اور Selenium جیسی براؤزر آٹومیشن لائبریریوں جیسے ٹولز کا استعمال کریں۔ یہ اچھی طرح سے کام کرتا ہے، لیکن ایک واقف مسئلہ کا سبب بنتا ہے. جس لمحے صفحہ کا ڈھانچہ تبدیل ہوتا ہے، سکریپر ٹوٹ جاتا ہے اور اسے ٹھیک کرنے کی ضرورت ہوتی ہے۔

حال ہی میں، ایک مختلف نقطہ نظر توجہ کو اپنی طرف متوجہ کرنا شروع کر دیا ہے. سلیکٹر لکھنے کے بجائے، آپ بیان کرتے ہیں کہ آپ کیا چاہتے ہیں اور سسٹم کو یہ جاننے دیں کہ اسے کیسے نکالا جائے۔ اسے لوگ AI سکریپنگ کہتے ہیں۔

دونوں نقطہ نظر آج بڑے پیمانے پر استعمال ہوتے ہیں، لیکن وہ بہت مختلف طریقوں سے مسئلہ کو حل کرتے ہیں۔ اس گائیڈ میں بتایا گیا ہے کہ ہر طریقہ کیسے کام کرتا ہے، وہ کہاں فٹ ہوتا ہے، اور یہ کیسے طے کرنا ہے کہ آپ کے استعمال کے معاملے کے لیے کون سا طریقہ درست ہے۔

انڈیکس

روایتی ویب سکریپنگ کیا ہے؟

روایتی ویب سکریپنگ سکریپنگ اس سادہ خیال پر بنائی گئی ہے کہ اگر کوئی براؤزر صفحہ لوڈ کر سکتا ہے اور صارف کو ڈیٹا ڈسپلے کر سکتا ہے، تو ایک پروگرام ایسا کرنے کے قابل ہونا چاہیے اور اس ڈیٹا کو خود بخود نکال سکتا ہے۔

یہ CSS سلیکٹرز اور XPath کا استعمال کرتے ہوئے کیا جاتا ہے۔ CSS سلیکٹرز کے لیے، ہمارے پاس درج ذیل سلیکٹرز ہیں: .product-card .price اس کا مطلب ہے ‘پروڈکٹ کارڈ کے اندر قیمت کا عنصر تلاش کریں’۔ یہ سمجھنا آسان ہے اور زیادہ تر استعمال کے معاملات میں اچھی طرح کام کرتا ہے۔

دوسری طرف، XPath زیادہ طاقتور لیکن زیادہ پیچیدہ ہے۔ آپ صفحہ کے ڈھانچے کو مزید دریافت کر سکتے ہیں، بشمول DOM کو اوپر اور نیچے منتقل کرنا، ٹیکسٹ کو فلٹر کرنا، گہرے اندر کے عناصر کو سنبھالنا اور بہت کچھ۔

عملی طور پر، زیادہ تر ڈویلپرز CSS سلیکٹرز کے ساتھ شروع کرتے ہیں اور صرف XPath کا استعمال کرتے ہیں جب ان کے ڈھانچے بہت پیچیدہ ہو جاتے ہیں۔

یہ خیال ویب کے ابتدائی دنوں سے ہی موجود ہے۔ کسی صفحہ سے معلومات کو دستی طور پر کاپی کرنے کے بجائے، ڈویلپرز نے درخواستیں بھیجنے، HTML جوابات وصول کرنے، اور دلچسپی کے حصوں کو نکالنے کے لیے اسکرپٹ لکھنا شروع کیا۔

اس کے مرکز میں، اس ماڈل میں واقعی کچھ بھی نہیں بدلا ہے۔

یہ اب بھی صفحہ حاصل کرتا ہے، اس کی ساخت کا معائنہ کرتا ہے، اور صفحہ سے ڈیٹا نکالتا ہے۔ فرق آج تصور کا نہیں ہے بلکہ یہ ہے کہ اوزار اور پیمانے کتنے نفیس ہو گئے ہیں۔

روایتی سکریپنگ کے پیچھے اوزار

وقت گزرنے کے ساتھ، اس نقطہ نظر کے ارد گرد ٹولز کا ایک مضبوط ماحولیاتی نظام تیار ہوا ہے۔

-

درخواست یہ HTTP کالوں کے لیے ڈی فیکٹو ازگر کی لائبریری ہے۔ زیادہ تر روایتی سکریپر

requestsصفحہ حاصل کریں اور پھر تجزیہ کے لیے BeautifulSoup کو جواب دیں۔ جامد سائٹس کے لیے سادہ اور قابل اعتماد۔ -

خوبصورت سوپ HTML اور XML کو پارس کرنے کے لیے ایک ازگر کی لائبریری۔ یہ خام ایچ ٹی ایم ایل لیتا ہے اور اس سے نیویگیبل آبجیکٹ ٹری بناتا ہے۔ یہ سیکھنے میں تیز، پڑھنے میں آسان اور جامد صفحات کے لیے بہت اچھا ہے۔ بنیادی حد یہ ہے کہ کوئی براؤزر انجن نہیں ہے لہذا جاوا اسکرپٹ نہیں چل سکتا۔ اگر آپ کی سائٹ صفحہ لوڈ ہونے کے بعد متحرک طور پر مواد پیش کرتی ہے، تو BeautifulSoup کو ایک خالی کنٹینر نظر آئے گا۔

-

سیلینیم اور ڈرامہ نگار یہ ایک براؤزر آٹومیشن ٹول ہے جو اصل براؤزر کو کنٹرول کرتا ہے۔ آپ بٹنوں پر کلک کر سکتے ہیں، اسکرول کر سکتے ہیں، اور ڈیٹا نکالنے سے پہلے JavaScript کے لوڈنگ مکمل ہونے کا انتظار کر سکتے ہیں۔ منفی پہلو یہ ہے کہ یہ سادہ HTTP درخواستوں کے مقابلے میں سست اور وسائل کے لحاظ سے زیادہ ہے، لیکن یہ متحرک سائٹس کے لیے ضروری ہے۔

اصلی، روایتی سکریپنگ

آئیے Books to Scrape کا استعمال کرتے ہوئے ایک ورکنگ سکریپر بنائیں، ایک سینڈ باکس سائٹ جو خاص طور پر ویب سکریپنگ پریکٹس کے لیے بنائی گئی ہے۔ مقصد یہ ہے کہ پہلے صفحہ پر درج تمام کتابوں کا عنوان، قیمت اور درجہ بندی نکالی جائے۔

مرحلہ 1: انحصار انسٹال کریں۔

pip install requests beautifulsoup4

مرحلہ 2: صفحہ کا معائنہ کریں۔

کوڈ کی ایک لائن لکھنے سے پہلے، براؤزر میں ہدف کا صفحہ کھولیں اور اس کے HTML کا معائنہ کریں۔ کتاب کے عنوان پر دائیں کلک کریں اور اس کی ساخت کو چیک کرنے کے لیے "معائنہ کریں” کو منتخب کریں۔

ہر کتاب

-

عنوان میں ہے۔

ٹیگ، اندرعنصر(titleاصل) -

قیمت ہے۔

element -

The star rating is encoded in the CSS class of a

element — for example,means three stars

This is the core detective work of traditional scraping: you study the HTML, find the patterns, and write selectors to match them.

Step 3: Write the Scraper

import requests

from bs4 import BeautifulSoup

# 1. Fetch the page

url = "https://books.toscrape.com/"

response = requests.get(url)

# Always check the request succeeded before going further

if response.status_code != 200:

print(f"Failed to fetch page: {response.status_code}")

exit()

# 2. Parse the HTML

soup = BeautifulSoup(response.content, "html.parser")

# 3. Find all book containers on the page

books = soup.select("article.product_pod")

# 4. Extract data from each book

results = []

for book in books:

# Title is stored as an attribute, not visible text

title = book.select_one("h3 a")["title"]

# Price is the text inside the price element

price = book.select_one("p.price_color").get_text(strip=True)

# Rating is encoded as a word in the CSS class: "star-rating Three"

# We grab the second class name and map it to a number

rating_word = book.select_one("p.star-rating")["class"][1]

rating_map = {"One": 1, "Two": 2, "Three": 3, "Four": 4, "Five": 5}

rating = rating_map.get(rating_word, 0)

results.append({

"title": title,

"price": price,

"rating": rating

})

# 5. Display results

for book in results:

print(f"{book['title']} | {book['price']} | {book['rating']} stars")

مرحلہ 4: چلائیں

python scraper.py

آؤٹ پٹ ہے:

A Light in the Attic | £51.77 | 3 stars

Tipping the Velvet | £53.74 | 1 stars

Soumission | £50.10 | 1 stars

Sharp Objects | £47.82 | 4 stars

Sapiens: A Brief History of Humankind | £54.23 | 5 stars

...

تمام 20 کتابیں منظم اور صاف ستھری ہیں۔

مرحلہ 5: متعدد صفحات تک پھیلائیں۔

سائٹ کے 50 صفحات ہیں۔ تمام اشیاء کو کرال کرنے کے لیے آپ کو سکریپر کو پھیلانے کے لیے "اگلا” بٹن پر عمل کرنے کی ضرورت ہے۔

import requests

from bs4 import BeautifulSoup

BASE_URL = "https://books.toscrape.com/catalogue/"

start_url = "https://books.toscrape.com/catalogue/page-1.html"

all_books = []

url = start_url

while url:

response = requests.get(url)

soup = BeautifulSoup(response.content, "html.parser")

for book in soup.select("article.product_pod"):

title = book.select_one("h3 a")["title"]

price = book.select_one("p.price_color").get_text(strip=True)

rating_word = book.select_one("p.star-rating")["class"][1]

rating_map = {"One": 1, "Two": 2, "Three": 3, "Four": 4, "Five": 5}

rating = rating_map.get(rating_word, 0)

all_books.append({"title": title, "price": price, "rating": rating})

# Check for a "next" button and follow it

next_btn = soup.select_one("li.next a")

url = BASE_URL + next_btn["href"] if next_btn else None

print(f"Scraped {len(all_books)} books total.")

اسے چلانے سے تمام 1000 کتابیں، تمام 50 صفحات پر رینگ جائیں گی۔

یہ نقطہ نظر کمزور کیوں ہے؟

یہ کھرچنی آج اچھی طرح کام کرتی ہے۔ books.toscrape.com یہ ایک جامد اور مستحکم سینڈ باکس ہے۔ پیداواری ماحول میں، اسی نقطہ نظر کی معروف کمزوریاں ہیں۔ اس کا مطلب یہ ہے کہ یہ مکمل طور پر HTML ڈھانچے پر منحصر ہے۔

جب سائٹ ڈویلپر نام تبدیل کرتا ہے۔ product_pod کو book-cardیا قیمت

This is one of the problems AI scraping is designed to address.

What is AI Web Scraping?

Traditional scraping works by following the structure of a page. It looks for specific elements, class names, or patterns in the HTML and extracts data based on those rules.

AI-powered scraping approaches the same problem differently. Instead of relying only on structure, it focuses on understanding the content itself. It looks at a page and identifies what something represents, not just where it's located.

In a traditional scraper, you might write something like:

response.css(".product-card .price::text").get()

یہ نظام کو بالکل بتاتا ہے کہ کہاں دیکھنا ہے۔ تاہم، AI سکریپنگ کے ساتھ، نتائج کو اس طرح بیان کیا گیا ہے:

Extract the product name, price, and availability for each item on this page.

سسٹم صفحہ کو پڑھتا ہے، اس بات کی نشاندہی کرتا ہے کہ کیا پروڈکٹ لسٹنگ دکھائی دیتی ہے، متعلقہ فیلڈز نکالتا ہے، اور سٹرکچرڈ ڈیٹا واپس کرتا ہے۔

ہڈ کے نیچے واقعی کیا ہو رہا ہے؟

AI سکریپنگ پہلے تو جادو کی طرح محسوس ہوسکتی ہے، لیکن یہ مانوس اجزاء کے امتزاج پر بنایا گیا ہے۔

اصل میں بڑے پیمانے پر زبان کے ماڈلز (LLMs) HTML سمیت ویب مواد اور متن کی بڑی مقدار پر تربیت یافتہ۔ وقت گزرنے کے ساتھ، آپ پیٹرن سیکھتے ہیں جیسے کہ پروڈکٹ کی فہرستیں کیسی نظر آتی ہیں، قیمتیں عام طور پر کیسے دکھائی جاتی ہیں، اور ملازمت کی فہرستوں کی ساخت۔

جب ایک صفحہ پیش کیا جاتا ہے، تو ماڈل ان نمونوں کو پہچان سکتا ہے اور صارف کی طرف سے درخواست کردہ فیلڈز میں نقشہ بنا سکتا ہے۔

لیکن ماڈل سسٹم کا صرف ایک حصہ ہے۔ آپ کو صفحہ لوڈ کرنے اور اس کے ساتھ تعامل کرنے کے لیے ابھی بھی کچھ درکار ہے۔ یہ وہیں ہے۔ براؤزر آٹومیشن زیادہ تر AI سکریپنگ ٹولز صفحہ کو رینڈر کرنے، جاوا اسکرپٹ کو چلانے، اور اسکرولنگ یا کلک کرنے جیسی اصل کارروائیوں کو ہینڈل کرنے کے لیے کرومیم جیسا ہیڈ لیس براؤزر یا پلے رائٹ جیسے فریم ورک کا استعمال کرتے ہیں۔

اس کے اوپر ایک پرت ہے جو ان پٹ کی ترجمانی کرتی ہے۔ آپ فوری آپ اپنے مطلوبہ ڈیٹا کی وضاحت کرتے ہیں، اور سسٹم اسے نکالنے کے کام میں بدل دیتا ہے۔ فیصلہ کریں کہ صفحہ کے کون سے حصے شامل ہیں اور آؤٹ پٹ کو کیسے منظم کرنا ہے۔

آخر میں، سسٹم نتائج کو صاف ڈیٹا، عام طور پر JSON یا CSV میں فارمیٹ کرتا ہے، تاکہ اسے کم سے کم پوسٹ پروسیسنگ کے ساتھ براہ راست استعمال کیا جا سکے۔

میمو: ChatGPT جیسے ٹولز مواد کی ترجمانی کر سکتے ہیں، لیکن وہ سسٹم کو ختم نہیں کرتے ہیں۔ یہ صفحات کو کرال نہیں کرتا، ورک فلو پر کارروائی نہیں کرتا، یا دوبارہ قابل ڈیٹا نکالنے کو نہیں چلاتا۔ AI سکریپنگ ٹولز اس ذہانت کو اس بنیادی ڈھانچے کے ساتھ جوڑتے ہیں جو قابل اعتماد طریقے سے ڈیٹا اکٹھا کرنے کے لیے درکار ہے۔

AI سکریپنگ کے پیچھے مشہور ٹولز

جیسا کہ AI سکریپنگ زیادہ مقبول ہو گئی ہے، مختلف قسم کے ٹولز ابھرے ہیں جو شروع سے ہر چیز کو بنائے بغیر اس نقطہ نظر کو قابل رسائی بناتے ہیں۔

مثال کے طور پر:

-

سپیڈرا ہم نکالنے کے لیے بہت سیدھا طریقہ اختیار کرتے ہیں۔ آپ اپنے مطلوبہ ڈیٹا کی وضاحت کرتے ہیں، اور ہم صفحہ کو لوڈ کرنے، مواد کی تشریح، اور ساختی نتائج واپس کرنے کا خیال رکھتے ہیں۔ یہ پردے کے پیچھے نیویگیشن اور تعامل جیسی چیزوں کا بھی انتظام کرتا ہے، جو مفید ہے اگر آپ سلیکٹرز کی فکر کیے بغیر یا سکریپنگ منطق کو برقرار رکھتے ہوئے ڈیٹا نکالنا چاہتے ہیں۔

-

آگ رینگنا ہم ویب صفحات کو صاف، منظم مواد میں تبدیل کرنے پر توجہ مرکوز کرتے ہیں۔ قیمت یا عنوان جیسے مخصوص فیلڈز کو نکالنے کے بجائے، پورے صفحہ کو مارک ڈاؤن یا آسان JSON جیسے فارمیٹ میں تبدیل کریں۔ یہ خاص طور پر مفید ہے اگر آپ ویب مواد کو AI سسٹم میں فیڈ کرنا چاہتے ہیں یا گندے HTML سے نمٹنے کے بغیر اس کے ساتھ پڑھنے کے قابل فارمیٹ میں کام کرنا چاہتے ہیں۔

-

جینا لیڈر ویب صفحات کو صاف متن میں آسان بنانے کے لیے ڈیزائن کیا گیا ہے۔ لے آؤٹ شور کو ہٹا دیں جیسے نیویگیشن، اشتہارات، اور طرزیں اور اصل مواد پر توجہ مرکوز کریں۔ یہ اس وقت مفید ہوتا ہے جب آپ کا مقصد کسی صفحہ پر موجود معلومات کو سمجھنا یا اس پر کارروائی کرنا ہو بجائے اس کے کہ ساختی فیلڈز نکالیں۔

-

برائٹ ڈیٹا اے آئی سکریپر یہ ایک طاقتور سکریپنگ انفراسٹرکچر کے ساتھ AI سے چلنے والے نکالنے کو جوڑتا ہے۔ یہ آپ کو سلیکٹرز کو لکھے بغیر سٹرکچرڈ ڈیٹا کی درخواست کرنے کی اجازت دیتا ہے، اور بلاکنگ اور اسکیلنگ جیسے مسائل کو بھی ہینڈل کرتا ہے۔ یہ اسے بڑے یا مطالبہ کرنے والے سکریپنگ آپریشنز کے لیے بہتر بناتا ہے۔

-

اپلائی کریں۔ یہ روایتی سکریپنگ اور AI پر مبنی سکریپنگ کے درمیان کہیں آتا ہے۔ یہ سکریپر بنانے اور چلانے کے لیے ایک مکمل پلیٹ فارم مہیا کرتا ہے، جس سے آپ کو AI متعارف کرانے کی اجازت ملتی ہے جہاں مناسب ہو، جیسے نکالنے یا پوسٹ پروسیسنگ۔ جب آپ کو پوری پائپ لائن پر مزید کنٹرول کی ضرورت ہو تو یہ مفید ہے۔

حقیقت میں، یہ ٹولز بالکل اسی مسئلے کو حل کرنے کی کوشش نہیں کرتے ہیں۔ کچھ سٹرکچرڈ ڈیٹا نکالنے پر توجہ مرکوز کرتے ہیں، کچھ مواد کی صفائی پر، اور کچھ مکمل سکریپنگ ورک فلو بنانے پر۔ صحیح کا انتخاب نہ صرف خود ٹول پر منحصر ہوگا بلکہ اس بات پر بھی کہ آپ کیا حاصل کرنے کی کوشش کر رہے ہیں۔

اصلی AI سکریپنگ

آئیے کتابیں نکالنے کے لیے ڈیٹا اکٹھا کرنے کا وہی کام چلائیں۔ books.toscrape.com AI سکریپنگ ٹولز استعمال کریں۔ ہم اسپیڈرا کا API استعمال کریں گے تاکہ یہ دیکھیں کہ کیا تبدیلیاں آتی ہیں۔

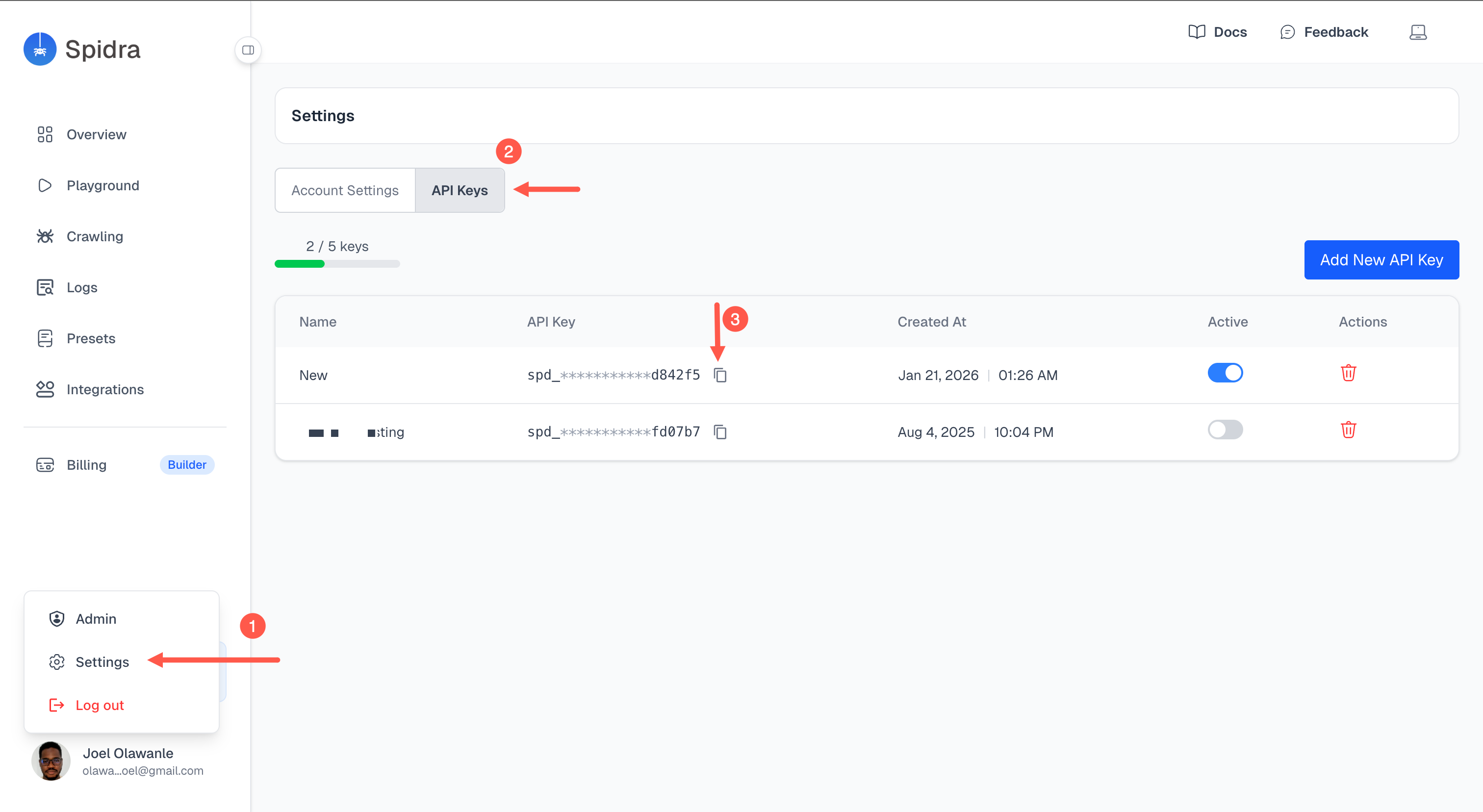

مرحلہ 1: ایک API کلید حاصل کریں۔

spidra.io کے لیے سائن اپ کریں اور اپنے ڈیش بورڈ سے ایک API کلید بنائیں۔ یہ کلید تمام درخواستوں کی تصدیق کے لیے استعمال ہوتی ہے۔

مرحلہ 2: API کی ساخت کو سمجھیں۔

Spidra کا سکریپنگ اینڈ پوائنٹ JSON پے لوڈ کو قبول کرتا ہے۔ دو اہم ترین شعبے ہیں۔ url (کہاں کھرچنا ہے) اور prompt (کیا نکالنا ہے، سادہ انگریزی میں لکھا ہوا) اختیاری طور پر، آپ وضاحت کر سکتے ہیں: output فارمیٹ — JSON سٹرکچرڈ ڈیٹا کے لیے بہترین موزوں ہے۔

POST https://api.spidra.io/scrape

Authorization: Bearer YOUR_API_KEY

Content-Type: application/json

جیسا کہ آپ دیکھ سکتے ہیں، یہاں کوئی سلیکٹرز یا HTML معائنہ درکار نہیں ہے۔ آپ کو صرف ایک URL اور تفصیل کی ضرورت ہے۔

یہاں API کال کے بطور لکھے گئے موجودہ کھرچنے والے کے برابر ہے۔

import requests

import json

API_KEY = "your_api_key_here"

payload = {

"urls": [{"url": "https://books.toscrape.com/"}],

"prompt": "Extract all books on this page. For each book, return the title, price, and star rating as a number from 1 to 5.",

"output": "json"

}

response = requests.post(

"https://api.spidra.io/scrape",

headers={

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

},

json=payload

)

data = response.json()

print(json.dumps(data, indent=2))

یہ ساری کھرچنی ہے۔ نہیں BeautifulSoupکوئی سلیکٹر منطق اور HTML پارس نہیں ہے۔

مرحلہ 4: آؤٹ پٹ کو سمجھیں۔

API ایک منظم JSON جواب دیتا ہے۔ ہر کتاب کو بیان کردہ فیلڈز کے ساتھ ایک آبجیکٹ کے طور پر پیش کیا جاتا ہے۔

{

"results": [

{

"title": "A Light in the Attic",

"price": "£51.77",

"rating": 3

},

{

"title": "Tipping the Velvet",

"price": "£53.74",

"rating": 1

},

{

"title": "Soumission",

"price": "£50.10",

"rating": 1

}

...

]

}

ماڈل نے ستارے کی درجہ بندی کی انکوڈنگز کی نشاندہی کی (star-rating Three → 3) یہ آپ کو نہیں بتاتا کہ درجہ بندی کا اظہار کیسے کیا جاتا ہے۔ میں نے "1 سے 5 تک نمبر کے طور پر دکھائے جانے والے ستارے کی درجہ بندی" کے ارادے کو سمجھا اور خود نقشہ سازی کا خیال رکھا۔

مرحلہ 5: ملٹی سٹیپ ورک فلوز میں کاموں کا استعمال کریں۔

جہاں AI سکریپنگ حقیقی فوائد دکھانا شروع کرتی ہے وہ ورک فلو میں ہے جس کے لیے روایتی سکریپرز میں اہم انجینئرنگ کی ضرورت ہوتی ہے۔

فرض کریں کہ آپ ہر کتاب کے لیے تفصیلات کے صفحے پر جانا چاہتے ہیں اور اس کی مکمل تفصیل اور دستیابی کی حیثیت کو نکالنا چاہتے ہیں (صرف وہی نہیں جو فہرست کے صفحہ پر ظاہر ہوتا ہے)۔

روایتی سکریپر میں، اس کا مطلب ہے فالو لنکس کا ایک لوپ بنانا، ریاست کا انتظام کرنا، ہر تفصیل والے صفحے پر غلطیوں کو ہینڈل کرنا، اور تفصیل کے صفحے پر مختلف ڈھانچے کے لیے الگ الگ سلیکٹرز کو برقرار رکھنا۔ AI سکریپر جیسے Spidra براؤزر کے اعمال اور حقیقی انسانی تعاملات کی نقل کر سکتے ہیں۔

{

"urls": [{

"url": "https://books.toscrape.com/catalogue/category/books/mystery_3/index.html",

"actions": [{

"type": "forEach",

"observe": "Find all book cards in the product grid",

"mode": "inline",

"captureSelector": "article.product_pod",

"maxItems": 10,

"itemPrompt": "Extract the book title, price, and star rating (One/Two/Three/Four/Five). Return as JSON: {title, price, star_rating}"

}]

}]

}

سسٹم ہر کتاب کے صفحہ پر جاتا ہے، نئے مواد کو پڑھتا ہے، اضافی فیلڈز نکالتا ہے، اور انہیں اسی نتیجہ کے سیٹ کے حصے کے طور پر واپس کرتا ہے۔

آپ اپنے ڈیٹا کو کسی بھی طرح سے ترتیب دے سکتے ہیں۔

{

"urls": [{ "url": "https://jobs.example.com/senior-engineer" }],

"prompt": "Extract the job details",

"schema": {

"type": "object",

"required": ["title", "company", "remote", "employment_type"],

"properties": {

"title": { "type": "string" },

"company": { "type": "string" },

"location": { "type": ["string", "null"] },

"remote": { "type": ["boolean", "null"] },

"salary_min": { "type": ["number", "null"] },

"salary_max": { "type": ["number", "null"] },

"employment_type": {

"type": ["string", "null"],

"enum": ["full_time", "part_time", "contract", null]

},

"skills": {

"type": "array",

"items": { "type": "string" }

}

}

}

}

ان AI سکریپرز میں مزید خصوصیات ہیں جیسے بیچ سکریپنگ، AI کرالنگ وغیرہ۔

جہاں AI سکریپنگ رہتی ہے۔

اب ہم کہتے ہیں کہ آپ کی سائٹ اپنے فرنٹ اینڈ کو اپ ڈیٹ کرتی ہے۔ کلاس product_pod اگلا، نام بدل جاتا ہے۔ book-card. قیمت دوسرے عوامل کی طرف جاتی ہے۔

روایتی سکریپر کے ساتھ، نتیجہ صفر ہے اور اس وقت تک کوئی غلطیاں نہیں ہیں جب تک کہ آپ اس بات کا تعین نہ کر لیں کہ ڈیٹا غائب ہے۔ پھر صفحہ کو دوبارہ چیک کریں، سلیکٹر کو اپ ڈیٹ کریں، ٹیسٹ کریں اور دوبارہ تعینات کریں۔

AI سکریپر وہی پرامپٹ جاری کرتا ہے۔ یہ وہ نہیں ہے جس کی ماڈل تلاش کر رہا ہے۔ product_pod یا price_color. آپ قیمتوں کی معلومات کے ساتھ مصنوعات کی فہرست سے ملتا جلتا مواد تلاش کر رہے ہیں۔ لے آؤٹ تبدیلیاں نکالنے کی منطق کو نظر نہیں آتی ہیں۔

یہ AI نقطہ نظر کا ایک اہم آپریشنل فائدہ ہے۔ صفحہ میں ساختی تبدیلیاں خود بخود نکالنا بند نہیں کرتی ہیں۔

روایتی سکریپنگ بمقابلہ AI سکریپنگ: کب استعمال کریں؟

اس وقت دونوں طریقوں کے درمیان فرق واضح ہے۔ زیادہ اہم سوال یہ ہے کہ کیا ہر چیز عملی طور پر معنی رکھتی ہے؟

اگر آپ اس کے بارے میں مختصراً سوچیں تو یہ اس طرح ہے:

| سکرپٹ | روایتی سکریپنگ | AI سکریپنگ |

|---|---|---|

| مستحکم ویب سائٹ | بہترین انتخاب | کام کرتا ہے، لیکن بعض اوقات حد سے زیادہ ہو سکتا ہے۔ |

| وہ لے آؤٹ جو اکثر بدلتے رہتے ہیں۔ | کثرت سے آرام کریں۔ | زیادہ لچکدار |

| بڑے پیمانے پر کرال | زیادہ سرمایہ کاری مؤثر | موثر، لیکن مہنگا ہو سکتا ہے۔ |

| تیز رفتار پروٹو ٹائپنگ | سست ترتیبات | بہت تیز |

| غیر تکنیکی صارفین | کوڈنگ درکار ہے۔ | زیادہ قابل رسائی |

| مکمل کنٹرول اور شفافیت | ہائی کنٹرول | کم شفاف |

| گندا یا متضاد ڈیٹا | برقرار رکھنا مشکل | ہینڈل کرنا آسان ہے۔ |

| پیچیدہ ورک فلو (لاگ ان، مراحل) | ممکن لیکن دستی | اکثر بلٹ ان |

یہ واقعی دونوں کے درمیان منقطع انتخاب نہیں ہے۔ روایتی سکریپنگ اس وقت بہترین کام کرتی ہے جب سب کچھ قابل قیاس اور مستحکم ہو۔ جب صورت حال پیچیدہ، متحرک، یا وقت کے لحاظ سے حساس ہو تو AI سکریپنگ مفید ہے۔ زیادہ تر حقیقی دنیا کے نظام صرف ایک پر انحصار کرنے کے بجائے دونوں طریقوں کو یکجا کرتے ہیں۔

ختم

ویب سکریپنگ ختم نہیں ہو رہی ہے۔ کیا تبدیلی ہے کہ ہم اس سے کیسے رجوع کرتے ہیں۔

روایتی سکریپنگ کنٹرول اور درستگی فراہم کرتی ہے، لیکن اسے برقرار رکھنے میں نازک اور وقت لگ سکتا ہے۔ AI سکریپنگ آپ کے کام کو تیز تر اور زیادہ لچکدار بناتی ہے، خاص طور پر جب گندے یا مسلسل صفحات کو تبدیل کرتے ہوئے، لیکن شفافیت کی قیمت پر۔

درحقیقت، زیادہ تر حقیقی دنیا کے ورک فلو ان دونوں کو یکجا کرنا شروع کر رہے ہیں۔

ہم AI سکریپنگ ٹولز کو بڑے سسٹمز میں ضم ہوتے دیکھنا بھی شروع کر رہے ہیں، خاص طور پر AI ایجنٹس اور MCP طرز کے سیٹ اپ کے ساتھ۔ یہاں سکریپنگ کو ہر بار شروع سے تعمیر کرنے کی بجائے مانگ پر چلایا جاسکتا ہے۔

بات سادہ ہے۔ روایتی سکریپنگ سسٹم کو بتاتی ہے کہ ڈیٹا کہاں ہے۔ AI سکریپنگ سسٹم کو بتاتی ہے کہ ڈیٹا کا کیا مطلب ہے۔

یہ جاننا کہ ہر ایک کو کب استعمال کرنا ہے۔

اگر آپ نے اب تک پڑھا ہے تو مصنف میں دلچسپی کا شکریہ۔

مفت میں کوڈ سیکھیں۔ freeCodeCamp کے اوپن سورس نصاب نے 40,000 سے زیادہ لوگوں کو بطور ڈیولپر ملازمتیں فراہم کرنے میں مدد کی ہے۔ شروع کرنا