مصنوعی ذہانت (AI) نے گزشتہ برسوں میں قابل ذکر ترقی کی ہے، AI ماڈلز کے سائز اور پیچیدگی میں اضافہ ہوا ہے۔

آج توجہ حاصل کرنے والے جدید طریقوں میں سے ماہرین کا مرکب (MoE) فن تعمیر ہے۔ یہ طریقہ پروسیسنگ کے کاموں کو خصوصی سب نیٹ ورکس میں تقسیم کرکے AI ماڈل کی کارکردگی کو بہتر بناتا ہے جسے "ماہرین” کہا جاتا ہے۔

اس آرٹیکل میں، ہم دیکھیں گے کہ یہ فن تعمیر کیسے کام کرتا ہے، اسپارسٹی کا کردار، روٹنگ کی حکمت عملی، اور Mixtral ماڈل کے عملی استعمال۔ ہم ان نظاموں کو درپیش چیلنجز اور ان سے نمٹنے کے لیے تیار کیے گئے حل پر بھی بات کرتے ہیں۔

ہم کیا احاطہ کریں گے:

ماہرین کے مرکب (MoE) کے نقطہ نظر کو سمجھیں۔

مکسچر آف ایکسپرٹس (MoE) ایک مشین لرننگ تکنیک ہے جو AI ماڈلز کو چھوٹے، خصوصی نیٹ ورکس میں تقسیم کرتی ہے، ہر ایک مخصوص کام پر مرکوز ہے۔

یہ ایک ایسی ٹیم بنانے کے مترادف ہے جہاں ہر رکن کے پاس مخصوص کام کے لیے موزوں مہارت ہوتی ہے۔

خیال نیا نہیں ہے۔ یہ 1991 کے ایک تاریخی مقالے پر واپس جاتا ہے جس میں مختلف تربیتی طریقوں میں مہارت رکھنے والے علیحدہ نیٹ ورکس کے فوائد کو اجاگر کیا گیا تھا۔

آج، MoE ایک بحالی کا سامنا کر رہا ہے، خاص طور پر بڑے پیمانے پر زبان کے ماڈلز کے درمیان جو کارکردگی اور تاثیر کو بڑھانے کے لیے اس نقطہ نظر کا فائدہ اٹھاتے ہیں۔

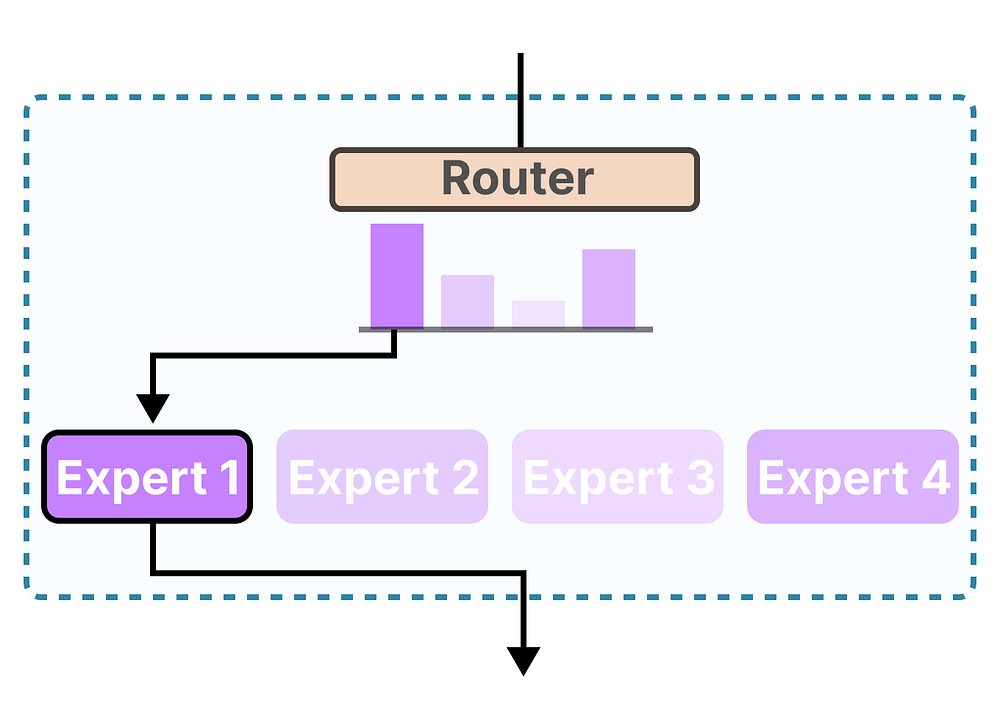

بنیادی طور پر، یہ نظام کئی اجزاء پر مشتمل ہے: ان پٹ لیئر، ملٹی ایکسپرٹ نیٹ ورک، گیٹنگ نیٹ ورک، اور آؤٹ پٹ لیئر۔

گیٹنگ نیٹ ورک ایک کوآرڈینیٹر کے طور پر کام کرتا ہے اور یہ فیصلہ کرتا ہے کہ کسی مخصوص کام کے لیے کس ماہر نیٹ ورک کو چالو کیا جانا چاہیے۔

اس سے ایم او ای کی ہر کام میں پورے نیٹ ورک کو شامل کرنے کی ضرورت نمایاں طور پر کم ہو جاتی ہے۔ یہ کارکردگی کو بہتر بناتا ہے اور کمپیوٹیشنل اوور ہیڈ کو کم کرتا ہے۔

AI ماڈلز میں کمی کا کردار

MoE فن تعمیر کا ایک لازمی تصور sparsity ہے۔ اس کا مطلب ہے کہ ہر پروسیسنگ ٹاسک کے لیے ماہرین کے صرف ذیلی سیٹ کو فعال کرنا ہے۔

اسپارسٹی اس بات کو یقینی بناتی ہے کہ نیٹ ورک کے تمام وسائل کو شامل کرنے کے بجائے صرف متعلقہ ماہرین اور ان کے پیرامیٹرز کا استعمال کیا جائے۔ یہ ہدف کا انتخاب کمپیوٹیشنل تقاضوں کو نمایاں طور پر کم کرتا ہے، خاص طور پر جب پیچیدہ، اعلیٰ جہتی ڈیٹا جیسے کہ قدرتی لینگویج پروسیسنگ کے کاموں پر کارروائی کرتے ہیں۔

ویرل ماڈل بہترین ہیں کیونکہ وہ خصوصی پروسیسنگ کی اجازت دیتے ہیں۔ مثال کے طور پر، کسی جملے کے مختلف حصوں کے لیے الگ الگ قسم کے تجزیے کی ضرورت پڑ سکتی ہے۔ ایک ماہر محاورات کو سمجھنے میں اچھا ہو سکتا ہے، جبکہ دوسرا پیچیدہ گرائمیکل ڈھانچے کا تجزیہ کرنے میں ماہر ہو سکتا ہے۔

صرف ضروری ماہرین کو فعال کرنے سے، MoE ماڈلز ان پٹ ڈیٹا کا زیادہ درست اور موثر تجزیہ فراہم کر سکتے ہیں۔

MoE فن تعمیر میں روٹنگ ٹیکنالوجی

روٹنگ ماہر مکس ماڈل کا ایک اور اہم جزو ہے۔

گیٹنگ نیٹ ورک یہاں ایک اہم کردار ادا کرتا ہے کیونکہ یہ تعین کرتا ہے کہ ہر ان پٹ کے لیے کس ماہر کو چالو کرنا ہے۔ ایک کامیاب روٹنگ حکمت عملی اس بات کو یقینی بناتی ہے کہ نیٹ ورک موزوں ترین ماہرین کا انتخاب کرے، کارکردگی کو بہتر بنائے، اور پورے نیٹ ورک میں توازن برقرار رکھے۔

عام طور پر، روٹنگ کے عمل میں یہ پیشین گوئی شامل ہوتی ہے کہ کون سا ماہر دیے گئے ان پٹ کے لیے بہترین آؤٹ پٹ فراہم کرے گا۔ یہ پیشین گوئی ماہر اور ڈیٹا کے درمیان تعلق کی مضبوطی کی بنیاد پر کی گئی ہے۔

ایک مقبول حکمت عملی "ٹاپ-کے” روٹنگ کا طریقہ ہے، جو کہ کام کے لیے موزوں ترین ماہرین کا انتخاب کرتا ہے۔ عملی طور پر، "ٹاپ ٹو” روٹنگ نامی ایک مختلف قسم کا اکثر استعمال کیا جاتا ہے، جو بہترین دو ماہرین کو متحرک کرتا ہے، کارکردگی اور کمپیوٹیشنل لاگت کو متوازن کرتا ہے۔

لوڈ بیلنسنگ چیلنجز اور حل

اگرچہ MoE ماڈل کے واضح فوائد ہیں، لیکن یہ کچھ چیلنجز بھی پیش کرتا ہے، خاص طور پر لوڈ بیلنسنگ کے حوالے سے۔

ایک ممکنہ مسئلہ یہ ہے کہ گیٹنگ نیٹ ورک مستقل طور پر ماہرین کی ایک چھوٹی سی تعداد کو منتخب کر سکتا ہے، جس کے نتیجے میں کام کی غیر مساوی تقسیم ہوتی ہے۔ اس عدم توازن کے نتیجے میں کچھ پیشہ ور افراد کو ضرورت سے زیادہ استعمال کیا جاتا ہے اور اس کے نتیجے میں زیادہ تربیت دی جاتی ہے، جب کہ دوسروں کو کم استعمال کیا جاتا ہے۔

اس مسئلے کو حل کرنے کے لیے، محققین نے "شور ٹاپ-کے” گیٹنگ تیار کی، ایک ایسی تکنیک جو انتخاب کے عمل میں گاوسی شور کو متعارف کراتی ہے۔ یہ ماہرین کی زیادہ متوازن سرگرمی کو فروغ دیتے ہوئے، کنٹرول شدہ بے ترتیب پن کا عنصر متعارف کراتا ہے۔

ماہرین میں کام کے بوجھ کو زیادہ یکساں طور پر تقسیم کرنے سے، یہ نقطہ نظر نااہلی کے خطرے کو کم کرتا ہے اور مجموعی نیٹ ورک کی کارکردگی کو برقرار رکھتا ہے۔

اصل میں MoE تخمینہ کے دوران کیا ہوتا ہے۔

ماہر مکس آرکیٹیکچر کو مزید ٹھوس بنانے کے لیے، یہ دیکھنا مددگار ہے کہ ایک درخواست کے دوران کیا ہوتا ہے۔

مندرجہ ذیل اشارے پر غور کریں:

"وضاحت کریں کہ کیش فلو کے ناقص انتظام کی وجہ سے اسٹارٹ اپ کیوں ناکام ہو جاتے ہیں۔”

روایتی گھنے ماڈل میں، ہر پرت اور ہر پیرامیٹر ردعمل پیدا کرنے میں حصہ ڈالتا ہے۔ MoE ماڈل میں، عمل زیادہ منتخب ہے۔

جیسے ہی ان پٹ پر کارروائی ہوتی ہے، ہر پرت اپنی ٹوکن نمائندگی گیٹنگ نیٹ ورک کو دیتی ہے۔ یہ جزو تمام دستیاب ماہرین کا جائزہ لیتا ہے اور ان پٹ سے ان کی مطابقت کی بنیاد پر انہیں ایک اسکور تفویض کرتا ہے۔ پورے نیٹ ورک کو چالو کرنے کے بجائے، ماڈل صرف اعلی k ماہرین (عام طور پر 2) کا انتخاب کرتا ہے۔

اس مثال کے لیے، گیٹنگ نیٹ ورک منتخب کر سکتا ہے:

صرف منتخب ماہرین ہی انٹرمیڈیٹ آؤٹ پٹ تیار کرنے کے لیے ان پٹ پر کارروائی کرتے ہیں، جو پھر یکجا ہو کر اگلی پرت میں منتقل ہو جاتے ہیں۔ باقی ماہرین اپنے ٹوکن کے لیے غیر فعال رہتے ہیں۔

انتخاب اور امتزاج کا یہ عمل متعدد تہوں میں دہرایا جاتا ہے۔ اس کا مطلب یہ ہے کہ ماڈل کے کل پیرامیٹرز کا صرف ایک چھوٹا فیصد کسی بھی مقام پر استعمال ہوتا ہے۔

نتیجہ ایک ایسا نظام ہے جو ایک بڑے، زیادہ طاقتور ماڈل کی طرح برتاؤ کرتا ہے، لیکن حساب کے لحاظ سے، چھوٹے ماڈل کی طرح چلتا ہے۔ یہ MoE کے لیے ایک حقیقی فائدہ ہے۔ یہ نہ صرف ماڈل کی صلاحیت کو بہتر بناتا ہے، بلکہ اس بات کو بھی یقینی بناتا ہے کہ صلاحیت کو ہر درخواست کے لیے منتخب اور مؤثر طریقے سے استعمال کیا جائے۔

عملی درخواست: Mixtral ماڈل

ماہرین فن تعمیر کے مرکب کی ایک حقیقی دنیا کی مثال Mixtral ماڈل ہے۔ یہ اوپن سورس، بڑے پیمانے پر لینگویج ماڈل یہ ظاہر کرتا ہے کہ MoE کس طرح ٹاسک پروسیسنگ کی کارکردگی کو بہتر بنا سکتا ہے۔

Mixtral ماڈل کی ہر پرت آٹھ ماہرین پر مشتمل ہے، ہر ایک 7 بلین پیرامیٹرز کے ساتھ۔ جیسا کہ ماڈل ان پٹ ڈیٹا میں ہر ٹوکن پر کارروائی کرتا ہے، گیٹنگ نیٹ ورک دو موزوں ترین ماہرین کا انتخاب کرتا ہے۔ یہ ماہرین کاموں پر کارروائی کرتے ہیں، اور اگلے ماڈل کی پرت پر جانے سے پہلے ان کے نتائج کو یکجا کیا جاتا ہے۔

یہ نقطہ نظر Mixtral کو بڑی زبان کے ماڈلز کے مقابلے میں بظاہر معمولی سائز کے باوجود اعلی کارکردگی فراہم کرنے کی اجازت دیتا ہے۔ وسائل کو مؤثر طریقے سے استعمال کرنے اور پیشہ ورانہ پروسیسنگ کو یقینی بنا کر، Mixtral AI ٹیکنالوجیز کو آگے بڑھانے میں MoE فن تعمیر کی صلاحیت کو ظاہر کرتا ہے۔

نتیجہ

ماہرین فن تعمیر کا مرکب موثر AI نظام تیار کرنے میں ایک اہم قدم کی نمائندگی کرتا ہے۔ خصوصی پروسیسنگ اور وسائل کی اصلاح پر اپنی توجہ کے ساتھ، MoE بہت سے فوائد پیش کرتا ہے، خاص طور پر بڑے زبان کے ماڈلز کے لیے۔

کلیدی تصورات جیسے سپیرسٹی اور موثر روٹنگ اس بات کو یقینی بناتے ہیں کہ یہ ماڈل پیچیدہ کاموں کو درستگی کے ساتھ سنبھال سکتے ہیں، جب کہ شور مچانے والی Top-K گیٹنگ جیسی اختراعات بوجھ کے توازن میں عام چیلنجوں کو حل کرتی ہیں۔

اپنی پیچیدگی اور محتاط ٹیوننگ کی ضرورت کے باوجود، MoE نقطہ نظر AI ماڈل کی کارکردگی کو بہتر بنانے کے لیے امید افزا ہے۔ جیسا کہ AI آگے بڑھتا جا رہا ہے، MoE جیسے فن تعمیرات اگلی نسل کے ذہین نظاموں کو طاقت دینے میں زیادہ کارکردگی اور خصوصی پروسیسنگ کی صلاحیتیں فراہم کر کے اہم کردار ادا کر سکتے ہیں۔

مجھے امید ہے کہ آپ نے اس مضمون کا لطف اٹھایا۔ مزید مضامین اپنے ان باکس میں پہنچانے کے لیے ہمارے مفت نیوز لیٹر کے لیے سائن اپ کریں۔ آپ مجھ سے Linkedin پر بھی رابطہ کر سکتے ہیں۔