2025 میں سیلیکون ویلی میں منتقل ہونے کے بعد، میں نے ہر جگہ AI دیکھا ہے۔ اور NVIDIA GTC 2025 میں شرکت کے بعد میری بہت سی بات چیت سے، ایک چیز بالکل واضح ہوگئی: فی الحال، زیادہ تر کمپنیاں مختلف پروجیکٹس یا محکموں میں AI ایجنٹس کو کامیابی سے چلا رہی ہیں۔

لیکن بہت کم لوگ اسے اپنی تنظیموں میں اچھی طرح سے نافذ کرتے ہیں۔ یہاں تک کہ جب ایجنٹوں کو تعینات کیا جاتا ہے، وہ اکثر مناسب طریقے سے ترتیب نہیں دیتے ہیں۔

کمپنیاں ڈیلیوری ایجنسی کا نظام چلاتی ہیں جو تقریباً مکمل طور پر اندازے پر انحصار کرتی ہے۔

میں نے جو سوالات سنے ہیں ان میں سے کچھ یہ ہیں:

-

آپ کی ٹیم میں AI ایجنٹوں کی مناسب تعداد کتنی ہے؟

-

استعمال کرنے کے لیے بہترین ماڈل فراہم کنندہ کیا ہے؟

-

کیا ایجنٹوں کے پاس نگرانی کرنے والا "باس” ایجنٹ ہونا چاہیے، یا انھیں ہم مرتبہ ہم آہنگی کرنی چاہیے؟

اس نے کہا، اہم سوالات یہ ہیں:

آپ کی AI ایجنٹ ٹیم کے لیے کون سا تنظیمی ڈھانچہ بہترین ہے؟

اس مضمون میں اس کا واضح جواب دینے کی کوشش کی گئی ہے۔

میں نے پہلے AI کے پیچھے ریاضی کے بارے میں ایک کتاب لکھی ہے، لہذا میں یہاں ریاضی نہیں کروں گا۔

اس کے بجائے، ہم اس بات پر توجہ مرکوز کریں گے کہ حقیقی دنیا کے کاروباری معاملات کے لیے ایجنٹوں کو کیسے ترتیب دیا جائے۔

ہم حالیہ AI پیپر کا استعمال کریں گے Towards a Science of Scaling Agent Systems: کب اور کیوں ایجنٹ سسٹمز گوگل ریسرچ، گوگل ڈیپ مائنڈ اور MIT سے ہمارے بنیادی ماخذ کے طور پر کام کرتے ہیں۔

اپنے کوڈ کے لیے، ہم Google Collab کی Jupyter نوٹ بک استعمال کریں گے۔

یہاں ہم کیا احاطہ کریں گے:

شرائط

AI ایجنٹ بنانے کے لیے آپ کو پیشہ ور ڈویلپر بننے کی ضرورت نہیں ہے۔ بہت سے بغیر کوڈ والے ٹولز ہیں جو اس عمل میں آپ کی مدد کر سکتے ہیں۔

تاہم، یہاں دی گئی مثالوں سے زیادہ سے زیادہ فائدہ اٹھانے اور یہ دیکھنے کے لیے کہ ایجنٹ کیا کر رہا ہے اور یہ سمجھنے کے لیے کہ وہ کیا کر رہا ہے، آپ کو درج ذیل چیزوں کی ضرورت ہو گی:

-

Python اور LLM کی عمومی تفہیم۔

-

میں نے اپنے کمپیوٹر پر اولاما کو مقامی طور پر مقامی طور پر مفت چلانے کے لیے انسٹال کیا۔

-

Jupyter نوٹ بک ترتیب دینا۔ اگر آپ کے پاس مقامی ہارڈویئر محدود ہے یا آپ کو کلاؤڈ GPU کی ضرورت ہے، تو ہم Google Colab کی انتہائی سفارش کرتے ہیں۔

آئیے اس میں داخل ہوں!

ایل ایل ایم کیا ہے؟

ایک ایل ایل ایم (بڑی زبان کا ماڈل) ایک باشعور انٹرن کی طرح ہے جس نے کبھی لائبریری نہیں چھوڑی۔

LLM تقریبا کسی بھی طرز کا حوالہ، خلاصہ، ترجمہ اور نقل کر سکتا ہے۔ آپ ایک ہی وقت میں ازگر کے اسکرپٹ اور شیکسپیئر کے سونیٹ لکھ سکتے ہیں!

لیکن اس کی اپنی حدود ہیں۔ مثال کے طور پر، جب LLM کو یقین نہیں ہوتا ہے، تو وہ اکثر اسی اعتماد کے ساتھ کچھ تیار کرتے ہیں جس کا استعمال وہ کسی ایسے موضوع پر کریں گے جس کے بارے میں انہیں یقین ہے۔

اسے ہیلوسینیشن کہتے ہیں۔

نیز، LLM میں بنیادی طور پر بات چیت کے درمیان کوئی میموری نہیں ہے اور وہ خود کچھ نہیں کر سکتا۔ مثال کے طور پر، اکیلا LLM آپ کو ای میل بھیجنے کا طریقہ سکھا سکتا ہے، لیکن یہ آپ کو ای میل بھیجنے کا طریقہ نہیں سکھا سکتا۔

یہ وہ جگہ ہے جہاں ایجنٹ آتے ہیں۔

AI ایجنٹ کیا ہے؟

اگر ایک LLM ایک انٹرن کی طرح ہے، تو ایک AI ایجنٹ وہی انٹرن ہے، جسے ایک ڈیسک، ایک لیپ ٹاپ، ایک کرنے کی فہرست اور کام کرنے کی صلاحیت دی جاتی ہے۔

ایک ایجنٹ بنیادی طور پر ٹولز، میموری اور لوپس میں لپٹا ہوا LLM ہوتا ہے۔

ٹولز ایجنٹوں کو ویب پر تلاش کرنے، مخصوص فائلوں کو پڑھنے، ای میل بھیجنے، اور کوڈ چلانے جیسے کام انجام دینے کی اجازت دیتے ہیں۔ میموری ایل ایل ایم کو یہ یاد رکھنے کی اجازت دیتی ہے کہ انہوں نے پہلے دوسرے کاموں پر کیا کیا ہے۔ ایک لوپ صرف ایک کوڈ ہے جو LLM کو سوچنے، ایک ٹول کو کال کرنے، نتائج کو چیک کرنے، اور کام مکمل ہونے تک دوبارہ سوچنے پر مجبور کرتا ہے۔

بہت سے معاملات میں، انفرادی ایجنٹ بہت مفید ہیں. لیکن کیا ہوتا ہے جب کام ایک انٹرن (یا، اس معاملے میں، ایجنٹ) کے لیے بہت بڑا ہو؟

یقیناً ہم مزید انٹرنز کی خدمات حاصل کر سکتے ہیں! لیکن ایک نیا مسئلہ پیدا ہوتا ہے۔

-

کیا مجھے طویل کام کی فہرست (سنگل ایجنٹ) کے ساتھ ایک انٹرن کی خدمات حاصل کرنی چاہئے؟

-

کیا تمام 5 انٹرنز کو ایک ہی کام آزادانہ طور پر انجام دینا چاہئے (آزاد ملٹی ایجنٹ)؟

-

ایک ٹیم میں کتنے انٹرنز ہونے چاہئیں؟

-

کیا ماتحت کام کے انچارج سپروائزر کو انٹرن کا انتظام کرنا چاہئے؟

-

کیا آپ کو ساتھیوں کا ایک گروپ مل کر کام کرنا چاہئے؟ مکس

یہ وہی سوال ہے جسے ہم اپنے بنیادی ماخذ کے طور پر استعمال کرتے ہوئے گوگل پیپر کو 150 سے زیادہ کنٹرول شدہ تجربات کے ذریعے جواب دینے کی کوشش کرتے ہیں۔

ذہن میں رکھیں کہ زیادہ ایجنٹ ہمیشہ بہتر نتائج کا باعث نہیں بنتے۔ کبھی کبھی، ایک ایجنٹ صرف صحیح فٹ ہوتا ہے۔ اور دوسری بار، آپ کو مزید کی ضرورت ہوگی۔

کچھ پس منظر

اس سے پہلے کہ ہم شروع کریں، یہاں کچھ اہم نکات ہیں: یہ ایک تجرباتی دریافت ہے، طبیعیات کا قانون نہیں۔

Google Docs نے AI ایجنٹوں اور فراہم کنندگان کی زیادہ سے زیادہ ٹیموں کا جائزہ لینے کے لیے ایک مکمل طریقہ کار استعمال کیا۔

کچھ فراہم کنندگان میں شامل ہیں:

-

AI (ChatGPT) کھولیں

-

گوگل (جیمنی)

-

بشریات (کلاڈ)

ماڈل گروپ کے لحاظ سے ہر نتیجہ مختلف تھا۔

-

OpenAI ماڈلز نے مرکزی/ہائبرڈ ترتیبات سے سب سے زیادہ فائدہ اٹھایا۔

-

ہمارے ماڈل نے واضح کارکردگی کا سطح مرتفع دکھایا۔

-

انسانی ماڈل کوآرڈینیشن اوور ہیڈ کے لیے زیادہ حساس تھا۔

چونکہ یہ متعدد تجربات پر مبنی ایک زبردست مطالعہ ہے، ٹیمیں اسے ایک مضبوط رہنما کے طور پر دیکھ سکتی ہیں جسے وہ ماڈل فیملیز کا انتخاب کرتے وقت استعمال کر سکتی ہیں۔

بہترین AI ایجنٹس بنانے کے لیے فیصلہ الگورتھم

اب ہم مضمون کے نتائج کو ایک سادہ، قابل اطلاق الگورتھم میں ترجمہ کریں گے جسے کوئی بھی شخص کاموں کو خودکار کرنے کے لیے AI ایجنٹس بنانے کے لیے استعمال کر سکتا ہے۔

اس الگورتھم کا بنیادی مقصد آپ کو یہ فیصلہ کرنے میں مدد کرنا ہے کہ آپ کو صرف ایک ایجنٹ کی ضرورت ہے یا کئی اور، گوگل پیپر کو بطور سائنسی حوالہ استعمال کرتے ہوئے۔

اس طرح، مضمون کو مرحلہ وار سمجھانے کے بجائے، میں آپ کو سکھاؤں گا کہ اس مسئلے کو عملی طور پر کیسے حل کیا جائے۔

1. اپنا بجٹ چیک کریں۔

اگر آپ کا ہارڈویئر محدود ہے تو ہم اولاما سے شروع کرنے کی تجویز کرتے ہیں۔

اولاما ایک ایسا ٹول ہے جو آپ کو اپنے ذاتی کمپیوٹر پر LLM چلانے کی اجازت دیتا ہے۔ اور اگر آپ اسے مقامی طور پر چلاتے ہیں تو یہ مفت اور اوپن سورس ہے۔

جب آپ ان ماڈلز تک رسائی کے لیے OpenAI، Google، یا Anthropic سے APIs استعمال کرتے ہیں، تو آپ ادائیگی کرنا شروع کر دیتے ہیں۔

6 مئی 2026 تک، OpenAI کے GPT-5.5 کی قیمت 5.00 وون فی ملین ٹوکن ہے، جب کہ GPT-5.4 منی کی قیمت 0.75 وون فی ملین ٹوکن ہے۔

اگر آپ کے کلاؤڈ وسائل محدود ہیں، تو آپ GPUs تک رسائی حاصل کرنے اور بڑے، نئے بلین پیرامیٹر LLMs کو چلانے کے لیے Google Colab کا استعمال کر سکتے ہیں۔ جدید ایل ایل ایم اکثر تصویر بنانے، کوڈنگ وغیرہ میں بہتر نتائج دیتے ہیں۔

آپ Google Colab پر Ollama کے ساتھ LLM بھی استعمال کر سکتے ہیں۔

اگر آپ کے پاس کارپوریٹ پروجیکٹس ہیں، تو ہم کلاؤڈ بیسڈ آپشن کی سفارش کرتے ہیں۔ یہ آپ کو زیادہ تر مقامی آفس ہارڈویئر فراہم کرنے والے ماحول سے زیادہ میموری والے ماحول میں ڈیمو بنانے اور تشخیص چلانے کی اجازت دیتا ہے۔

اگر آپ کا بجٹ لچکدار ہے، تو آپ کلاڈ یا جیمنی جیسے خصوصی API استعمال کر سکتے ہیں۔

ہمیشہ یاد رکھیں کہ ایجنٹوں کو ٹوکن کی ضرورت ہوتی ہے، اور ٹوکن کی قیمت ہوتی ہے۔

2. صرف ایک ایجنٹ کے ساتھ شروع کریں۔

ہمیشہ ایک ہی ایجنٹ سے شروع کریں۔ عام طور پر، فرنٹیئر ماڈل پرانے اوپن سورس ماڈلز سے بہتر کارکردگی کا مظاہرہ کرتے ہیں۔

3. کارکردگی کی پیمائش

دستاویزات کے مطابق، اگر کسی ایک ایجنٹ کی حقیقی کامیابی کی شرح (یہ کتنی اچھی طرح سے کام کرتی ہے اور کتنی درست طریقے سے کارکردگی کا مظاہرہ کرتی ہے) 45 فیصد سے زیادہ ہے، تو عام طور پر اس کام کے لیے ایجنٹوں کی ٹیم بنانے کی ضرورت نہیں ہے۔

اس کی پیمائش کرنے کے لیے، اپنے ایجنٹ کو 50 سے 100 نمائندہ کاموں پر چلائیں۔ پھر ہم ہر ایک کو معیار کے معیار (انسانی جائزہ، معلوم اچھے جوابات، یا چیک لسٹ) کی بنیاد پر اسکور کرتے ہیں جس کی وضاحت ہم نے شروع کرنے سے پہلے کی تھی۔

نوٹ کریں کہ پیپر میں 45% نتائج یک طرفہ ہیں۔ ~ نہیں ایجنٹ شامل کریں (45% یا اس سے زیادہ)۔ تاہم، قاعدہ دوسرے طریقے سے نہیں جاتا ہے اور یہ بتاتا ہے کہ اگر کارکردگی 45٪ سے کم ہے، تو ایک یا دو ایجنٹ مدد کریں گے۔

مصنفین کا کہنا ہے کہ "ہم آہنگی کے فوائد ایجنٹوں کی تعداد کو بڑھانے کے بجائے مواصلاتی ٹوپولوجی کو کام کے ڈھانچے سے ملانے سے پیدا ہوتے ہیں۔”

بنیادی طور پر، اگر آپ کا ایجنٹ خراب کارکردگی کا مظاہرہ کر رہا ہے، تو پہلے اسے ٹھیک کریں! خود بخود یہ مت سوچیں کہ آپ کو کسی اور ایجنٹ کی ضرورت ہے۔

اگر آپ یہ طے کرتے ہیں کہ ایک ہی ایجنٹ آپ کے پروجیکٹ کے لیے کام کرے گا، تو مرحلہ 7 پر جائیں۔

اگر کسی ایک ایجنٹ کی کارکردگی 45% سے کم ہے تو پہلے اسے بہتر بنانے کی کوشش کریں (بہتر اشارے، ٹولز یا ماڈل)۔ صرف اس صورت میں ایجنٹوں کی ٹیم بنانے پر غور کریں جب کام قدرتی طور پر متوازی طور پر چل رہے ہوں (اگلے اقدامات دیکھیں)۔

4. ٹاسک متوازی تشخیص

پھر بڑا سوال یہ ہے کہ ایک سے زیادہ ایجنٹوں کا استعمال کیوں؟ فیصلہ کرنے کا طریقہ یہاں ہے:

جب کسی کام میں صرف ایک مسلسل کام شامل ہوتا ہے، تو ایک ایجنٹ عام طور پر اس کام کو زیادہ موثر اور کم خرچ میں انجام دیتا ہے۔

تاہم، اگر پروجیکٹ کو واضح طور پر انفرادی ذیلی کاموں میں تقسیم کیا جا سکتا ہے، تو متعدد ایجنٹ مدد کر سکتے ہیں۔ اس کے بعد ایک مختلف ماہر (ایجنٹ) ہر ذیلی کام کو سنبھال سکتا ہے، اور متعدد ایجنٹ بیک وقت متعدد کام انجام دے سکتے ہیں۔

الگورتھم کے اس مرحلے پر، ہم اس بات کو یقینی بنانا چاہتے ہیں کہ جن کاموں پر ہم AI ایجنٹ کو لاگو کرنا چاہتے ہیں وہ قدرتی طور پر متوازی ہوں۔

اگر کسی کام کو آزاد ذیلی کاموں میں تقسیم کیا جا سکتا ہے، تو یہ قدرتی طور پر متوازی ہو جاتا ہے۔ مثال کے طور پر:

مثالیں جہاں کام قدرتی طور پر متوازی نہیں ہیں:

-

شروع سے آخر تک اپنے سفر کی منصوبہ بندی کریں۔ مثال کے طور پر، ہوٹل بک کرنے سے پہلے، آپ کو ایک منزل کا انتخاب کرنا ہوگا۔ یہ ان کاموں کو بیک وقت مکمل ہونے سے روکے گا۔

-

بینک ٹرانسفرز کا انتظام کریں (فنڈز بھیجنے سے پہلے تصدیق کرنے کی ضرورت ہے)

اگر آپ کے کام قدرتی طور پر متوازی ہیں اور آپ کو مزید ایجنٹوں کے استعمال سے فائدہ ہوگا، تو آپ کو مرحلہ 5 کے ساتھ جاری رکھنا چاہیے۔

اگر نہیں (کام ترتیب وار ہے یا مرحلہ وار ہے) تو رک جائیں۔ مضمون کی تحقیق سے پتہ چلتا ہے کہ ملٹی ایجنٹ ٹیمیں صرف ان صورتوں میں نتائج پر منفی اثر ڈالیں گی، لہذا آپ کو ایک ایجنٹ پر قائم رہنا چاہیے۔

اس صورت میں (جو فطرت میں متوازی نہیں ہے)، آپ کسی ایک ایجنٹ کے لیے پرامپٹ، ٹول، یا ماڈل کو بہتر بنانے کے لیے کام کر سکتے ہیں۔ پھر جب آپ 45% سے تجاوز کر جائیں تو مرحلہ 7 پر جائیں۔

5. کام کی قسم کے لحاظ سے ٹوپولوجی منتخب کریں۔

اب آئیے اپنی ایجنٹ ٹیم کی ساخت کا فیصلہ کرتے ہیں۔

ٹوپولوجی کا سیدھا مطلب ہے نظام کی ساخت۔ اس معاملے میں، ہم AI ایجنٹ ٹیم کی ساخت کے بارے میں بات کر رہے ہیں۔

یہ مرحلہ صرف اس صورت میں لاگو ہوتا ہے جب آپ فیصلہ کرتے ہیں کہ متعدد ایجنٹوں کی ضرورت ہے۔ ہم یہاں جن دو ٹوپولاجیوں پر غور کریں گے وہ ملٹی ایجنٹ ہیں۔

اگر آپ کا کام تجزیات یا ساختی کاموں پر مبنی ہے، تو آپ مرکزی ماڈل استعمال کرنے پر غور کر سکتے ہیں۔ مرکزی ماڈل ایک مینیجر کی طرح ہے جو اپنے نیچے انٹرنز کے ایک گروپ کا انتظام کرتا ہے۔ انٹرنز مینیجرز کو رپورٹ کرتے ہیں، جو ان کو مربوط کرتے ہیں۔

ایک مرکزی ماڈل پائپ لائنز جیسے مالیاتی رپورٹس کے لیے مثالی ہے۔

مطالعات سے پتہ چلتا ہے کہ یہ غلطی کو بڑھا کر ~ 17x سے 4x تک کم کر دیتا ہے۔ اس کا مطلب ہے کہ اگر مینیجر غلطی کرتا ہے تو انٹرن 17 کے بجائے تقریباً 4 غلطیاں کرے گا۔

اگر آپ کے کام مزید ریسرچ سے متعلق ہیں تو تقسیم شدہ ماڈل استعمال کریں۔

کھلی تحقیق یا آڈٹ کے لیے مثالی جہاں ایجنٹ مختلف زاویوں سے ایک ہی مواد کا جائزہ لیتے ہیں۔

ایک وکندریقرت ماڈل ایسا ہوتا ہے جیسے کسی ٹیم پر انٹرن رکھنے کے لیے کمپنی کی نئی مصنوعات کے بارے میں خیالات پیدا کریں یا دوپہر کے کھانے کے دوران عمل کو تیز تر بنانے کے طریقوں پر تبادلہ خیال کریں۔

6. فی ایجنٹ ٹیم کے سائز اور دستیاب ٹولز کو محدود کریں۔

اخبار کے مطابق، تقریباً تین یا چار ایجنٹوں کے بعد AI ایجنٹوں کی کامیابی میں کمی آنا شروع ہو جاتی ہے۔

اس میں یہ بھی کہا گیا ہے کہ ہر ایجنٹ کو مطلوبہ کم از کم ٹولز تک رسائی ہونی چاہیے (1 سے 3 ٹولز فی ایجنٹ)۔ ہر ایجنٹ کے جتنے زیادہ ٹولز ہوں گے، اس کی کارکردگی اتنی ہی خراب ہوگی۔

7. ایک تشخیص بنانا

اب یہاں کچھ ہے جو زیادہ تر معاملات میں کام کرتا ہے: لیکن آپ یہ کیسے یقینی بنا سکتے ہیں کہ آپ کے ایجنٹ آپ کی تنظیم میں پیمانے پر ہیں؟ اس وجہ سے، اب آپ کو اپنے ایجنٹ کو اسکیل کرنے سے پہلے اندرونی جانچ کو ترتیب دینے کی ضرورت ہے۔

ان اندرونی ٹیسٹوں کو تشخیص کہا جاتا ہے۔

ہر تشخیص کے لیے، آپ کو واضح میٹرکس کی ضرورت ہوتی ہے جو آپ کو بتاتی ہیں کہ آپ کے ایجنٹ ہر تشخیص میں کیسی کارکردگی کا مظاہرہ کر رہے ہیں۔

آپ درستگی، کارکردگی، رفتار، وغیرہ کی پیمائش کرنا چاہیں گے۔ درستگی آپ کو بتاتی ہے کہ آیا آپ کا ماڈل درست ہے۔ کارکردگی رپورٹ کرتی ہے کہ درخواستوں پر کارروائی کتنی جلدی اور سستی تھی۔ اور رفتار سے پتہ چلتا ہے کہ آیا ماڈل نے کام کو پورا کرنے کے لیے صحیح ٹولز کا استعمال کیا۔

یاد رکھیں، عام طور پر AI اور انجینئرنگ میں، آپ کسی سسٹم پر بھروسہ نہیں کر سکتے اگر آپ اس کی کارکردگی کی پیمائش نہیں کر سکتے۔

یہ آپ کو یہ دیکھنے کی اجازت دیتا ہے کہ آپ کا ماڈل اس ڈیٹا اور سیاق و سباق کا استعمال کرتے ہوئے کتنی اچھی کارکردگی کا مظاہرہ کرتا ہے جس کے ساتھ آپ کی تنظیم کام کرتی ہے۔ ان جائزوں کو استعمال کرنے سے ایجنٹوں کو وقت کے ساتھ ساتھ زیادہ خود مختار اور بہتر بننے میں مدد مل سکتی ہے۔

تشخیص ہو سکتا ہے:

-

ان پٹ ای میل اور آؤٹ پٹ جواب متوقع ہے۔

-

کسٹمر سپورٹ ریکارڈ اور آؤٹ پٹ کا خلاصہ ایکشن آئٹمز درج کریں۔

-

پیچیدہ قانونی معاہدے درج کریں، زیادہ خطرے والی شقوں کی نشاندہی کریں، اور انہیں پرنٹ کریں۔

پھر ہم چیک کرتے ہیں کہ ایجنٹ کا آؤٹ پٹ متوقع آؤٹ پٹ سے کتنا قریب ہے۔

آپ مختلف ماڈلز کو بھی آزما سکتے ہیں اور اس فیصلے کے الگورتھم کو دوبارہ دیکھ سکتے ہیں کہ آپ کے استعمال کے معاملے میں کون سا ماڈل سب سے بہتر ہے۔ آخر میں، نئے ماڈل اکثر اپنے پیشرو سے بہتر ہوتے ہیں۔

یہ ورک فلو آپ کو زیادہ درست اور موثر ایجنٹ بنانے کی اجازت دیتا ہے۔

اب آئیے اس الگورتھم کو عملی طور پر استعمال کے تین کیسز کا استعمال کرتے ہوئے دیکھتے ہیں۔

کوڈ کی تین مثالیں۔

اس سیکشن میں، ہم بتائیں گے کہ Jupyter Notebook میں کوڈ کیسے چلایا جائے۔ ہم تجویز کرتے ہیں کہ آپ کوڈ کاپی کریں اور اسے خود چلائیں تاکہ آپ پیروی کر سکیں اور سمجھ سکیں کہ کوڈ کیسے کام کرتا ہے۔

ہر چیز کو سمجھنے میں آپ کی مدد کرنے کے لیے، آئیے Google Colab کے بیان کردہ سیکشن سے کوڈ شروع کرتے ہیں۔

آپ اسے یہاں GitHub پر بھی تلاش کر سکتے ہیں۔ میں نے اس کوڈ کے لیے MIT لائسنس استعمال کیا۔

1. یوٹیلیٹیز، Python لائبریریاں انسٹال اور کنفیگر کریں۔

!sudo apt update && sudo apt install -y pciutils

!sudo apt-get install -y zstd

!curl -fsSL https://ollama.com/install.sh | sh

یہ کوڈ بنیادی طور پر AI ایجنٹ کو چلانے کے لیے ایک نوٹ بک تیار کرتا ہے۔

پہلی لائن پیکیج کی فہرست کو اپ ڈیٹ کرکے اور ہارڈویئر کا پتہ لگانے والے ٹولز انسٹال کرکے آپ کے GPU کی شناخت کرتی ہے۔ دوسری لائن ماڈل فائلوں کو ان زپ کرنے کے لیے درکار تیز ڈیکمپریشن یوٹیلیٹی انسٹال کرتی ہے۔ آخر میں، سافٹ ویئر انسٹال کرنے کے لیے آفیشل اولاما سیٹ اپ اسکرپٹ ڈاؤن لوڈ اور چلائیں۔

اولاما ایک اوپن سورس ٹول ہے جو آپ کو اپنے کمپیوٹر پر اپنا LLM لینے کی اجازت دیتا ہے۔

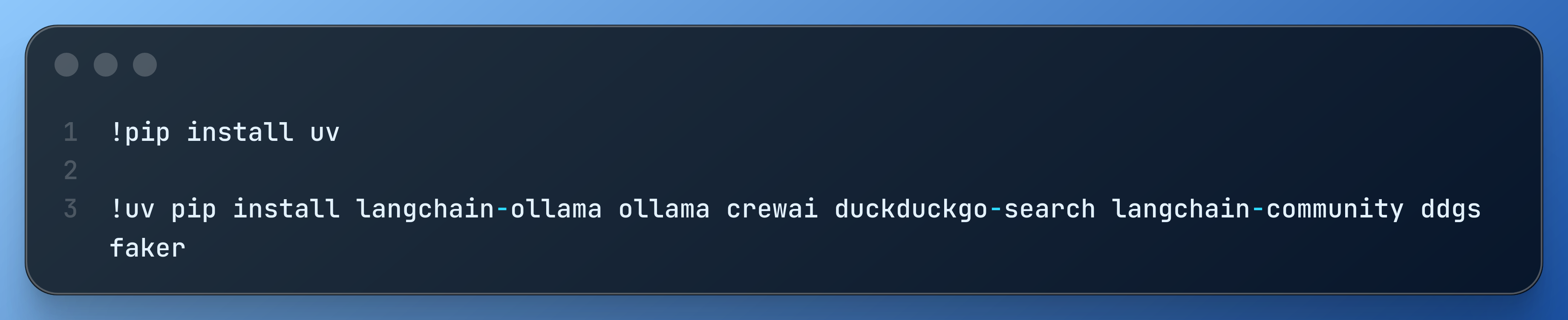

!pip install uv

!uv pip install langchain-ollama ollama crewai duckduckgo-search langchain-community ddgs faker

یہاں ہم uv ازگر پیکج۔ پائپ کی طرح، لیکن بہت تیز اور زیادہ محفوظ۔

اس سے پائتھون کی باقی لائبریریوں کو ڈاؤن لوڈ کرنا بہت تیز ہوجاتا ہے۔

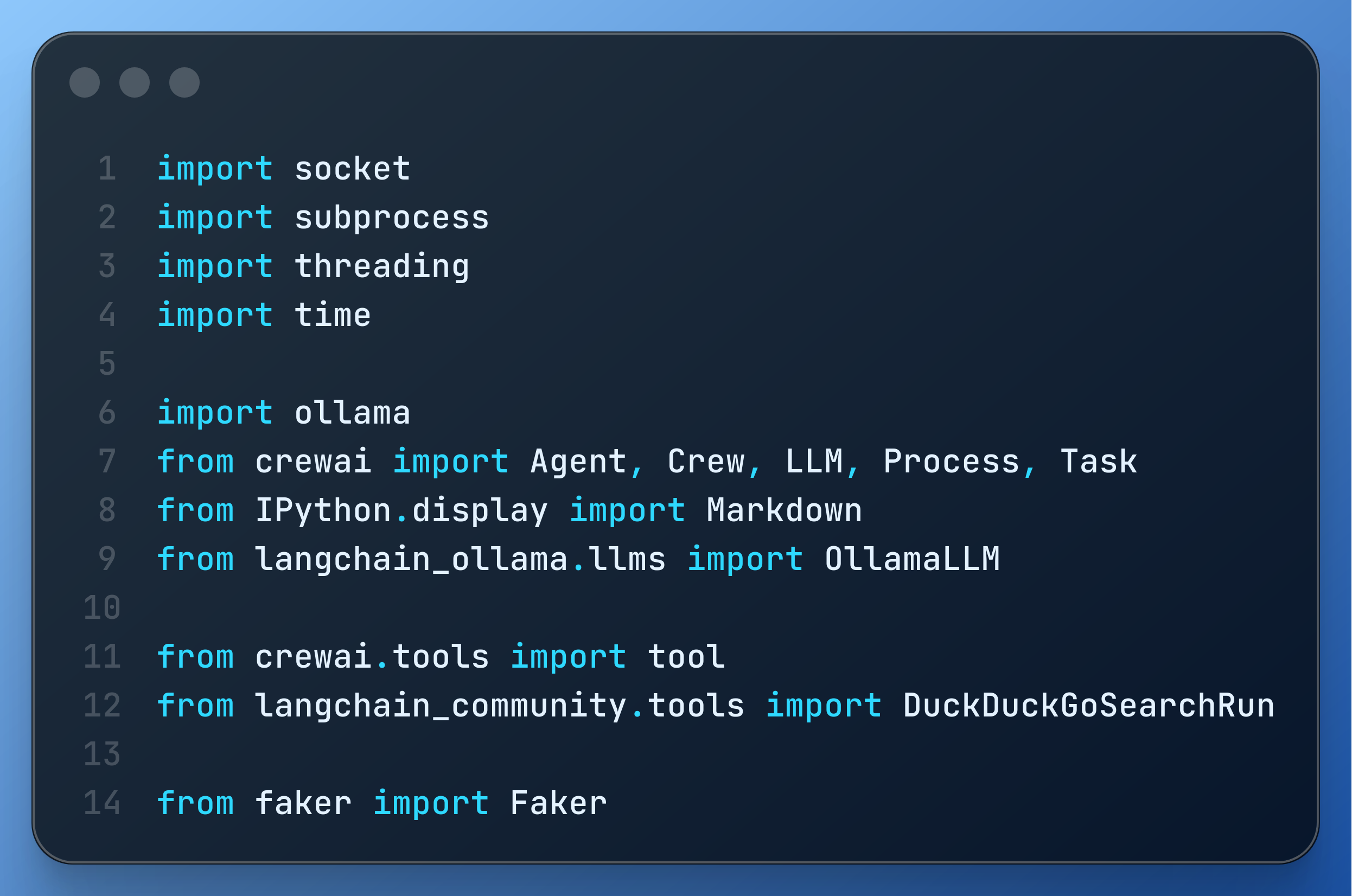

import socket

import subprocess

import threading

import time

import ollama

from crewai import Agent, Crew, LLM, Process, Task

from IPython.display import Markdown

from langchain_ollama.llms import OllamaLLM

from crewai.tools import tool

from langchain_community.tools import DuckDuckGoSearchRun

from faker import Faker

مندرجہ بالا کوڈ کا استعمال کرتے ہوئے، ہم نے ایک بہترین AI ایجنٹ بنانے کے لیے ضروری تمام Python لائبریریوں کو درآمد کر لیا ہے۔

آئیے ہر ایک خصوصیت پر ایک نظر ڈالیں۔

-

ساکٹ: نیٹ ورک پر کمپیوٹر کو دوسرے کمپیوٹر سے جوڑتا ہے۔

-

ذیلی عمل: Python کو آپ کے کمپیوٹر پر دوسرے پروگرام شروع کرنے اور کنٹرول کرنے کی اجازت دیتا ہے۔

-

تھریڈنگ: ایک ہی وقت میں متعدد کاموں کو انجام دیتا ہے لہذا ایک سست عمل پورے کوڈ کو منجمد نہیں کرتا ہے۔

-

وقت: تاخیر اور ٹائم اسٹیمپ کو ہینڈل کرتا ہے، جیسے کوڈ کا انتظار کرنا یا رفتار کی پیمائش کرنا۔

-

ollama: آپ کی مشین پر مقامی طور پر چلنے والے AI ماڈلز سے بات کرنے کے لیے استعمال کرنے والا ٹول۔

-

crewai: ایک پیشہ ور ٹیم کی طرح مل کر کام کرنے کے لیے متعدد AI ایجنٹس بنائیں۔

-

IPython: Jupyter جیسے ٹولز میں انٹرایکٹو کوڈنگ اور خوبصورت پرنٹنگ کو طاقت دیتا ہے۔

-

langchain_ollama: مقامی اولاما ماڈلز کو مقبول LangChain AI فریم ورک سے جوڑتا ہے۔

-

langchain_community: آپ کے AI کو بیرونی دنیا سے مربوط کرنے کے لیے سینکڑوں اضافی "کنیکٹرز” فراہم کرتا ہے۔

-

faker: اپنے کوڈ کو محفوظ طریقے سے جانچنے کے لیے حقیقت پسندانہ "ڈمی” ڈیٹا (نام، ای میل) بنائیں۔

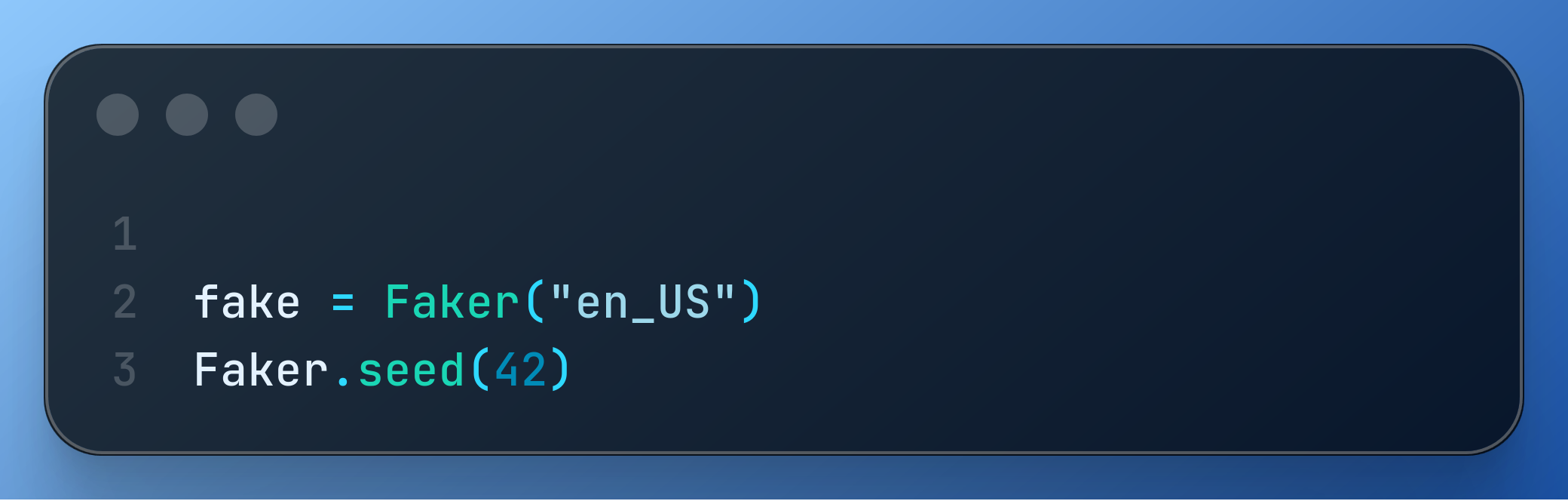

fake = Faker("en_US")

Faker.seed(42)

کوڈ کی ان دو لائنوں میں، ہم نے Faker Python لائبریری کو US سے انگریزی تک جعلی ڈیٹا بنانے کے لیے ترتیب دیا ہے۔

2. اولامہ سرور شروع کریں، ماڈلز اور ٹولز درآمد کریں۔

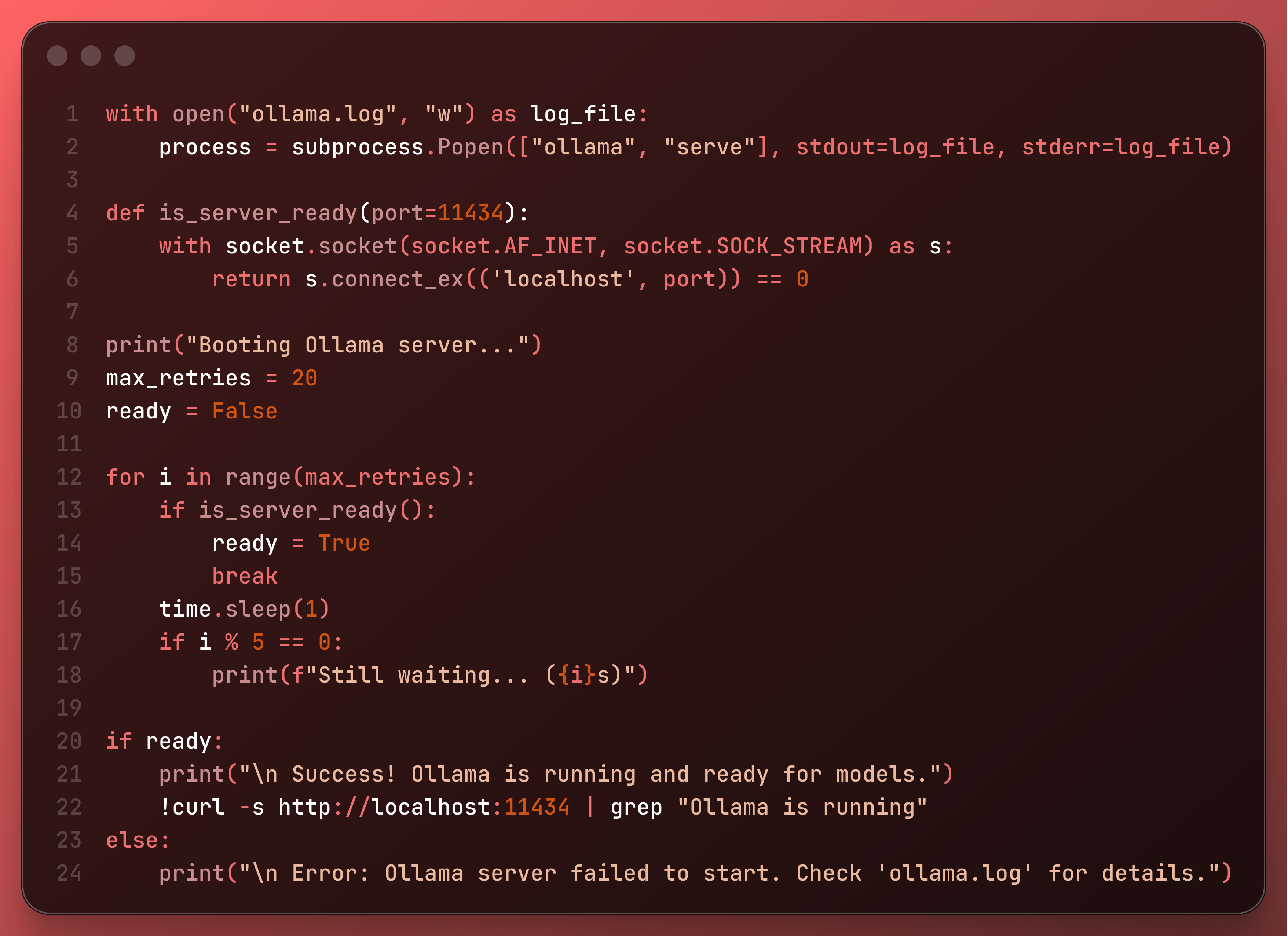

with open("ollama.log", "w") as log_file:

process = subprocess.Popen(["ollama", "serve"], stdout=log_file, stderr=log_file)

def is_server_ready(port=11434):

with socket.socket(socket.AF_INET, socket.SOCK_STREAM) as s:

return s.connect_ex(('localhost', port)) == 0

print("Booting Ollama server...")

max_retries = 20

ready = False

for i in range(max_retries):

if is_server_ready():

ready = True

break

time.sleep(1)

if i % 5 == 0:

print(f"Still waiting... ({i}s)")

if ready:

print("n Success! Ollama is running and ready for models.")

!curl -s http://localhost:11434 | grep "Ollama is running"

else:

print("n Error: Ollama server failed to start. Check 'ollama.log' for details.")

یہ کوڈ اس بات کو یقینی بنانے میں مدد کرتا ہے کہ آپ کے AI ماڈل کو چلانے سے پہلے آپ کا مقامی ماحول مکمل طور پر تیار ہے۔

AI سرورز کو بوٹ ہونے میں اکثر وقت لگتا ہے، لہذا صبر کریں۔

یہ اسکرپٹ اولاما کو شروع کرنے اور نیٹ ورک "ہینڈ شیک” کے ذریعے بیدار ہونے کو یقینی بنانے کے لیے پس منظر کے عمل کا استعمال کرتے ہوئے "کنکشن سے انکار” کی غلطیوں کو روکتا ہے۔

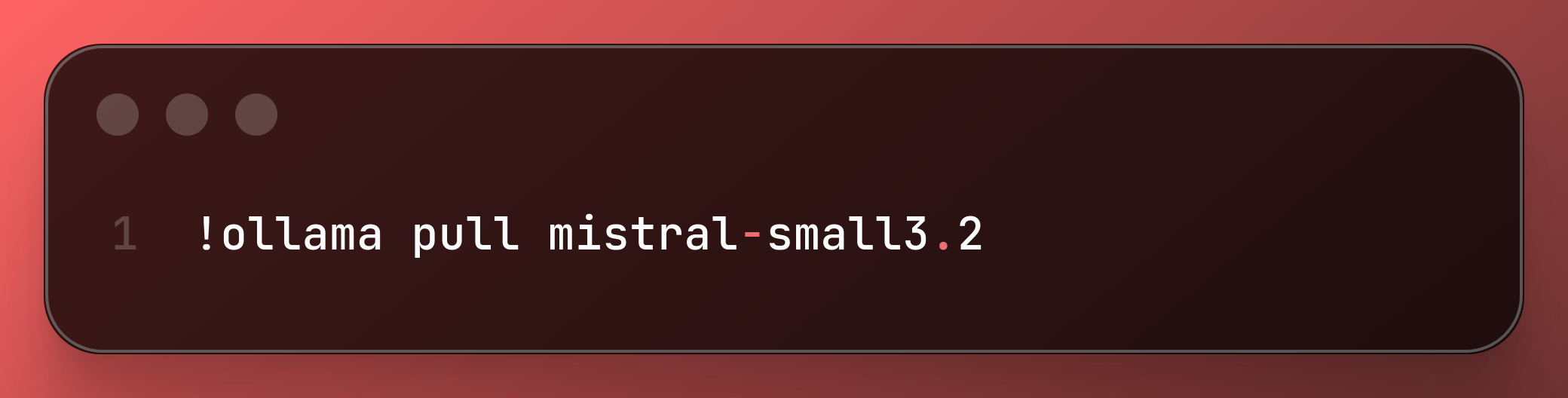

!ollama pull mistral-small3.2

اس لائن میں ہمارے پاس ہے۔ mistral-small3.2 Google Colab Notebooks پر LLM۔

Mistral ایک ماڈل ہے جسے Mistral AI SAS، ایک مشہور فرانسیسی اسٹارٹ اپ نے تیار کیا ہے۔

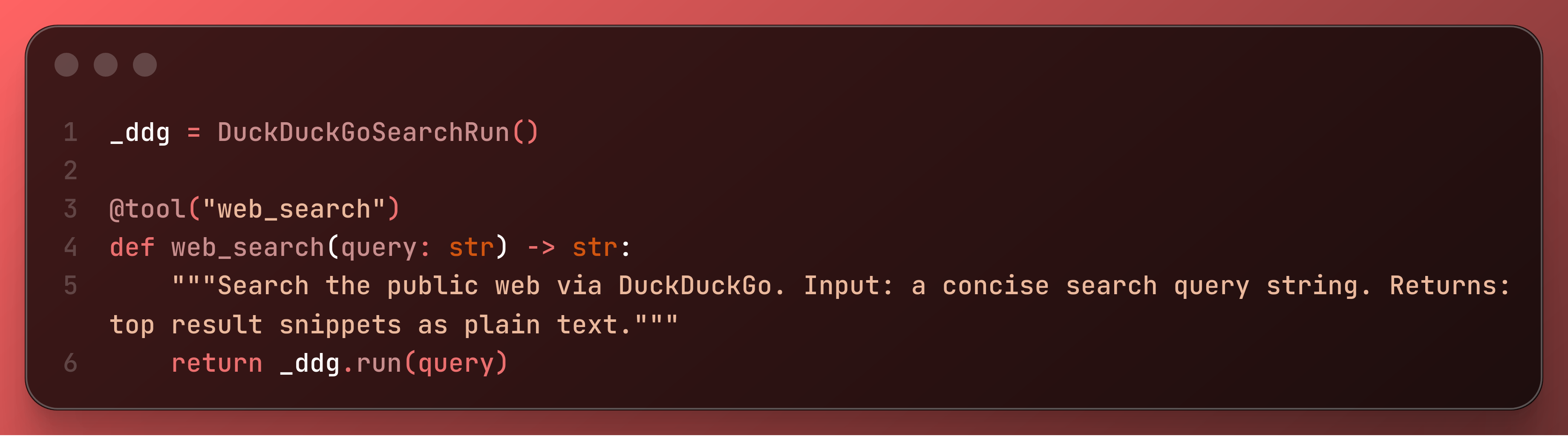

_ddg = DuckDuckGoSearchRun()

@tool("web_search")

def web_search(query: str) -> str:

"""Search the public web via DuckDuckGo. Input: a concise search query string. Returns: top result snippets as plain text."""

return _ddg.run(query)

اس کوڈ میں، ہم نے ایجنٹ کے استعمال کے لیے ایک ٹول بنایا ہے۔ اپنے ایجنٹوں کو DuckDuckGo کا استعمال کرتے ہوئے ویب پر تلاش کرنے کی صلاحیت دیں۔ DuckDuckGo ویب پر سب سے زیادہ مقبول پرائیویسی فوکسڈ سرچ انجنوں میں سے ایک ہے۔

یہ بہت اہم ہے کیونکہ یہ ایجنٹوں کو تازہ ترین معلومات فراہم کر سکتا ہے جسے جاننے کے لیے وہ ابھی تک پروگرام نہیں کیے گئے ہیں۔

3. ماڈل ٹیسٹنگ

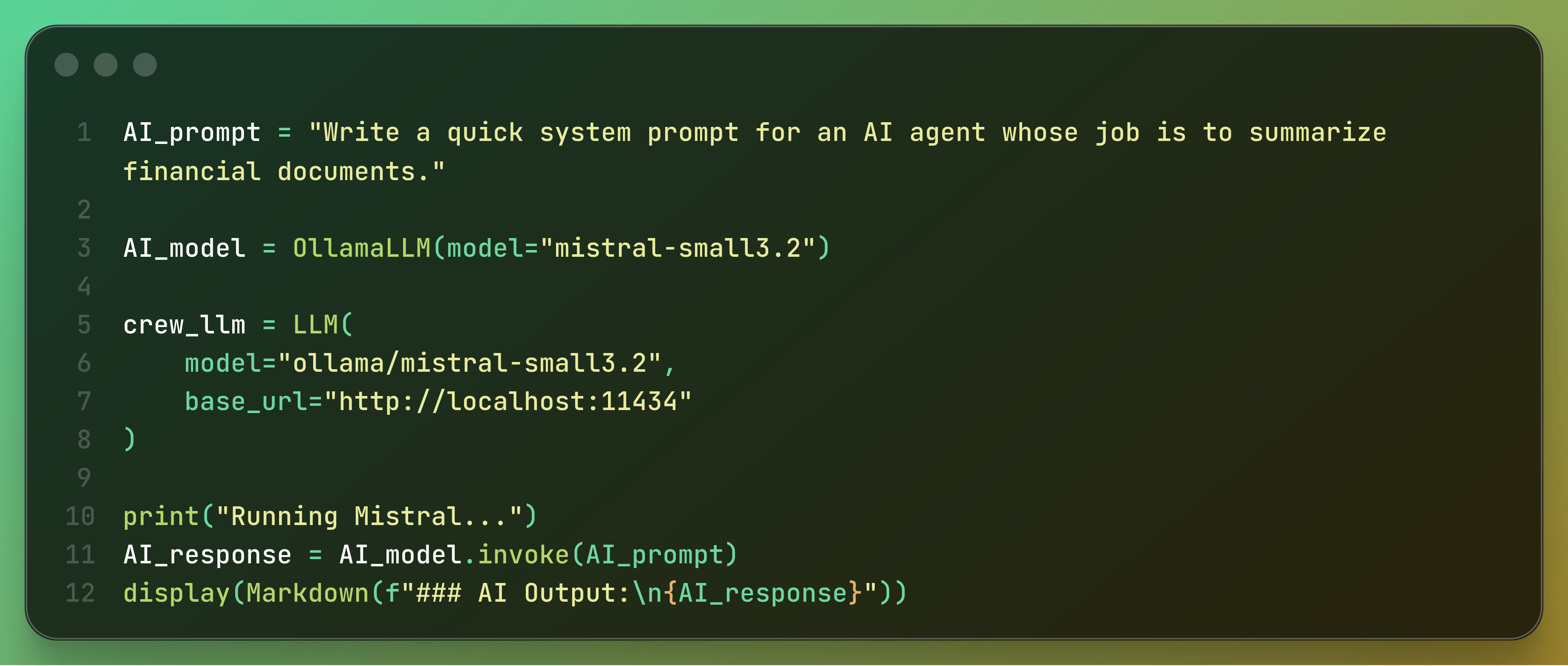

اب آئیے ایل ایل ایم اور لے آؤٹ کی وضاحت کرنے کے لیے کوڈ لکھتے ہیں جس کی ہم جانچ کریں گے۔

ہم براہ راست کاموں کے لیے معیاری ماڈلز اور CrewAI فریم ورک کے لیے خصوصی LLM اشیاء دونوں کو شروع کر رہے ہیں۔ یہ CrewAI فریم ورک کے لیے ایک خاص LLM آبجیکٹ ہے جو AI ایجنٹوں کو چلانے کے لیے استعمال کیا جائے گا۔

یہ ابتدائی ترتیب اہم ہے کیونکہ یہ اس بات کو یقینی بناتی ہے کہ AI ایجنٹ بنانے سے پہلے سسٹم سافٹ ویئر کے ساتھ صحیح طریقے سے بات چیت کرتا ہے۔

AI_prompt = "Write a quick system prompt for an AI agent whose job is to summarize financial documents."

AI_model = OllamaLLM(model="mistral-small3.2")

crew_llm = LLM(

model="ollama/mistral-small3.2",

base_url="http://localhost:11434"

)

print("Running Mistral...")

AI_response = AI_model.invoke(AI_prompt)

display(Markdown(f"### AI Output:n{AI_response}"))

4. AI ایجنٹ چلائیں۔

اب آئیے تین مختلف ایجنٹ کنفیگریشنز چلاتے ہیں۔

پہلا سلسلہ وار کاموں کے لیے واحد ایجنٹ ہے۔ دوسری ایک مرکزی ٹیم ہے، اور تیسری ایک وکندریقرت ٹیم ہے۔

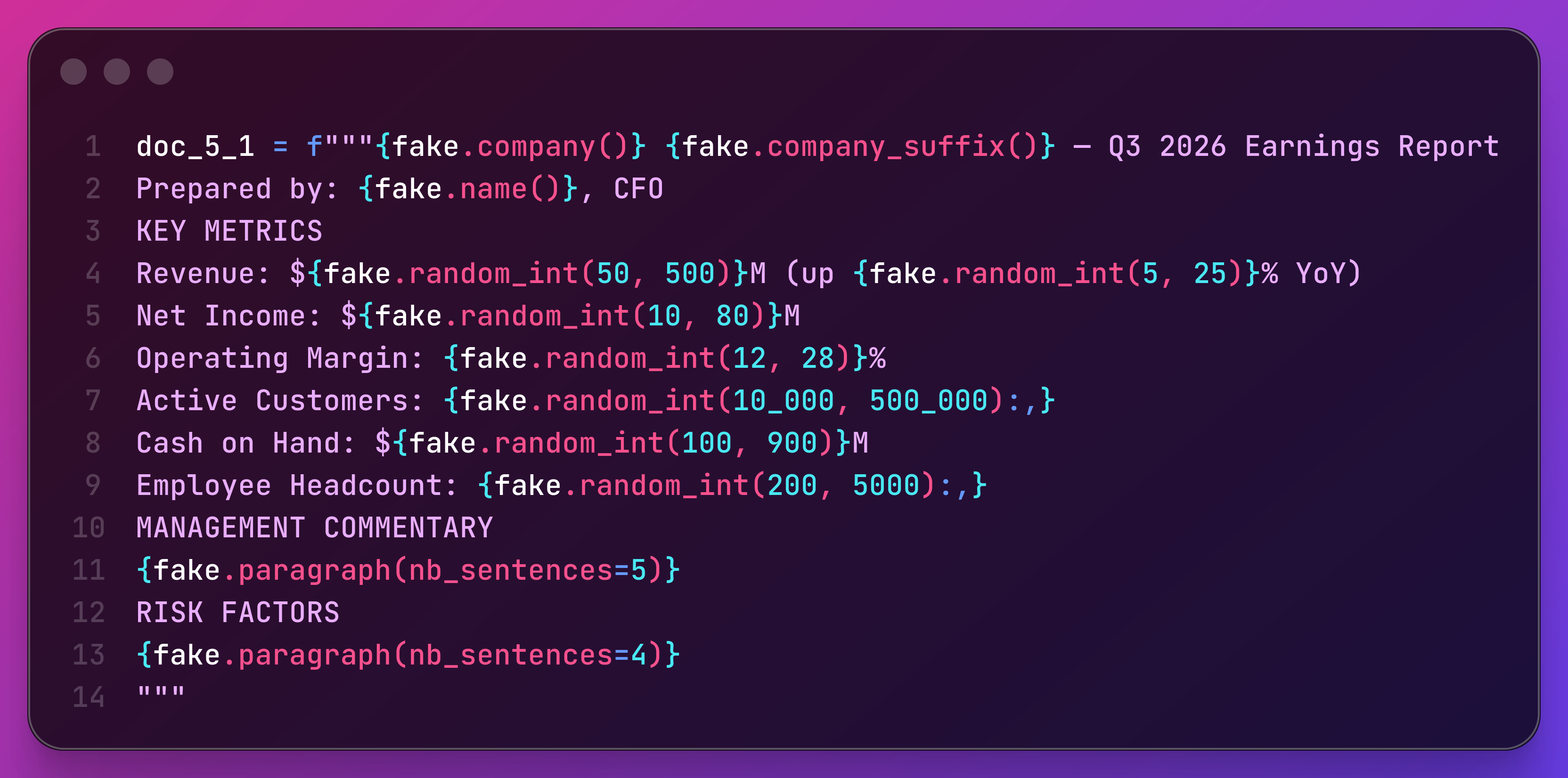

ایک ہی ایجنٹ کا استعمال کرتے ہوئے ترتیب وار آپریشن

doc_5_1 = f"""{fake.company()} {fake.company_suffix()} — Q3 2026 Earnings Report

Prepared by: {fake.name()}, CFO

KEY METRICS

Revenue: ${fake.random_int(50, 500)}M (up {fake.random_int(5, 25)}% YoY)

Net Income: ${fake.random_int(10, 80)}M

Operating Margin: {fake.random_int(12, 28)}%

Active Customers: {fake.random_int(10_000, 500_000):,}

Cash on Hand: ${fake.random_int(100, 900)}M

Employee Headcount: {fake.random_int(200, 5000):,}

MANAGEMENT COMMENTARY

{fake.paragraph(nb_sentences=5)}

RISK FACTORS

{fake.paragraph(nb_sentences=4)}

"""

اس کوڈ میں، ہم نے ایک عام ٹیمپلیٹ تیار کیا ہے جس سے جعلی ڈیٹا تیار کیا جائے گا۔

print(doc_5_1)

Rodriguez, Figueroa and Sanchez and Sons — Q3 2026 Earnings Report

Prepared by: Megan Mcclain, CFO

KEY METRICS

Revenue: $94M (up 23% YoY)

Net Income: $64M

Operating Margin: 13%

Active Customers: 25,622

Cash on Hand: $195M

Employee Headcount: 1,991

MANAGEMENT COMMENTARY

Own night respond red information last everything. Serve civil institution. Choice whatever from behavior benefit. Page southern role movie win her.

RISK FACTORS

Stop peace technology officer relate. Product significant world. Term herself law street class. Decide environment view possible participant commercial. Clear here writer policy news.

یہ کوڈ کسی ایجنٹ کے ذریعے پروسیسنگ کے لیے دستاویز کو پرنٹ کرنے کے لیے استعمال کیا جاتا تھا۔

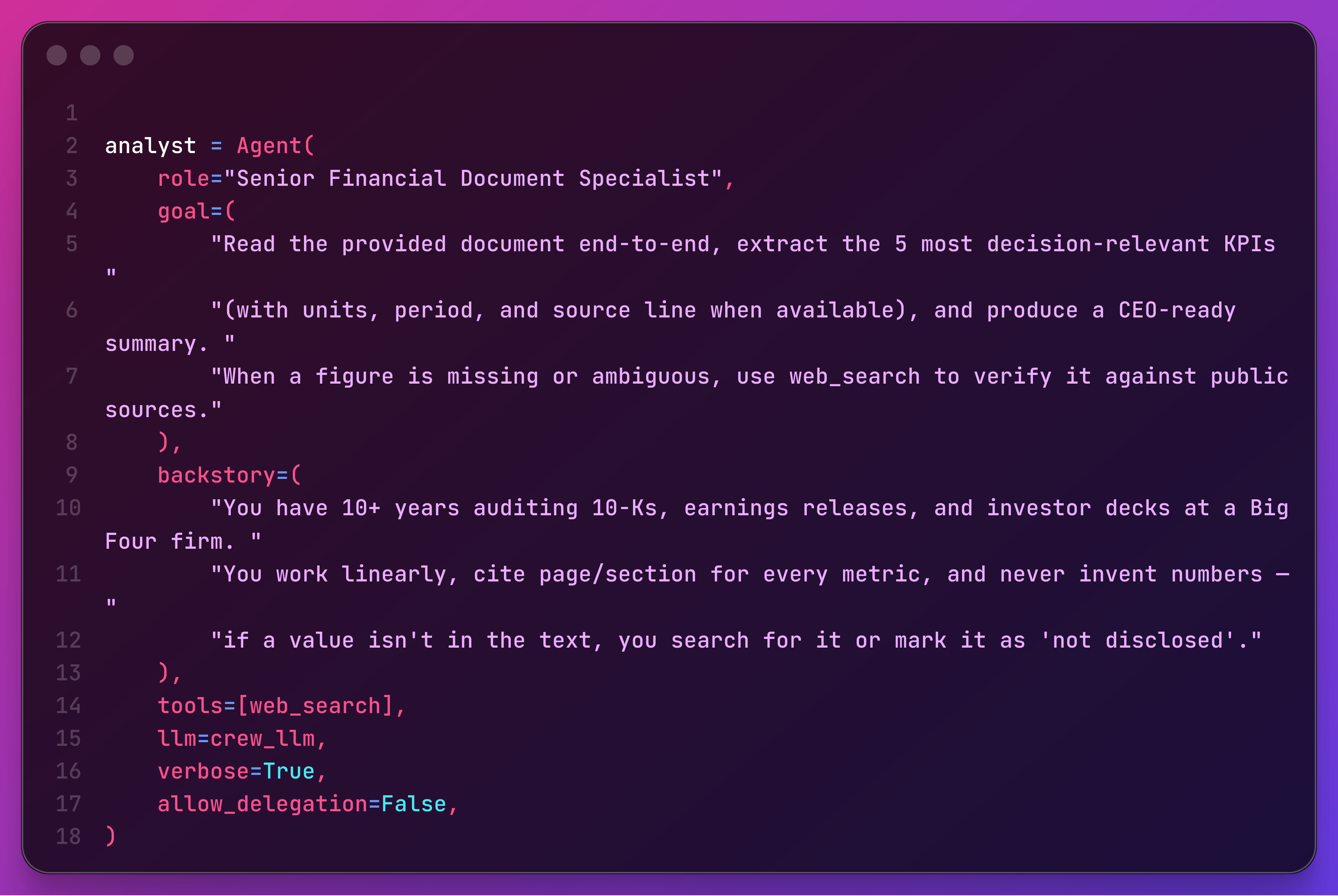

analyst = Agent(

role="Senior Financial Document Specialist",

goal=(

"Read the provided document end-to-end, extract the 5 most decision-relevant KPIs "

"(with units, period, and source line when available), and produce a CEO-ready summary. "

"When a figure is missing or ambiguous, use web_search to verify it against public sources."

),

backstory=(

"You have 10+ years auditing 10-Ks, earnings releases, and investor decks at a Big Four firm. "

"You work linearly, cite page/section for every metric, and never invent numbers — "

"if a value isn't in the text, you search for it or mark it as 'not disclosed'."

),

tools=[web_search],

llm=crew_llm,

verbose=True,

allow_delegation=False,

)

اس کوڈ میں، ہم نے ایک ایجنٹ کی تعریف کی ہے جو ایک تجزیہ کار کے طور پر کام کرتا ہے۔ یہ تجزیہ کار تیار کردہ رپورٹس کا تجزیہ کرتا ہے۔ آپ DuckDuckGo تک بھی رسائی حاصل کر سکتے ہیں۔

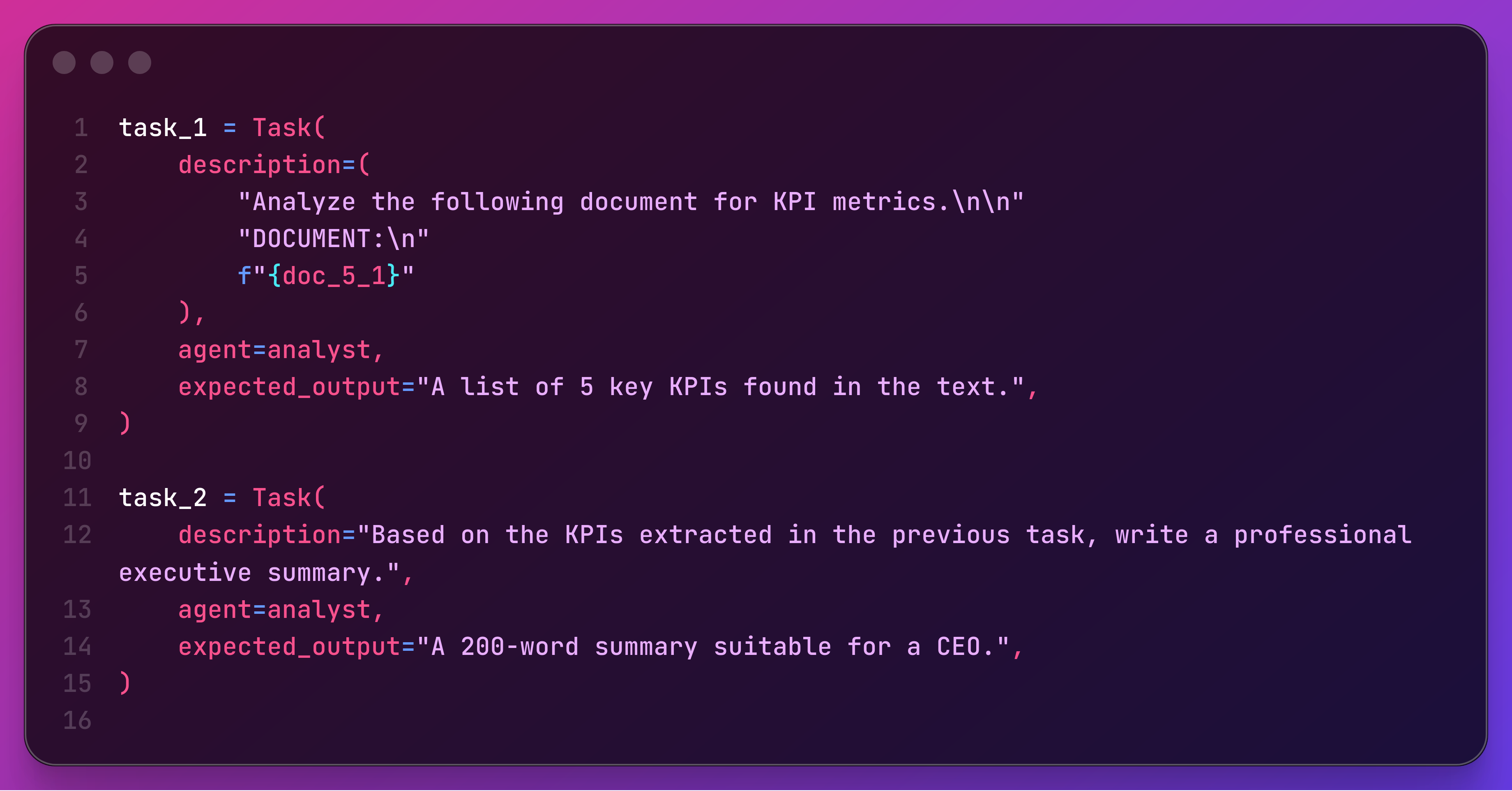

task_1 = Task(

description=(

"Analyze the following document for KPI metrics.nn"

"DOCUMENT:n"

f"{doc_5_1}"

),

agent=analyst,

expected_output="A list of 5 key KPIs found in the text.",

)

task_2 = Task(

description="Based on the KPIs extracted in the previous task, write a professional executive summary.",

agent=analyst,

expected_output="A 200-word summary suitable for a CEO.",

)

تجزیہ کار صرف دو کام کرتے ہیں: ایک KPI میٹرکس تلاش کرنا، اور دوسرا تحریری رپورٹ بنانا۔ تو اس طرح ہمارے پاس ترتیب وار کام ہیں جو صرف ایک AI ایجنٹ کے ذریعے انجام پاتے ہیں اور ہم گوگل پیپر کی ہیورسٹکس کی پیروی کر رہے ہیں۔

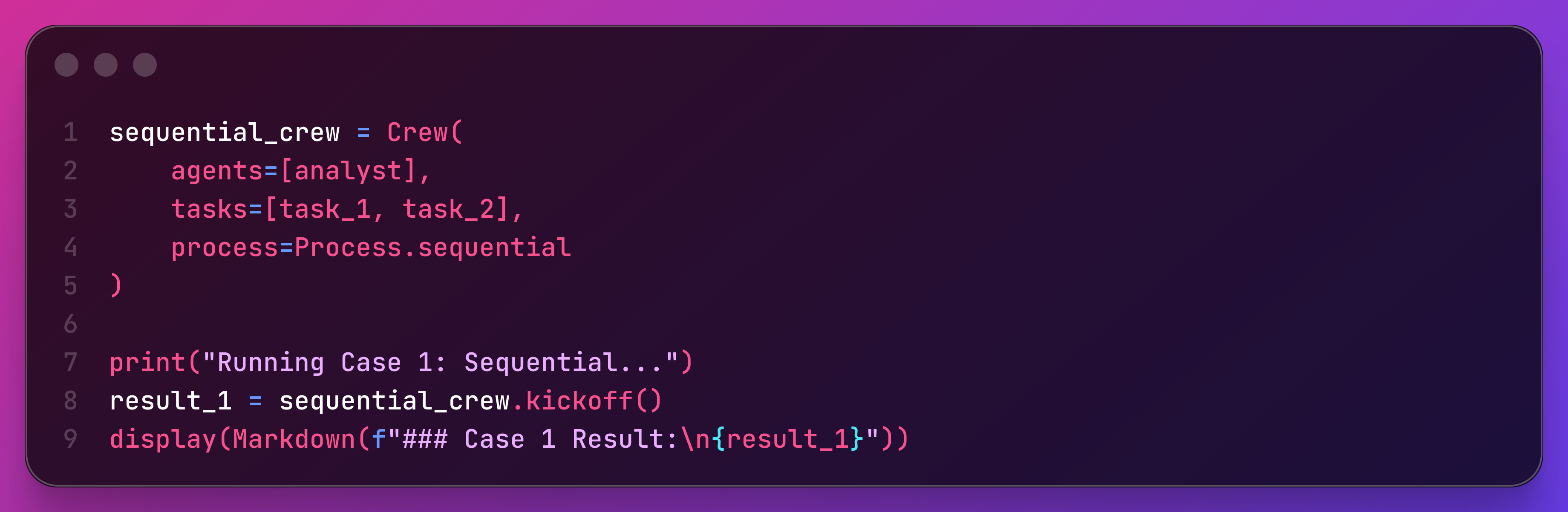

sequential_crew = Crew(

agents=[analyst],

tasks=[task_1, task_2],

process=Process.sequential

)

print("Running Case 1: Sequential...")

result_1 = sequential_crew.kickoff()

display(Markdown(f"### Case 1 Result:n{result_1}"))

Dear CEO,

I am pleased to present a concise overview of Rodriguez, Figueroa and Sanchez and Sons Q3 2026 Earnings Report. Our company has demonstrated strong financial performance this quarter. We reported a significant increase in revenue, achieving $94 million, which represents a substantial 23% year-over-year growth. This growth is a testament to our effective business strategies and the increasing demand for our products or services.

Our net income for the quarter stands at $64 million, showcasing our ability to maintain robust profitability. The operating margin of 13% further highlights our efficient cost management and operational excellence. Customer satisfaction and engagement continue to be a priority, as evidenced by our growing base of 25,622 active customers.

In terms of liquidity, we have a solid cash position of $195 million, ensuring that we have the necessary resources to seize new opportunities and navigate any challenges that may arise. Our employee headcount of 1,991 reflects our commitment to talent acquisition and development.

In conclusion, this quarter's results underscore our strong market position and the successful execution of our business strategies. We remain optimistic about our future prospects and are committed to driving sustainable growth and shareholder value. Let's continue to build on this momentum in the coming quarters.

Best Regards, [Your Name]

آخر کار، ہم نے اپنا بنایا ہوا ایجنٹ چلایا اور اوپر ایجنٹ کی رپورٹ ہے۔

4 ایجنٹوں کی مرکزی ٹیم

اب ہم چار ایجنٹوں کی ایک ٹیم بنائیں گے تاکہ ہم دیکھ سکیں کہ متعدد ایجنٹ کیسے کام کرتے ہیں۔

یہ ٹیم لیتھیم مارکیٹ کے رجحانات پر تحقیق کرتی ہے، مالیاتی ماڈلنگ کرتی ہے، اور ڈیٹا کی بنیاد پر سرمایہ کاری کی تجاویز تیار کرتی ہے۔

ایک مرکزی ٹیم یہاں کام کرتی ہے کیونکہ ہر قدم اگلے مرحلے میں داخل ہوتا ہے۔ ہم تحقیق کے ساتھ شروع کرتے ہیں، پھر تحقیق کا مطالعہ کرتے ہیں، اور آخر میں سفارشات پیش کرتے ہیں۔

آئیے مارکیٹ کا سروے کرنے کے لیے پہلا بنائیں۔

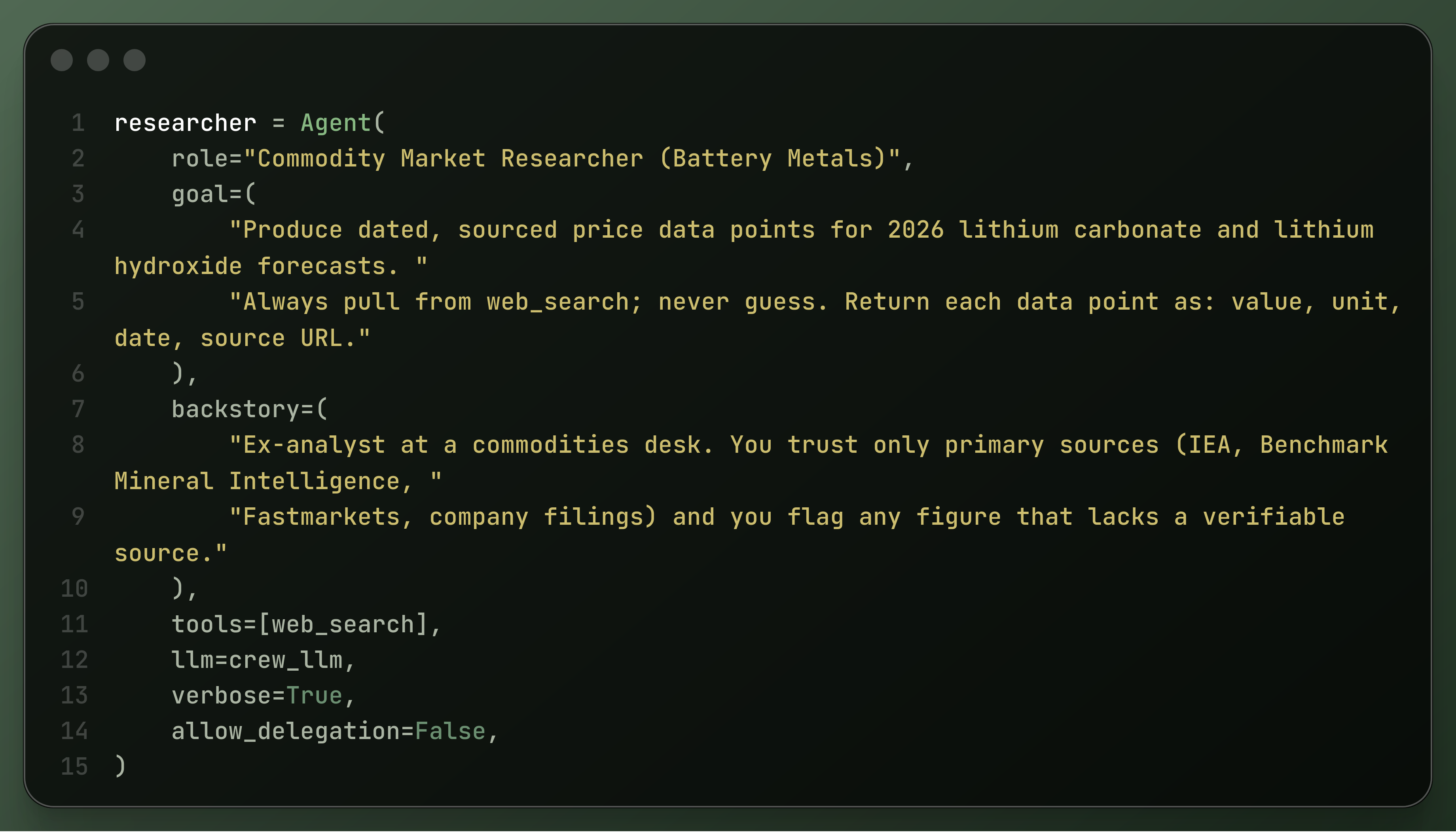

researcher = Agent(

role="Commodity Market Researcher (Battery Metals)",

goal=(

"Produce dated, sourced price data points for 2026 lithium carbonate and lithium hydroxide forecasts. "

"Always pull from web_search; never guess. Return each data point as: value, unit, date, source URL."

),

backstory=(

"Ex-analyst at a commodities desk. You trust only primary sources (IEA, Benchmark Mineral Intelligence, "

"Fastmarkets, company filings) and you flag any figure that lacks a verifiable source."

),

tools=[web_search],

llm=crew_llm,

verbose=True,

allow_delegation=False,

)

پہلا ایجنٹ جو ہم نے بنایا ہے وہ لتیم سے متعلق ڈیٹا کو ویب پر تلاش کرتا ہے۔ آپ اس کام کے لیے DuckDuckGo تک رسائی حاصل کر سکتے ہیں۔

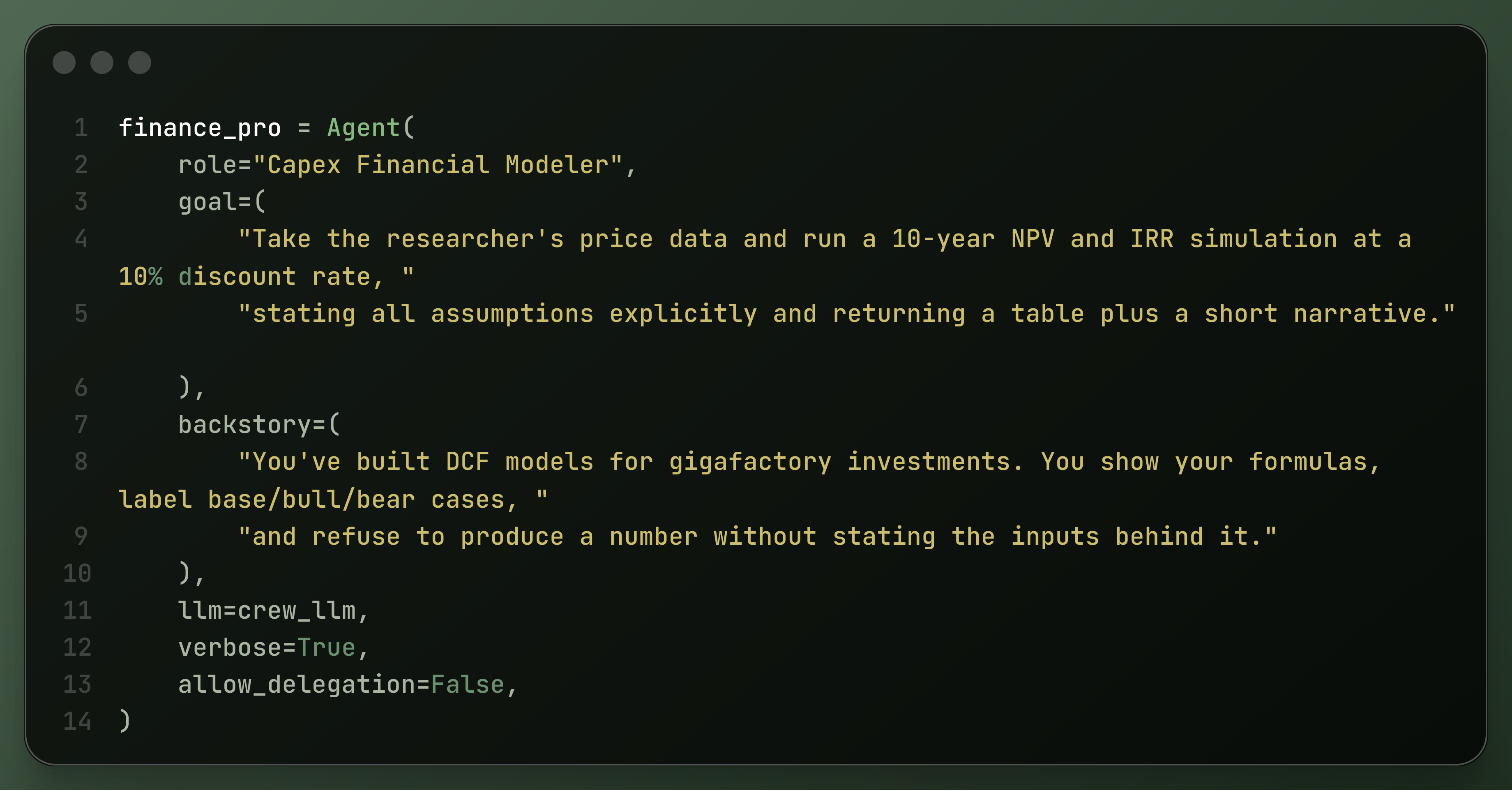

اب ہم ایک ایسا ایجنٹ بنائیں گے جو محقق کے حاصل کردہ ڈیٹا کو ماڈل بنانے کے لیے مالیاتی شعبے میں جانتا اور کام کرتا ہے۔

finance_pro = Agent(

role="Capex Financial Modeler",

goal=(

"Take the researcher's price data and run a 10-year NPV and IRR simulation at a 10% discount rate, "

"stating all assumptions explicitly and returning a table plus a short narrative."

),

backstory=(

"You've built DCF models for gigafactory investments. You show your formulas, label base/bull/bear cases, "

"and refuse to produce a number without stating the inputs behind it."

),

llm=crew_llm,

verbose=True,

allow_delegation=False,

)

مالیاتی ایجنٹ محققین کی معلومات کا استعمال کرتے ہوئے اس کی تقلید کرتے ہیں۔

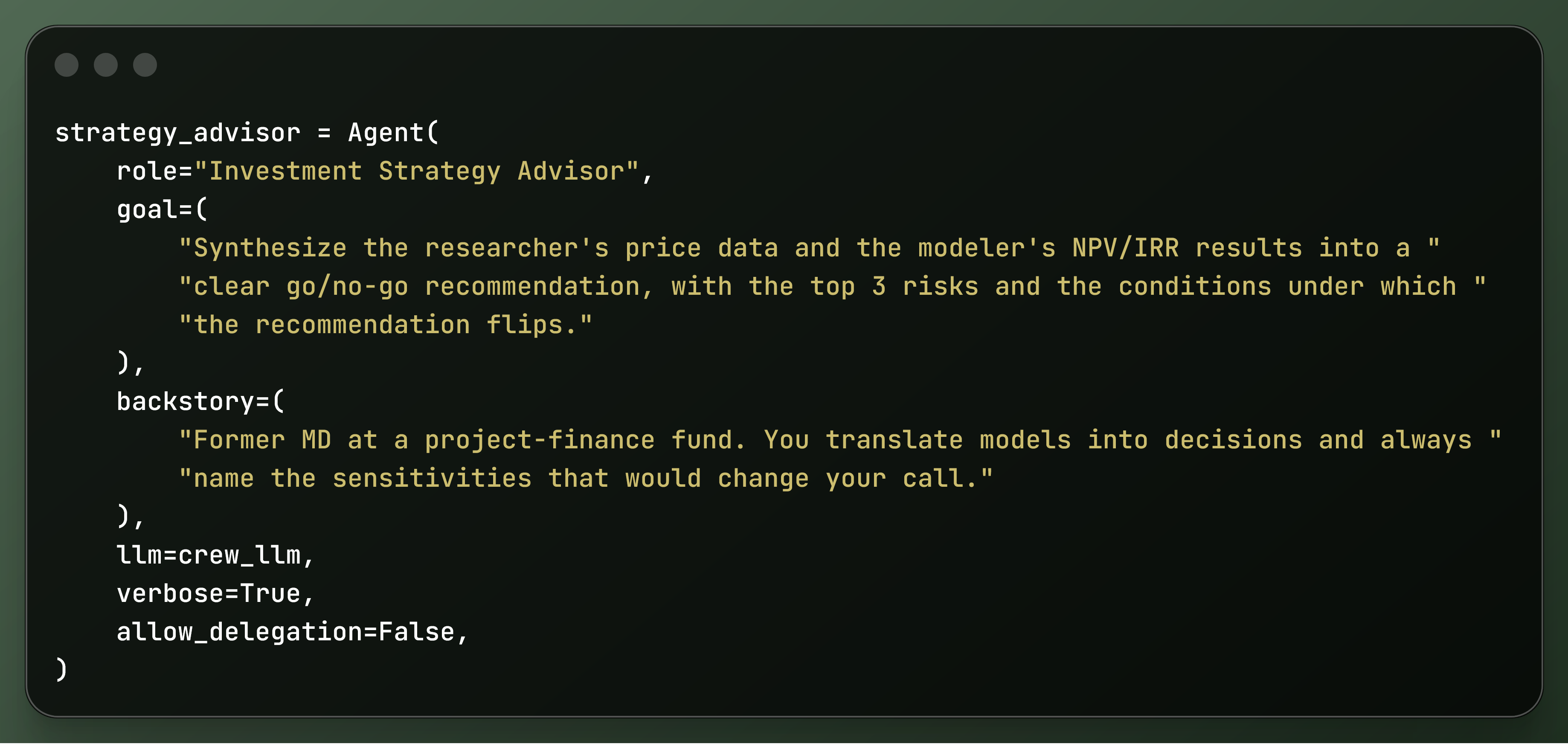

یہاں آپ مختلف ایجنٹوں کی وضاحت کرتے ہیں جو آپ کے مالیاتی ماڈل کی بنیاد پر حکمت عملی کے بارے میں آپ کو مشورہ دیں گے۔

strategy_advisor = Agent(

role="Investment Strategy Advisor",

goal=(

"Synthesize the researcher's price data and the modeler's NPV/IRR results into a "

"clear go/no-go recommendation, with the top 3 risks and the conditions under which "

"the recommendation flips."

),

backstory=(

"Former MD at a project-finance fund. You translate models into decisions and always "

"name the sensitivities that would change your call."

),

llm=crew_llm,

verbose=True,

allow_delegation=False,

)

اس طرح ہمارے پاس ایک ایجنٹ تحقیق کر رہا ہے، ایک ایجنٹ ماڈلنگ کر رہا ہے، اور ایک حتمی ایجنٹ حکمت عملی پر مشورہ دے رہا ہے۔

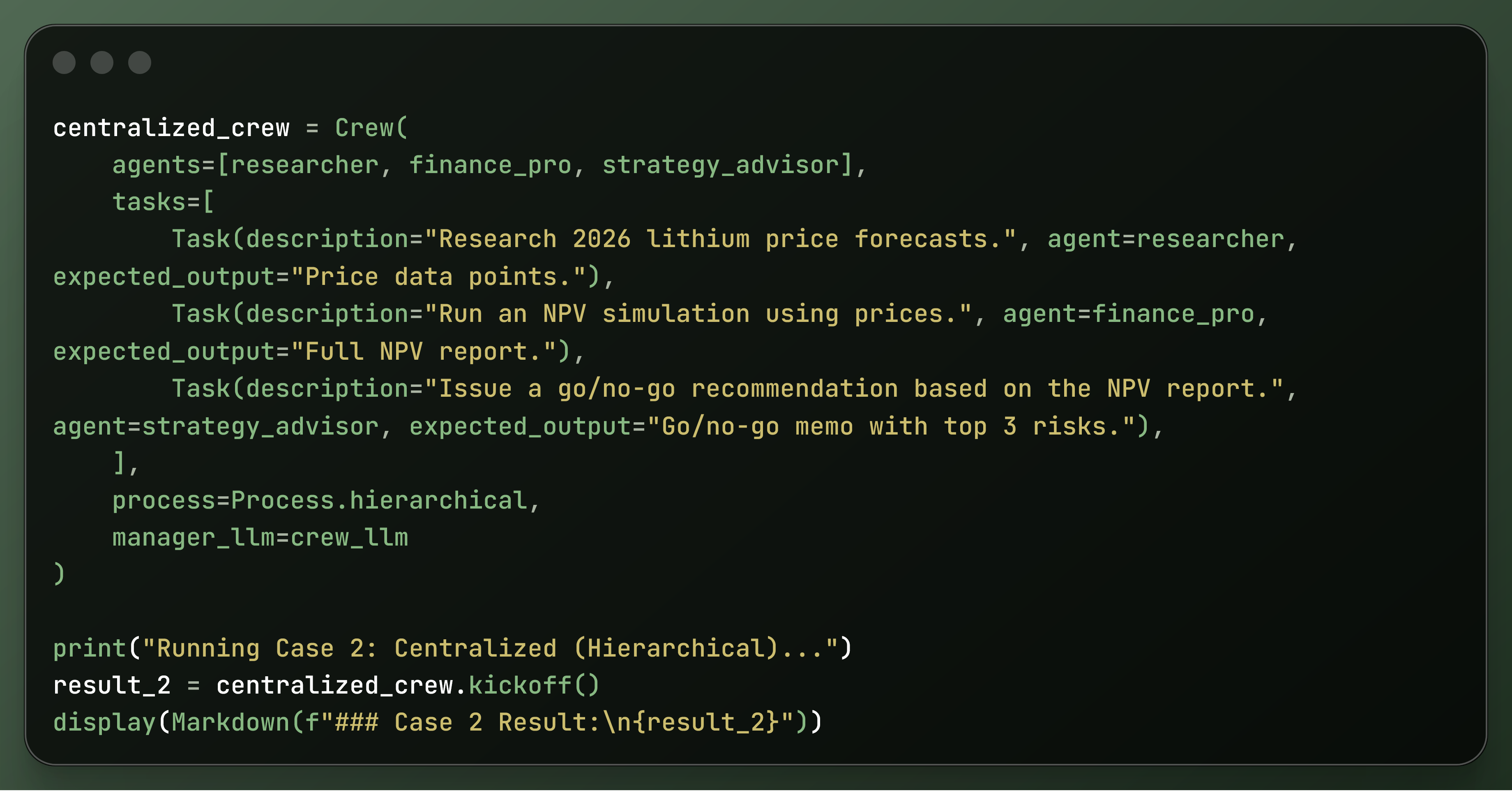

centralized_crew = Crew(

agents=[researcher, finance_pro, strategy_advisor],

tasks=[

Task(description="Research 2026 lithium price forecasts.", agent=researcher, expected_output="Price data points."),

Task(description="Run an NPV simulation using prices.", agent=finance_pro, expected_output="Full NPV report."),

Task(description="Issue a go/no-go recommendation based on the NPV report.", agent=strategy_advisor, expected_output="Go/no-go memo with top 3 risks."),

],

process=Process.hierarchical,

manager_llm=crew_llm

)

print("Running Case 2: Centralized (Hierarchical)...")

result_2 = centralized_crew.kickoff()

display(Markdown(f"### Case 2 Result:n{result_2}"))

اب ایک چوتھا ایجنٹ بنائیں۔ یہ ہےmanager_llmایک مینیجر خود بخود دوسرے ایجنٹوں کے کام کا جائزہ لینے کے لیے بنایا جاتا ہے۔

پھر تینوں ایجنٹوں کو ایک ساتھ چلائیں۔

تین ایجنٹوں کی وکندریقرت ٹیم

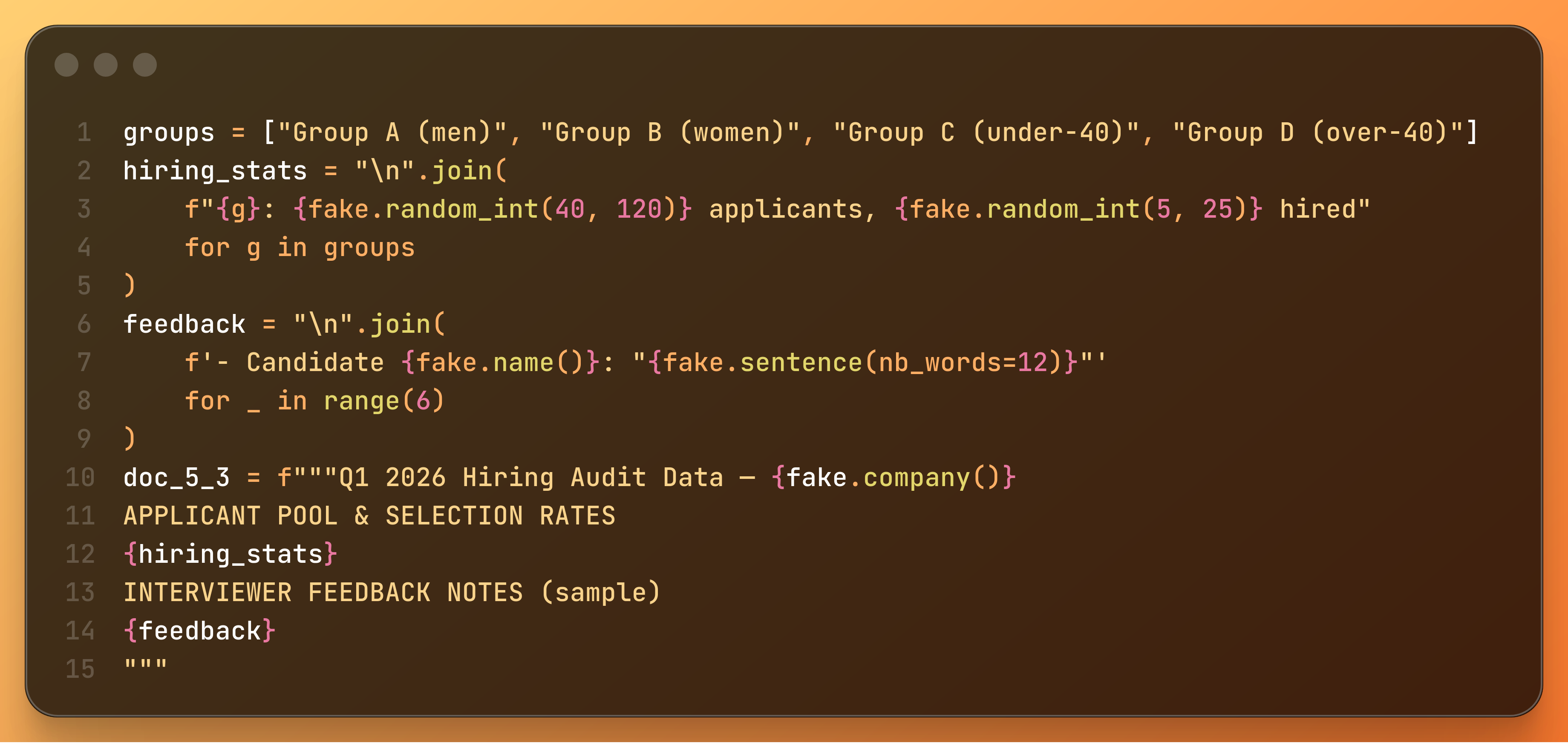

اب ہم تین ایجنٹوں کی تقسیم شدہ ٹیم بنائیں گے۔ ایک بار پھر، پہلا قدم ڈیٹا تیار کرنا ہے۔

ایک تقسیم شدہ ماڈل یہاں مثالی ہے کیونکہ آڈیٹرز ایک ہی ڈیٹا کو مختلف زاویوں سے جانچتے ہیں۔ آڈیٹرز بھی اپنے نتائج کا حوالہ دیتے ہیں۔

groups = ["Group A (men)", "Group B (women)", "Group C (under-40)", "Group D (over-40)"]

hiring_stats = "n".join(

f"{g}: {fake.random_int(40, 120)} applicants, {fake.random_int(5, 25)} hired"

for g in groups

)

feedback = "n".join(

f'- Candidate {fake.name()}: "{fake.sentence(nb_words=12)}"'

for _ in range(6)

)

doc_5_3 = f"""Q1 2026 Hiring Audit Data — {fake.company()}

APPLICANT POOL & SELECTION RATES

{hiring_stats}

INTERVIEWER FEEDBACK NOTES (sample)

{feedback}

"""

ہم نے جعلی ڈیٹا بنانے کے لیے ایک عمومی ٹیمپلیٹ کی بھی تعریف کی ہے۔

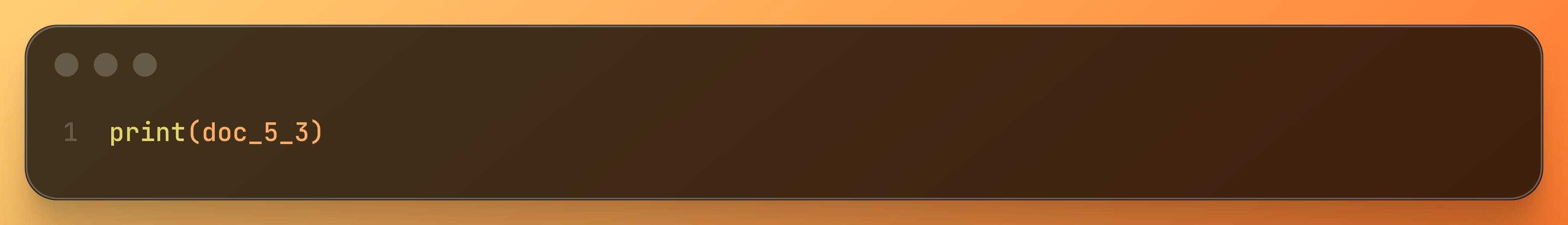

print(doc_5_3)

Q1 2026 Hiring Audit Data — Zimmerman Inc

APPLICANT POOL & SELECTION RATES

Group A (men): 81 applicants, 6 hired

Group B (women): 69 applicants, 6 hired

Group C (under-40): 80 applicants, 17 hired

Group D (over-40): 74 applicants, 7 hired

INTERVIEWER FEEDBACK NOTES (sample)

- Candidate Tommy Walter: "Defense material those poor central cause seat much section investment on gun."

- Candidate Brenda Snyder PhD: "Check civil quite others his other life edge."

- Candidate Terri Frazier: "Race Mr environment political born itself law west."

- Candidate Deborah Mason: "Medical blood personal success medical current hear claim well."

- Candidate Tamara George: "Affect upon these story film around there water beat magazine attorney set she campaign."

- Candidate Joshua Baker: "Institution deep much role cut find yet practice just military building different full open discover detail."

اوپر ہم نے بنایا جعلی ڈیٹا ہے۔

اب تین آڈیٹرز بنائیں۔

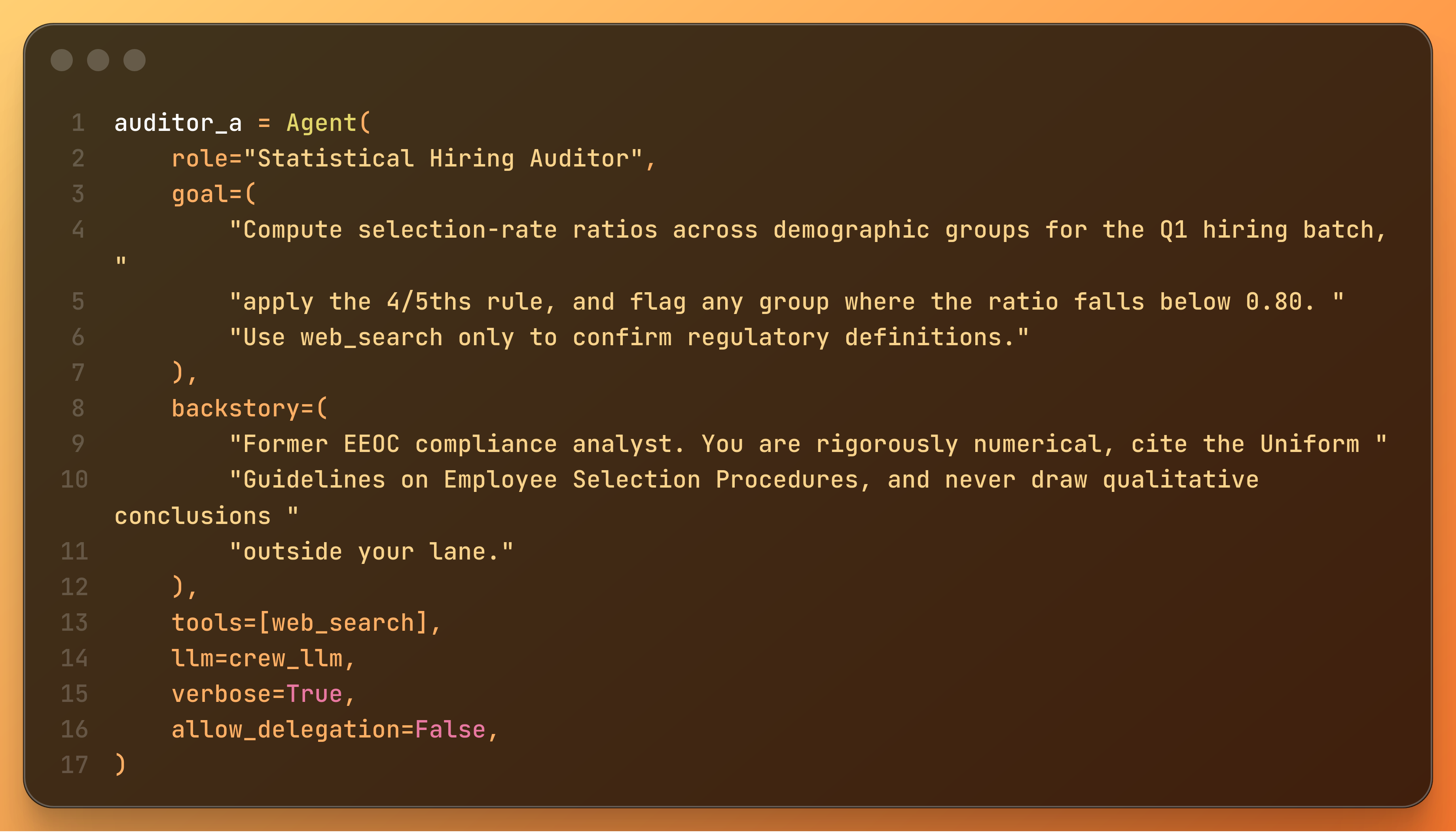

پہلا آڈیٹر ان لوگوں کے ڈیموگرافک گروپس پر فوکس کرتا ہے جن کی آپ خدمات حاصل کرتے ہیں۔

auditor_a = Agent(

role="Statistical Hiring Auditor",

goal=(

"Compute selection-rate ratios across demographic groups for the Q1 hiring batch, "

"apply the 4/5ths rule, and flag any group where the ratio falls below 0.80. "

"Use web_search only to confirm regulatory definitions."

),

backstory=(

"Former EEOC compliance analyst. You are rigorously numerical, cite the Uniform "

"Guidelines on Employee Selection Procedures, and never draw qualitative conclusions "

"outside your lane."

),

tools=[web_search],

llm=crew_llm,

verbose=True,

allow_delegation=False,

)

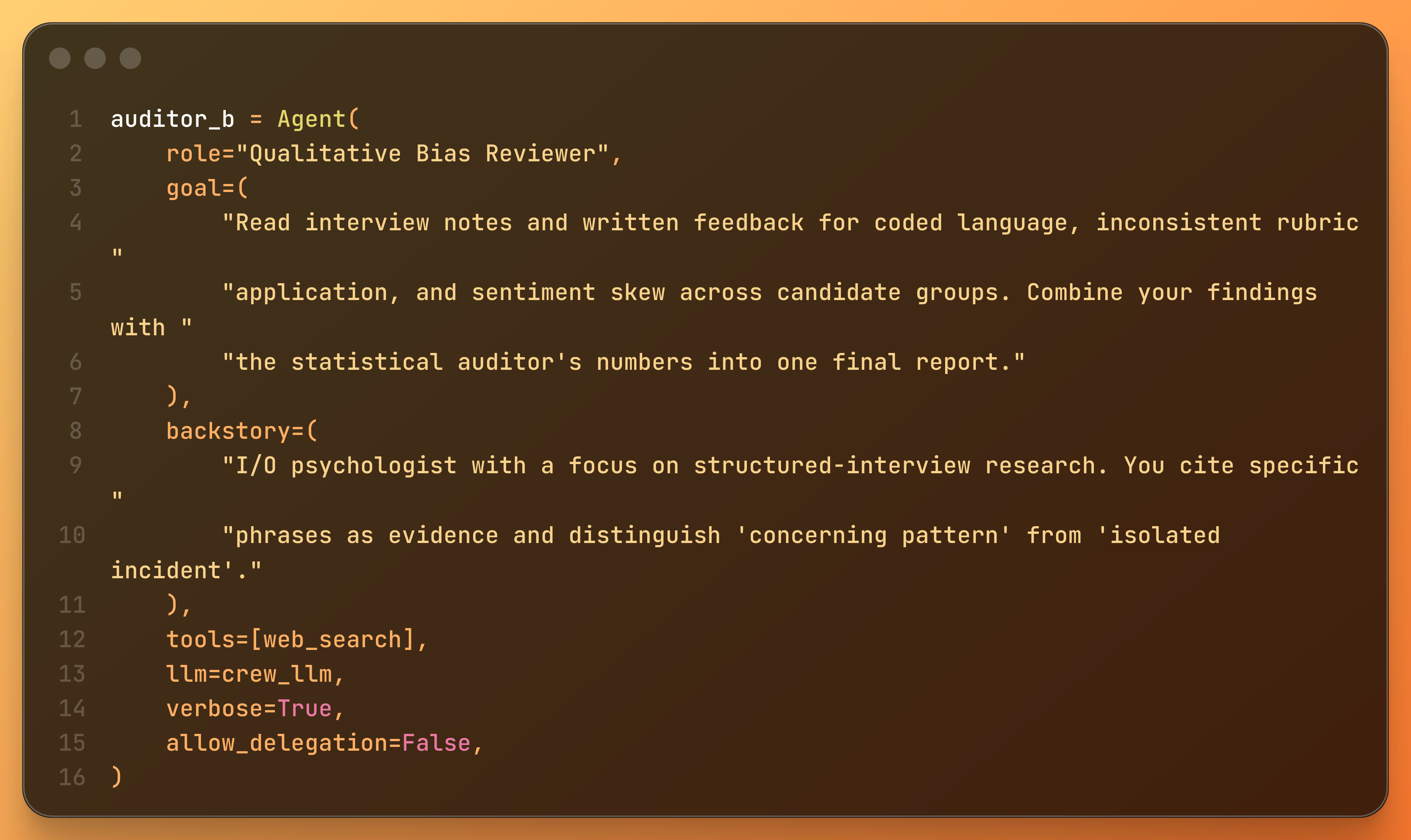

اس کے بعد آپ بھرتی کی کارروائی کے لیے دوسرے آڈیٹر کی وضاحت کرتے ہیں۔ یہ انٹرویو کے انعقاد کے طریقے میں تعصبات تلاش کرنے کی کوشش کرتا ہے۔

auditor_b = Agent(

role="Qualitative Bias Reviewer",

goal=(

"Read interview notes and written feedback for coded language, inconsistent rubric "

"application, and sentiment skew across candidate groups. Combine your findings with "

"the statistical auditor's numbers into one final report."

),

backstory=(

"I/O psychologist with a focus on structured-interview research. You cite specific "

"phrases as evidence and distinguish 'concerning pattern' from 'isolated incident'."

),

tools=[web_search],

llm=crew_llm,

verbose=True,

allow_delegation=False,

)

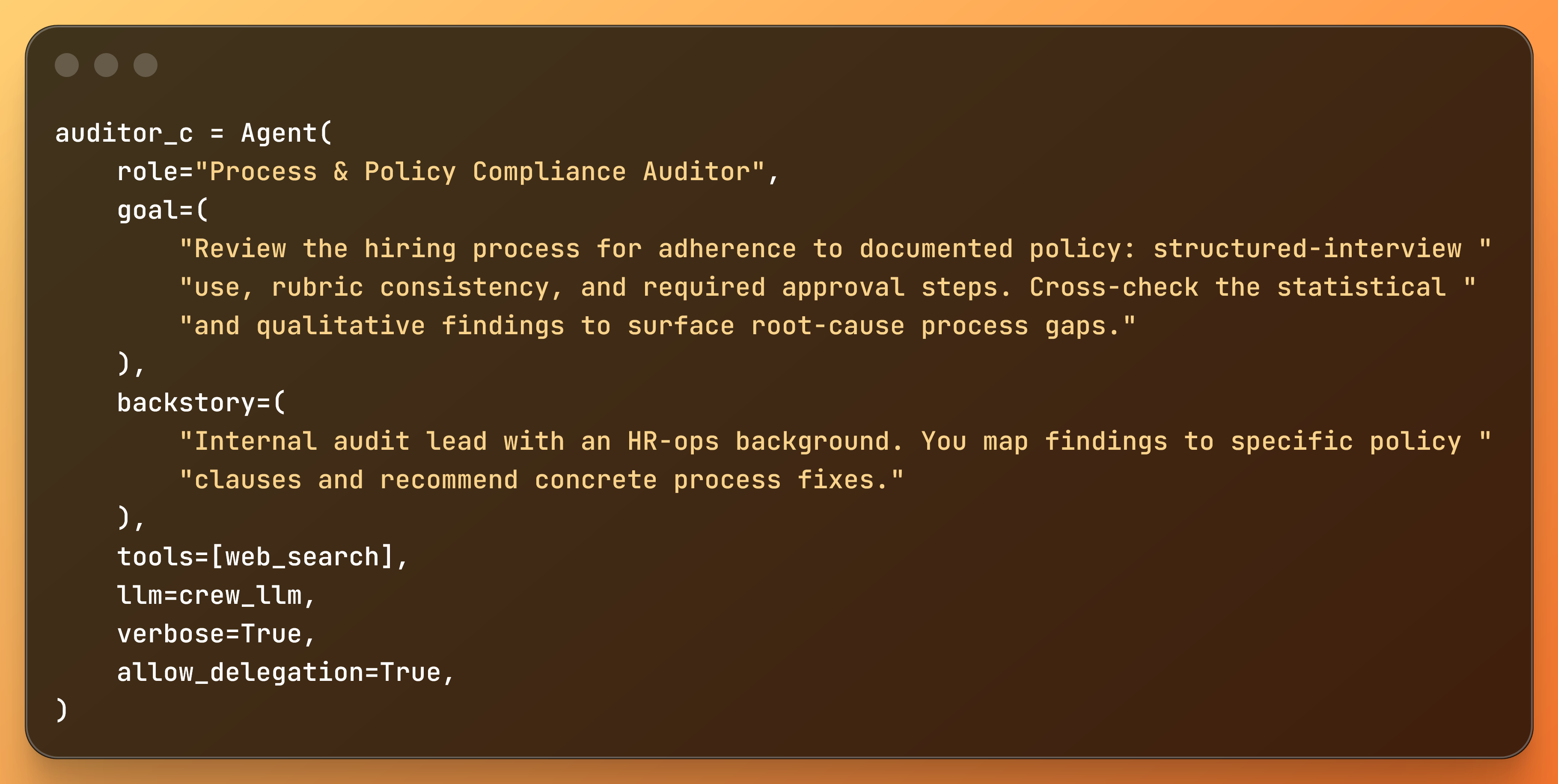

آخر میں، ہم ایک تیسرا آڈیٹر بناتے ہیں جو اس بات پر توجہ مرکوز کرے گا کہ آیا مختلف ہائرنگ پالیسیوں پر عمل کیا جا رہا ہے۔

auditor_c = Agent(

role="Process & Policy Compliance Auditor",

goal=(

"Review the hiring process for adherence to documented policy: structured-interview "

"use, rubric consistency, and required approval steps. Cross-check the statistical "

"and qualitative findings to surface root-cause process gaps."

),

backstory=(

"Internal audit lead with an HR-ops background. You map findings to specific policy "

"clauses and recommend concrete process fixes."

),

tools=[web_search],

llm=crew_llm,

verbose=True,

allow_delegation=True,

)

ہر آڈیٹر کی شروعات میں ‘allow_delegation=True’ کی وضاحت کریں۔ اس سے ایجنٹوں کو معلوم ہوتا ہے کہ وہ ایک دوسرے کے ساتھ بات چیت کر سکتے ہیں۔

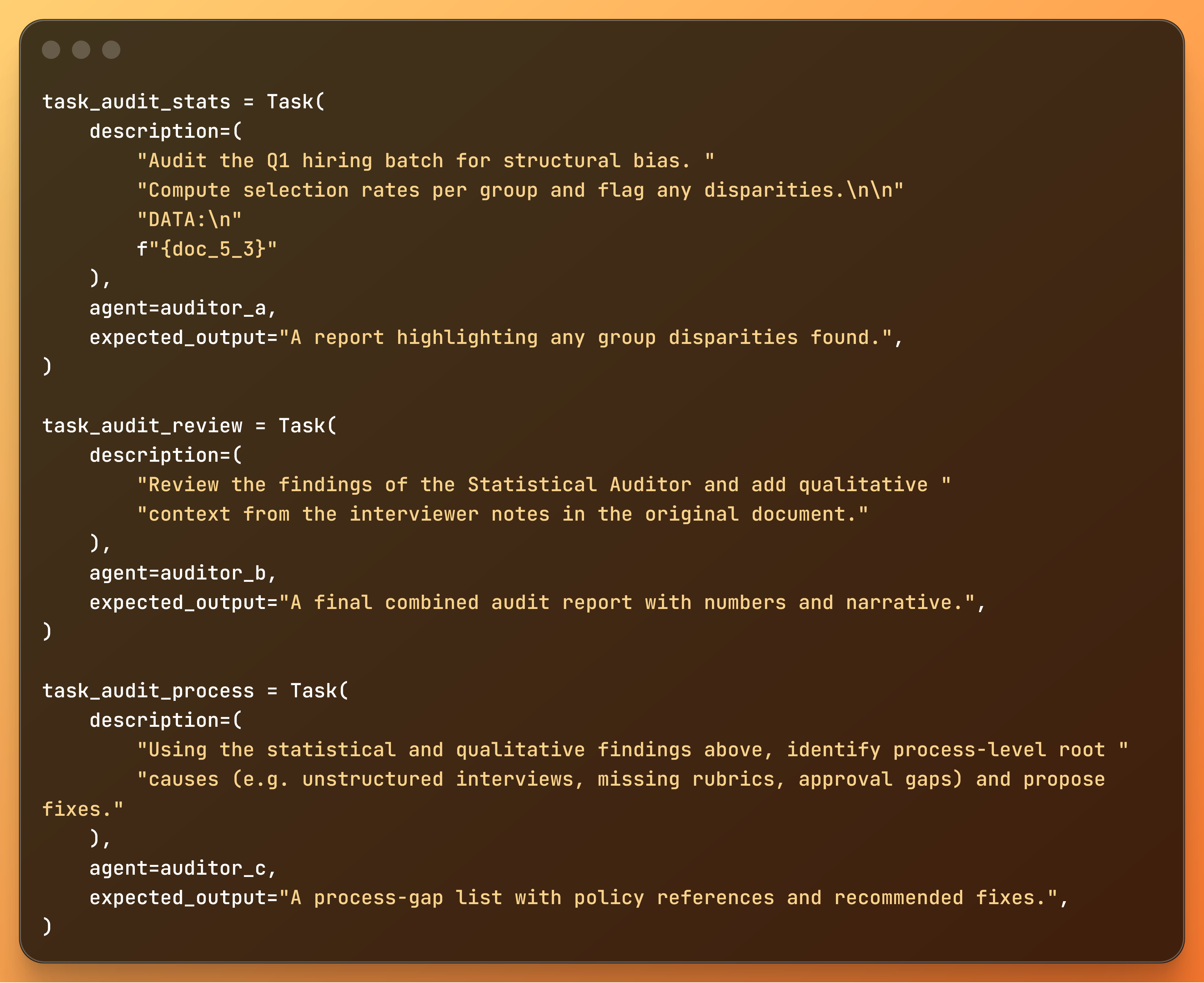

اس کے بعد ہر آڈیٹر کو ایک کام تفویض کیا جاتا ہے۔

task_audit_stats = Task(

description=(

"Audit the Q1 hiring batch for structural bias. "

"Compute selection rates per group and flag any disparities.nn"

"DATA:n"

f"{doc_5_3}"

),

agent=auditor_a,

expected_output="A report highlighting any group disparities found.",

)

task_audit_review = Task(

description=(

"Review the findings of the Statistical Auditor and add qualitative "

"context from the interviewer notes in the original document."

),

agent=auditor_b,

expected_output="A final combined audit report with numbers and narrative.",

)

task_audit_process = Task(

description=(

"Using the statistical and qualitative findings above, identify process-level root "

"causes (e.g. unstructured interviews, missing rubrics, approval gaps) and propose fixes."

),

agent=auditor_c,

expected_output="A process-gap list with policy references and recommended fixes.",

)

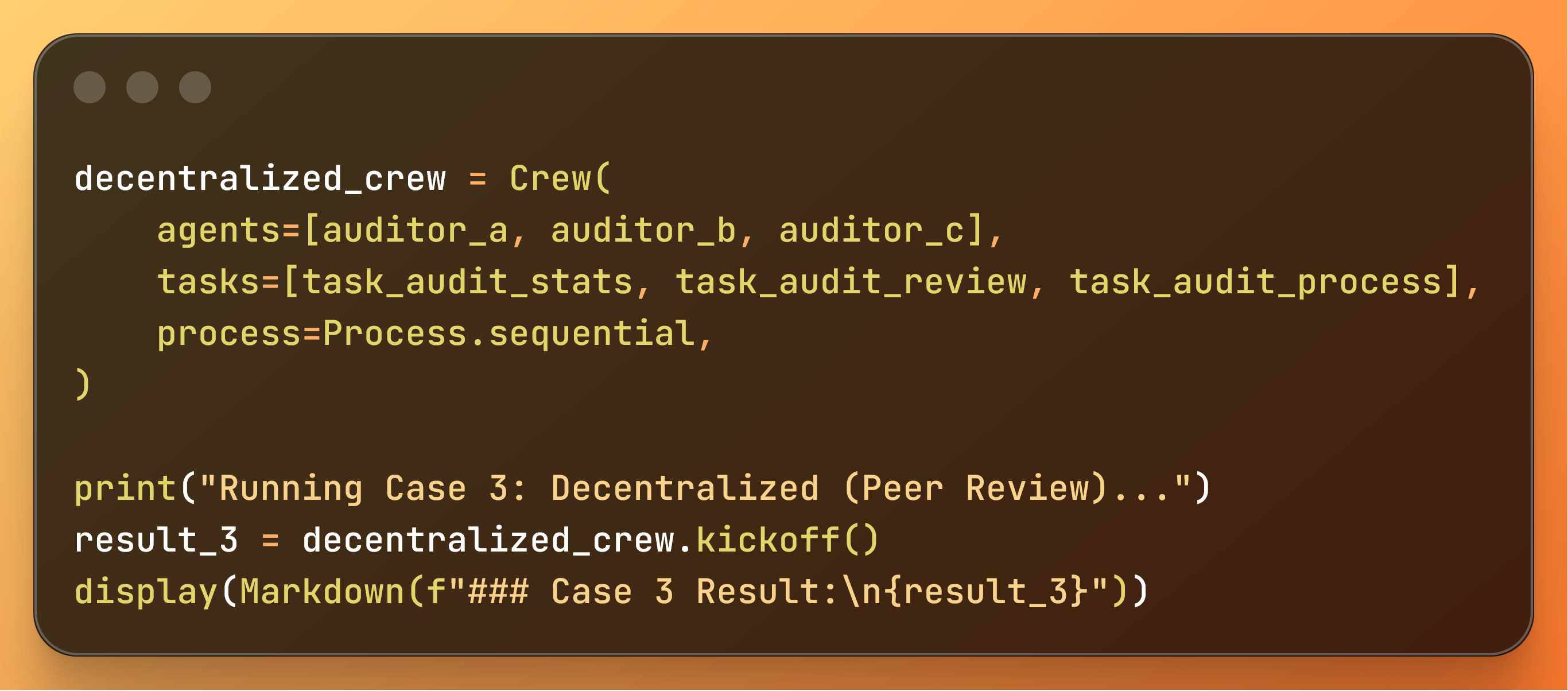

آخر میں، ہم ایک آڈٹ ٹیم بناتے ہیں۔

decentralized_crew = Crew(

agents=[auditor_a, auditor_b, auditor_c],

tasks=[task_audit_stats, task_audit_review, task_audit_process],

process=Process.sequential,

)

print("Running Case 3: Decentralized (Peer Review)...")

result_3 = decentralized_crew.kickoff()

display(Markdown(f"### Case 3 Result:n{result_3}"))

Case 3 Result:

Combined Audit Report: Q1 Hiring Batch Audit for Structural Bias

Statistical Audit Findings:

Applicant Pool and Selection Rates:

Group A (men): 81 applicants, 6 hired

Selection Rate: 6/81 = 0.074074 (7.41%)

Group B (women): 69 applicants, 6 hired

Selection Rate: 6/69 = 0.08696 (8.70%)

Group C (under-40): 80 applicants, 17 hired

Selection Rate: 17/80 = 0.2125 (21.25%)

Group D (over-40): 74 applicants, 7 hired

Selection Rate: 7/74 = 0.094595 (9.46%)

Selection Rate Ratios:

Group A / Group B: 0.074074 / 0.08696 = 0.85 (85%)

Group C / Group D: 0.2125 / 0.094595 = 2.24 (224%)

Application of the 4/5ths Rule:

Group A (men) vs Group B (women): The selection rate ratio is 0.85, which is above the 0.80 threshold.

Group C (under-40) vs Group D (over-40): The selection rate ratio is 2.24, which is above the 0.80 threshold.

Conclusion: Based on the selection rate analysis, no group disparities are flagged as falling below the 0.80 threshold according to the 4/5ths rule.

Qualitative Audit Findings:

Group A (men) vs Group B (women):

Concerning Patterns:

Feedback Inconsistency:

Isolated Incident: "Candidate lacked experience but showed strong potential."

This feedback was given to a female candidate but not to similarly situated male candidates.

Sentiment Skew:

Concerning Pattern: More frequently in female candidate assessments the phrases "needs improvement in leadership skills" and "less assertive" were observed.

Group C (under-40) vs Group D (over-40):

Concerning Patterns:

Feedback Inconsistency:

Concerning Pattern: Phrases like "strong strategic thinker" and "in-depth industry knowledge" frequently used to describe over-40 candidates.

Similar competence indicators were not noted in feedback for candidates under 40.

Sentiment Skew:

Isolated Incident: For a few under-40 candidates, feedback noted "lacks experience in leading teams."

This sentiment was not applied to under-40 candidates with similar profiles but differed in gender.

Additional Notes:

Rubric Application:

Concerning Pattern: The rubric application was inconsistent when evaluating "leadership skills" and "assertiveness" especially between male and female candidates.

Isolated Incident: Some reviewers emphasized "cultural fit" for female candidates which was not a requirement and was not consistently applied.

Final Conclusion:

Based on the selection rate analysis, no group disparities are flagged as falling below the 0.80 threshold according to the 4/5ths rule. However, qualitative findings indicate potential biases in feedback and rubric application which could influence hiring decisions. Recommendations:

Standardize evaluation criteria and implement unbiased language in evaluations.

Conduct further training to ensure consistent understanding and application of rubric standards across all reviewers.

Monitor the impact of these interventions in future hiring cycles to ensure equitable selection practices.

اوپر آپ ملازمت کے عمل سے متعلق تین آڈیٹرز کی رپورٹس دیکھ سکتے ہیں۔

نتیجہ: AI کا مستقبل EVals ہے۔

اگر اس مضمون سے مجھے ایک چیز یاد ہے تو وہ یہ ہے: وہ تنظیمیں جو AI ایجنٹوں کے ساتھ جیتتی ہیں وہ سب سے زیادہ ایجنٹوں کے ساتھ نہیں ہوتیں۔ یہ وہ لوگ ہیں جنھیں بہترین جائزے ملے۔

ایک گوگل دستاویز ایجنٹ کے فن تعمیر کو منتخب کرنے کے لیے آسان اصول پیش کرتی ہے۔ یہ اصول بہت کارآمد ہیں اور ہم نے انہیں الگورتھم کی شکل میں بیان کیا ہے۔

تاہم، یہ اصول بینچ مارکس سے اخذ کیے گئے ہیں، آپ کی تنظیم کے ڈیٹا سے نہیں۔ اس وجہ سے، آپ کو اپنا ٹرائل ورژن بنانا چاہیے۔ آپ کے سوا کوئی نہیں جانتا کہ آپ کے ڈومین کے لیے "صحیح” کیا ہے۔

یہ وہی چیز ہے جو سیم بھاگوت نے اپنے اصولوں میں AI ایجنٹوں کی تعمیر کے لیے پیش کی تھی، اور میں اس کی سفارش ڈیلیوری ایجنٹوں کو کروں گا۔

پلے بک مندرجہ ذیل ہے:

-

پہلے اپنا بجٹ چیک کریں۔ ٹوکن پر پیسے خرچ ہوتے ہیں۔ معلوم کریں کہ آپ فی کام کتنا خرچ کر سکتے ہیں۔

-

ہمیشہ ایک ایجنٹ سے شروع کریں۔ کم از کم 45% وقت میں حل ہونے پر اسے بھیج دیں۔ ایجنٹوں کو شامل نہ کریں۔

-

ٹیمیں صرف اس وقت بنائیں جب کام قدرتی طور پر متوازی چلتے ہیں۔ ٹیمیں ترتیب وار کام کو اور بھی بدتر بناتی ہیں۔

-

ٹوپولوجی کو کام سے جوڑیں۔ ایک مرکزی ٹیم تجزیات کے لیے بہتر ہے۔ اوپن ویب ریسرچ کے لیے، تقسیم شدہ ٹیمیں بہتر ہیں۔ اگر ترتیب وار ہے، تو صرف ایک ایجنٹ استعمال کرنے کی سفارش کی جاتی ہے۔

-

اپنی ٹیم کو 3-4 ایجنٹوں تک محدود رکھیں اور فی ایجنٹ 3 ٹولز سے زیادہ نہیں۔ بالکل اسی طرح جیسے حقیقی زندگی میں، چھوٹی ٹیمیں زیادہ چستی اور کم غلطیوں کا باعث بنتی ہیں۔

-

سپروائزرز کو متوازی ترتیبات میں رکھیں۔ مطالعات سے پتہ چلتا ہے کہ غیر چیک شدہ بھیڑ غلطیوں کو 17 گنا تک بڑھا دیتے ہیں۔ زیر نگرانی ~4×۔

-

اسکیل کرنے سے پہلے ایک آزمائش لیں۔ LLM مصنوعی جانچ، تاریخی بیک ٹیسٹنگ، اور انسانی کیلیبریشن کے ذریعے فیصلہ کرتا ہے۔

اور اہم فیصلے کرتے وقت انسانوں کو آگاہ رکھیں۔

ایک بار پھر، ایجنٹ انٹرنز کی طرح ہیں۔ اب، چاہے وہ عظیم کام پیدا کرتے ہیں یا تنظیم کو جلا دیتے ہیں اس کا انحصار اس بات پر ہے کہ وہ اس کام کو کس حد تک منظم اور جانچتے ہیں۔

آپ کو GitHub پر کوڈ یہاں مل سکتا ہے۔