ہر GPU نسل ایک ہی رکاوٹ کے تابع ہے: میموری۔ ماڈلز میموری کی صلاحیت سے زیادہ تیزی سے بڑھتے ہیں، انجینئرز کو پیچیدہ ملٹی-GPU سیٹ اپ استعمال کرنے، جارحانہ کوانٹائزیشن، یا تکلیف دہ تجارت کرنے پر مجبور کرتے ہیں۔

NVIDIA کا بلیک ویل فن تعمیر، جو 2024 میں ہوپر کی پیروی کرے گا، اس مسئلے پر ہارڈ ویئر کی سطح پر حملہ کرتا ہے، نہ صرف اس بات پر دوبارہ غور کرتا ہے کہ GPU کی کتنی میموری ہے، بلکہ GPU کو مجموعی طور پر کس طرح تشکیل دیا جاتا ہے اور اس تک رسائی حاصل کی جاتی ہے۔

Llama 3 70B کو چلانا اب کوئی مسئلہ نہیں ہے۔ متوازی یا سخت میموری کی حدود کے ساتھ اپنے ماڈلز پر زور دینے کی ضرورت نہیں ہے۔ اس کے بجائے، اب ہم ایک ہی ہارڈویئر فوٹ پرنٹ کے ساتھ بہت بڑی تعداد میں پیرامیٹرز کو سنبھال سکتے ہیں۔

یہ مضمون یادداشت میں بہتری کی تفصیلات بتاتا ہے جو بلیک ویل کو آج کا سب سے زیادہ قابل AI ایکسلریٹر بناتا ہے۔

شرطیں

یہ مضمون فرض کرتا ہے کہ آپ کچھ GPU بنیادی باتوں سے واقف ہیں۔ اگر ان میں سے کوئی بھی متزلزل محسوس کرتا ہے، تو آپ منسلک وسائل کے ذریعے ہر ایک کو 10 سے 15 منٹ میں رفتار تک پہنچا سکتے ہیں۔

-

GPU اناٹومی – ایس ایم، رجسٹر، مشترکہ میموری (L1)، L2 کیش اور میموری کنٹرولر کا کردار کی تعریف۔ [Memory Hierarchy of GPUs]

-

تین میموری میٹرکس — صلاحیت (کتنا مناسب ہے)، بینڈوتھ (ڈیٹا کتنی تیزی سے منتقل ہوتا ہے) اور تاخیر (ایک ہی رسائی میں کتنا وقت لگتا ہے)۔ وہ قابل تبادلہ نہیں ہیں اور بلیک ویل تینوں کو مختلف طریقے سے بہتر بناتا ہے۔ [GPU Memory Bandwidth]

-

GPU میموری کی قسم — HBM, GDDR اور LPDDR5X اور ان کے درمیان بینڈوتھ/کیپیسٹی/پاور بیلنس۔ [Cuda GPU Memory Types]

-

چپ آپس میں منسلک — PCIe، NVLink، اور chip-to-chip (C2C) لنک آئیڈیاز۔ [The AI Systems Game]

اگر آپ چاروں پر قائم رہتے ہیں تو آپ تیار ہیں۔

انڈیکس

نسلی چھلانگ

اس سے پہلے کہ ہم یہ دیکھیں کہ بلیک ویل نے کارکردگی کو کس طرح بڑھایا، پچھلی GPU نسل سے کیا تبدیل ہوا ہے:

| قیاس آرائی | ہوپر H100 | بلیک ویل B200 | تبدیلی |

|---|---|---|---|

| HBM صلاحیت | 80GB (HBM3) | 192GB (HBM3e) | 2.4× |

| HBM بینڈوتھ | 3.35 ٹی بی فی سیکنڈ | 8TB/سیکنڈ | 2.4× |

| L2 کیشے | 50MB | 126MB | 2.5× |

| L1/SM کے ذریعے اشتراک کردہ | 256KB | 128KB | 0.5× |

| ڈائی ڈیزائن | مضبوطی سے ایک کے طور پر بنے ہوئے | ڈوئل ڈائی (MCM) | – |

| سی پی یو انضمام | الگ (PCIe) | انٹیگریشن (NVLink C2C) | – |

نمبرز والیوم بولتے ہیں: زیادہ میموری، زیادہ بینڈوتھ، بڑا کیش۔ اس مضمون کا بقیہ حصہ یہ بتاتا ہے کہ یہ ٹکڑے کیسے اکٹھے ہوتے ہیں۔

جی بی 200 سپر چپ

Grace Blackwell (GB200) سپر چپ ڈیزائن کی توسیع ہے جسے NVIDIA نے Grace Hopper (GH200) کے ساتھ متعارف کرایا ہے۔ یہاں، اے آر ایم پر مبنی گریس سی پی یو کو جی پی یو چپ کے ساتھ ایک پیکج میں ملا کر ایک مربوط کمپیوٹنگ سسٹم بنایا گیا ہے۔

بلیک ویل جنریشن میں، GB200 دو بلیک ویل GPUs اور ایک Grace CPU کو جوڑتا ہے جو NVLink Chip-to-Chip (NVLink-C2C) کے ذریعے جڑا ہوا ہے، ایک اعلی بینڈوتھ انٹرفیس جو CPU اور GPU کو میموری کا اشتراک کرنے اور ایک نظام کے طور پر کام کرنے کی اجازت دیتا ہے۔

گریس سی پی یو

Grace CPU ایک ARM Neoverse v2 ہے جسے NVIDIA نے بینڈوتھ اور کارکردگی کے لیے ڈیزائن کیا ہے۔ یہ عام مقصد کے کاموں، پری پروسیسنگ اور ٹوکنائزیشن کو سنبھالتا ہے، اور NVLink C-2-C کے ذریعے GPU کو ڈیٹا فیڈ کرتا ہے۔ گریس سی پی یو جی پی یو کے لیے توسیعی اسٹوریج کے طور پر کام کرتا ہے۔

گریس سی پی یوز اعتدال پسند گھڑی کی رفتار سے چلتے ہیں، لیکن LPDDR5X میموری کے لیے 500GB/s تک کی بڑی میموری بینڈوتھ کی تلافی کے لیے تقریباً 100MB L3 کیشے کا استعمال کرتے ہیں (کم پاور ڈبل ڈیٹا ریٹ 5x – بعد میں اس پر مزید)۔

LPDDR5X (کم پاور ڈوئل ڈیٹا ریٹ 5x)

LPDDR5X ایک تیز رفتار میموری کا معیار ہے جو 10.7Gbps تک ڈیٹا فراہم کرتا ہے۔ LPDDR5X کم بجلی کی کارکردگی پیش کرتا ہے، اسے استعمال کے ان معاملات کے لیے مثالی بناتا ہے۔

یہ کارکردگی اور بجلی کی کارکردگی کے درمیان کامل توازن برقرار رکھتا ہے، 500GB/s تک ڈیلیور کرتا ہے جبکہ صرف 16W استعمال کرتا ہے، تقریباً 1/5 روایتی DDR5 میموری کی طاقت۔

بلیک ویل جی پی یو

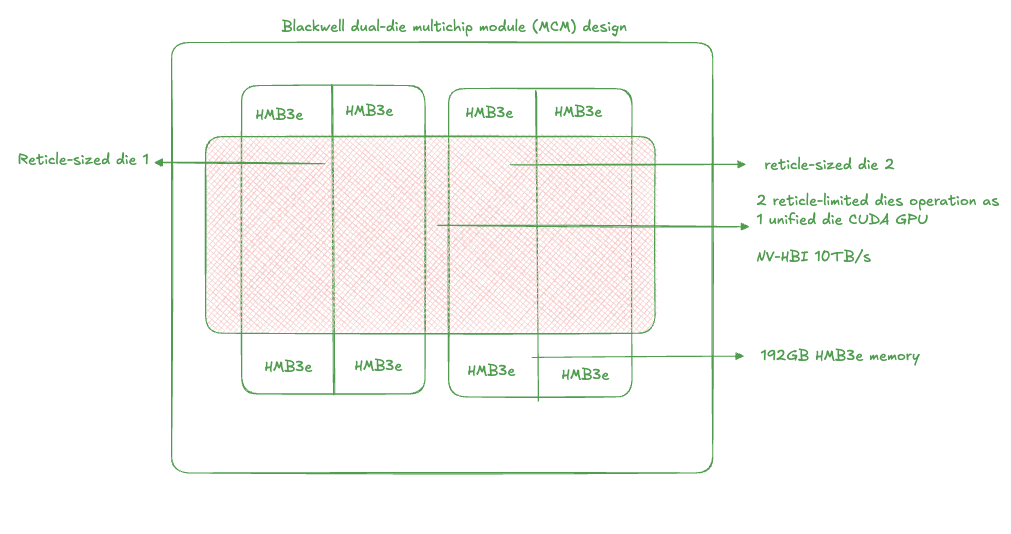

بلیک ویل GPUs پچھلے Hopper GPU ماڈلز کے مقابلے میں نمایاں بہتری پیش کرتے ہیں، خاص طور پر میموری کے لحاظ سے۔ بلیک ویل GPUs کو ڈوئل ڈائی GPUs کے طور پر ڈیزائن کیا گیا ہے، جس میں ایک ہی ماڈیول میں دو GPU ڈیز ہوتے ہیں۔

مکمل کارکردگی کو یقینی بنانے کے لیے ہر ڈائی ایک انتہائی تیز 10TB/s NVIDIA ہائی بینڈوتھ انٹرفیس (NV-HBI) سے منسلک ہے۔ ہر ڈائی میں 104 بلین ٹرانجسٹر ہوتے ہیں، دونوں ڈائی میں کل 208 بلین کے لیے۔ ہر ڈائی میں 96GB HBM3e میموری (کل 192GB) بھی شامل ہے، جس میں 180GB دستیاب ہے (12GB خامی کی اصلاح کوڈ (ECC) کے لیے استعمال کیا جاتا ہے، سسٹم فرم ویئر وغیرہ)۔

میموری کی اس مقدار کے ساتھ، بلیک ویل جی پی یو کی میموری بینڈوڈتھ ہوپر جنریشن سے تقریباً 2.4 گنا تیز ہے۔

L2 کیشے کو بھی بڑھا کر 126MB کر دیا گیا ہے۔ L2 کیشے کو بڑھا کر، بلیک ویل HBM کے مزید دوروں سے گریز کرتے ہوئے، زیادہ نیورل نیٹ ورک وزن یا انٹرمیڈیٹ نتائج کو آن چپ اسٹور کر سکتا ہے۔ یہ یقینی بناتا ہے کہ GPU کے کمپیوٹنگ یونٹ میں شاذ و نادر ہی ڈیٹا ختم ہوتا ہے۔

ہائی بینڈوتھ انٹرفیس (NV-HBI)

ہائی بینڈوتھ انٹر کنیکٹ ڈائی ٹو ڈائی (یا d2d) کمیونیکیشنز کا معیار ہے۔ NVIDIA ہائی بینڈوتھ انٹرفیس (NV-HBI) دو GPU ڈیز کو ایک واحد مربوط GPU میں جوڑتا ہے، 10TB/s کنیکٹیویٹی فراہم کرتا ہے۔

NVLINK C-2-C (چپ سے چپ)

NVLink C-2-C Grace CPUs اور Blackwell GPUs کے درمیان 900GB/s تک مواصلات کی رفتار فراہم کرتا ہے، PCIe بس پر CPU سے GPU میموری پول میں میموری کو کاپی کرنے کی ضرورت کو ختم کرتا ہے۔

NVLink C-2-C آپس میں جڑنے کی رفتار عام PCIe بسوں سے تیز ہے۔ NVLink C-2-C کی رفتار کے مقابلے میں PCIe Gen6 صرف 128GB/s فی سمت ہے۔ اس میں کیشے کی مستقل مزاجی بھی ہے۔ اس کا مطلب یہ ہے کہ CPU اور GPU دونوں ایک مستقل میموری فن تعمیر کا اشتراک کرتے ہیں، لہذا CPU GPU میموری کو پڑھ اور لکھ سکتا ہے، اور اس کے برعکس۔

NVIDIA اس یونیفائیڈ میموری فن تعمیر کو یونیفائیڈ CPU-GPU میموری یا توسیعی GPU میموری (EGM) کہتے ہیں۔

میموری کا درجہ بندی اور بینڈوتھ

یہ سمجھنا کہ بلیک ویل کے میموری سسٹمز کے ذریعے ڈیٹا کا بہاؤ AI ورک بوجھ کو بہتر بنانے کی کلید ہے۔ فن تعمیر کلاسک درجہ بندی کے اصولوں کی پیروی کرتا ہے۔ اس کا مطلب یہ ہے کہ چھوٹی، تیز میموری کمپیوٹنگ ڈیوائس کے سب سے قریب واقع ہوتی ہے، جس میں آہستہ آہستہ بڑی لیکن آہستہ میموری کے درجے باہر کی طرف بڑھتے ہیں۔

درجہ بندی کا جائزہ

| میموری کا درجہ بندی | حجم | بینڈوتھ | مقصد |

|---|---|---|---|

| رجسٹر کریں | ~256KB فی SM | فوری | فعال حساب کتاب |

| L1/مشترکہ میموری | ~128KB فی SM | ~40TB/s کل | ڈیٹا سٹیجنگ، تھریڈز میں شیئرنگ |

| L2 کیشے | 64-65 MB فی دن (کل 126 MB تک) | ~20TB/سیکنڈ | SMs کے درمیان ڈیٹا کا دوبارہ استعمال |

| HBM3e | 192 جی بی (180 جی بی دستیاب) | 8TB/سیکنڈ | ماڈل وزن، ایکٹیویشن |

| LPDDR5X(CPU) | ~480GB | ~500GB/s (900GB/s بذریعہ NVLink C2C) | اوور فلو، بڑے پیمانے پر سرایت |

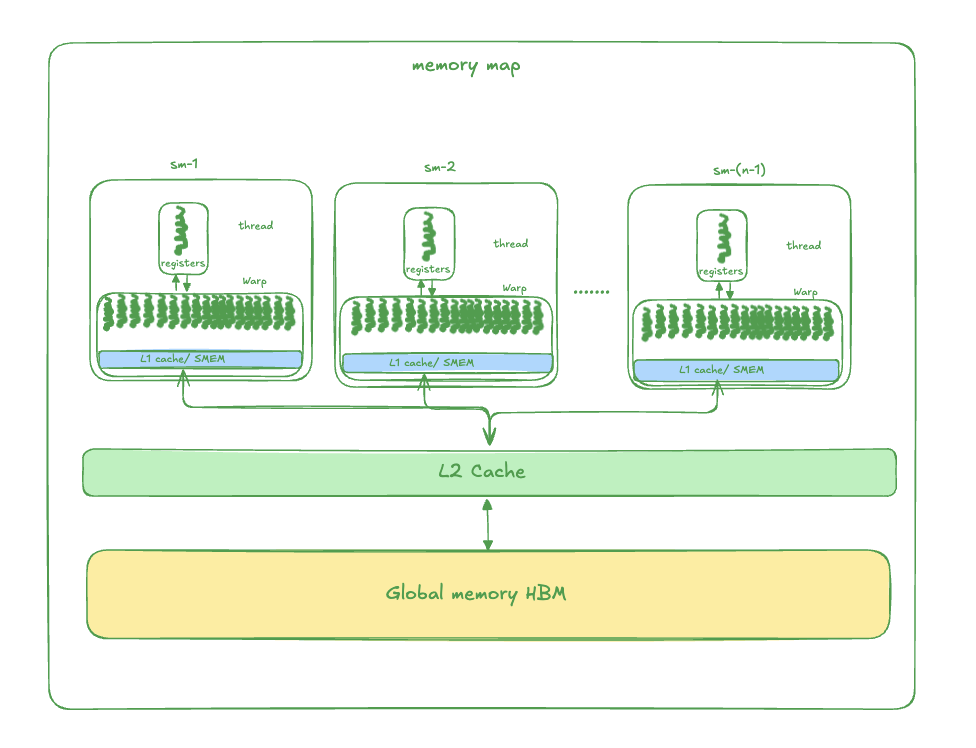

رجسٹر اور L1/مشترکہ میموری

سٹریمنگ ملٹی پروسیسرز (SMs) GPUs پر کمپیوٹنگ ہدایات پر عمل کرتے ہیں۔ سب سے نچلی سطح پر، ہر اسٹریمنگ ملٹی پروسیسر (SM) میں ایک رجسٹر فائل اور قابل ترتیب L1/مشترکہ میموری ہوتی ہے جیسا کہ اوپر دی گئی تصویر میں دکھایا گیا ہے۔ رجسٹر میں فعال کمپیوٹیشنز کے لیے آپریشنز ہوتے ہیں، یعنی ڈیٹا جس پر GPU کور فی الحال کام کر رہا ہے۔

SM فکسڈ سائز گروپس میں تھریڈ چلاتا ہے: تانے دھاگےہر وارپ میں بالکل 32 تھریڈز ہوتے ہیں جو لاک سٹیپ میں انہی ہدایات پر عمل کرتے ہیں۔ L1/مشترکہ میموری ایک اسٹیجنگ ایریا کے طور پر کام کرتی ہے جو SM کے اندر تھریڈز کو سست میموری کے درجے پر جانے کے بغیر ڈیٹا شیئر کرنے کی اجازت دیتی ہے۔

بلیک ویل کی L1/مشترکہ میموری ڈیفالٹ 128KB فی SM ہے، جو Hopper کی 256KB سے کم ہے۔ کچھ کنفیگریشنز میں، یہ 228 KB فی SM تک پیمانہ ہو سکتا ہے۔ تمام SMs کی کل بینڈوتھ تقریباً 40 TB/s ہے۔

زوال کیوں؟ NVIDIA نے Tensor Core کام کے بوجھ کے لیے TMEM کی صلاحیت کو منتقل کر دیا اور ایک بڑے L2 کیشے سے معاوضہ دیا گیا۔ عام مقصد کے مشترکہ میموری ورک بوجھ میں فی SM کم صلاحیت ہوتی ہے، لیکن سب سے اہم کام کا بوجھ، میٹرکس ضرب، تیز رفتار وقف میموری حاصل کرتا ہے۔

L2 کیشے: چھوٹے L1 کی تکمیل کرتا ہے۔

L2 کیشے SM اور HBM کے درمیان واقع ہے اور ڈائی پر موجود تمام کمپیوٹنگ ڈیوائسز کے ذریعے اس کا اشتراک کیا جاتا ہے۔ بلیک ویل 64-65MB فی ڈائی فراہم کرتا ہے (تقریباً 126MB تمام ڈوئل ڈائی ماڈیولز میں)۔ یہ Hopper کے 50MB کے مقابلے میں 2.5x اضافہ ہے اور چھوٹے L1 فی SM کی تلافی کرتا ہے۔

AI کام کے بوجھ میں، ان پٹ کے مختلف بیچوں میں ایک ہی ماڈل کے وزن تک بار بار رسائی حاصل کی جاتی ہے۔ ایک بڑے L2 کیشے کا مطلب ہے کہ ان میں سے زیادہ وزن کو تعیناتیوں کے درمیان چپ پر رکھا جا سکتا ہے، جس سے HBM میں مہنگی چالوں کی بچت ہوتی ہے۔ انفرنس سرونگ کے لیے جہاں ایک ہی ماڈل ہزاروں درخواستوں پر کارروائی کرتا ہے، یہ براہ راست کم تاخیر اور بڑھے ہوئے تھرو پٹ کا ترجمہ کرتا ہے۔

ڈوئل ڈائی ڈیزائن یہاں پیچیدگی کو متعارف کرایا ہے۔ ہر ڈائی کا اپنا 63MB L2 پارٹیشن ہوتا ہے۔ دیگر ڈائز پر کیش کردہ ڈیٹا تک رسائی کے لیے NV-HBI انٹر کنیکٹ کو 10TB/s کی رفتار سے عبور کرنے کی ضرورت ہوتی ہے، جو کہ مقامی L2 رسائی سے اب بھی سست ہے۔ NVIDIA کا سافٹ ویئر اسٹیک اس کو شفاف طریقے سے ہینڈل کرتا ہے، لیکن کارکردگی سے آگاہ انجینئرز کو آگاہ ہونا چاہیے کہ ڈائی بھر میں ڈیٹا کی جگہ کا تعین کیش کی کارکردگی کو متاثر کر سکتا ہے۔

HBM3e: مین میموری پول

ہائی بینڈوڈتھ میموری (HBM3e) ماڈل کے وزن، ایکٹیویشن، گریڈیئنٹس، اور ان پٹ ڈیٹا کے لیے بنیادی اسٹوریج کے طور پر کام کرتی ہے۔ بلیک ویل کا HBM3e 8TB/s بینڈوتھ فی GPU فراہم کرتا ہے، جو Hopper کے 3.35TB/s HBM3 سے تقریباً 2.4x تیز ہے۔

فزیکل نفاذ 8-Hi اسٹیک ڈیزائن کا استعمال کرتا ہے۔ اس کا مطلب ہے کہ آٹھ DRAM ڈیز عمودی طور پر اسٹیک کیے گئے ہیں ہر ایک 24GB فی اسٹیک کے لیے 3GB فراہم کرے گا۔ کل 8 اسٹیک (4 فی ڈائی) کے ساتھ، B200 GPU 192GB آن پیکج میموری پیش کرتا ہے، لیکن جب ECC اور سسٹم اوور ہیڈ کو مدنظر رکھا جائے تو 180GB دستیاب ہے۔

بینڈوتھ میں یہ اضافہ بہت اہم ہے۔ ٹینسر کور آپریشنز ڈیٹا کو زبردست شرحوں پر استعمال کر سکتے ہیں۔ اگر HBM تیزی سے ڈیٹا ڈیلیور نہیں کر سکتا، تو کمپیوٹنگ ڈیوائس منجمد ہو جائے گی، جس سے مہنگا سلیکون بیکار ہو جائے گا۔ بلیک ویل کا 8TB/s سب سے بڑے میٹرکس ضرب کے دوران بھی ٹینسر کور کو فیڈ کرتا رہتا ہے۔

LPDDR5X: توسیعی تہہ

GPU پر HBM کے علاوہ، Grace CPU پر LPDDR5X میموری ہے۔ یہ میموری تقریباً 480GB تک مقامی طور پر 500GB/s تک اور ~900GB/s تک قابل رسائی ہے جب GPU سے NVLink C-2-C کے ذریعے رسائی حاصل کی جاتی ہے۔

GPU پر LPDDR5X تک رسائی میں HBM کے مقابلے میں تقریباً 10x کم بینڈوتھ اور زیادہ تاخیر ہوتی ہے۔ تاہم، یہ NVMe SSD یا نیٹ ورک اسٹوریج سے کہیں زیادہ تیز ہے۔

LPDDR5X ایک تیز رفتار اوور فلو پرت کے طور پر کام کرتا ہے۔ وہ ڈیٹا جو HBM میں فٹ نہیں ہوتا ہے، جیسے بڑے ایمبیڈنگ ٹیبلز، طویل سیاق و سباق کے تخمینے کے لیے KV کیچز، اور چیک پوائنٹ بفرز، کارکردگی میں نمایاں کمی کے بغیر CPU میموری میں رہ سکتے ہیں۔

اصل ڈیٹا کا بہاؤ

جب بلیک ویل GPUs AI کام کے بوجھ کو چلاتے ہیں، تو ڈیٹا مرحلہ وار اس درجہ بندی سے گزرتا ہے۔

-

ماڈل لوڈنگ: وزن کو اسٹوریج → CPU میموری → HBM سے منتقل کیا جاتا ہے (یا اگر HBM بھرا ہوا ہو تو LPDDR5X میں رکھا جاتا ہے)۔

-

بیچ پروسیسنگ: ڈیٹا سٹریم کو HBM میں اور پھر L2 میں داخل کریں جب SM کی طرف سے درخواست کی جائے۔

-

حساب لگانا: فعال ڈیٹا L2 → L1/Shared → ٹاسک ایگزیکیوشن کے مطابق رجسٹر سے منتقل ہوتا ہے۔

-

حساب: نتائج درجہ بندی کے ساتھ HBM یا CPU میموری میں واپس آتے ہیں۔

ہر پرت اپنے اوپر کی پرت کے لیے بفر کے طور پر کام کرتی ہے۔

حقیقی دنیا کی مثال: Llama 3 70B چلانا

ایکسٹرپولیشن کے لیے، Llama 3 70B کی تعیناتی پر غور کریں۔ FP16 درستگی پر (GB200 FP4 سے کم ہو سکتا ہے)، آپ کو صرف ماڈل کے وزن کے لیے تقریباً 140GB میموری کی ضرورت ہوگی۔

Hopper H100 (80GB HBM3): ماڈل فٹ نہیں ہے۔ آپ کو یا تو جارحانہ انداز میں کوانٹائز کرنے کی ضرورت ہے، متعدد GPUs میں ٹینسر کی ہم آہنگی کا استعمال کرنا ہوگا، یا PCIe کے ذریعے CPU میموری پر پرتوں کو آف لوڈ کرنا ہوگا (جو ~ 64GB/s پر سست ہے)۔

سنگل GB200 سپرچِپ (~360GB قابل استعمال HBM3e + ~480GB LPDDR5X): مکمل 140GB ماڈل آسانی سے ایک GPU پر HBM کو فٹ کر دیتا ہے، دوسرے GPU پر HBM اور KV کیشے، بیچ پروسیسنگ، یا متعدد ماڈل مثالوں کو چلانے کے لیے دستیاب تمام CPU میموری۔ کوئی ماڈل متوازی کی ضرورت نہیں ہے۔ یادداشت کی حدود کی وجہ سے جارحانہ کوانٹائزیشن پر مجبور نہیں کیا جاتا ہے۔ GB200 Superchip تخمینی خصوصیات فراہم کرتا ہے۔ دستیاب میموری کا 10x ایک H100 یکسر تبدیل کرتا ہے جو ایک ڈیوائس میں فٹ بیٹھتا ہے۔

یہ بلیک ویل میموری فن تعمیر کا حقیقی اثر ہے۔ جن ماڈلز کو پہلے ملٹی جی پی یو سیٹ اپ کی ضرورت ہوتی تھی وہ اب ایک ہی سپر چپ پر چل سکتے ہیں، تعیناتی کو آسان بنا کر اور انٹر-GPU کمیونیکیشن اوور ہیڈ کو کم کر سکتے ہیں۔

نتیجہ

AI ہارڈویئر میں میموری ہمیشہ سے ایک محدود عنصر رہی ہے۔ بلیک ویل مساوات کو تبدیل کرتا ہے۔

ڈوئل ڈائی GPUs، HBM3e کو 8TB/s بینڈوتھ کے ساتھ، اور NVLink C2C کے ذریعے مربوط CPU-GPU میموری کو ملا کر، NVIDIA نے ایک ایسا نظام فراہم کیا ہے جہاں ایک واحد سپر چپ اپنے پیشرو سے تقریباً 10 گنا زیادہ قابل استعمال میموری فراہم کرتی ہے۔ وہ ماڈل جن کو کبھی پیچیدہ ملٹی-GPU آرکیسٹریشن کی ضرورت ہوتی تھی اب ایک ہی ڈیوائس میں فٹ ہو جاتی ہے۔

AI انجینئرز کے لیے، اس کا مطلب ہے کہ میموری کی رکاوٹوں کو حل کرنے میں کم وقت گزارنا اور بہتر ماڈلز کی تعمیر میں زیادہ وقت۔ فن تعمیر نہ صرف تیز تر ہے بلکہ اس کے ساتھ کام کرنے میں بنیادی طور پر آسان بھی ہے۔

جیسا کہ ماڈل بڑھتا ہی جا رہا ہے، بلیک ویل کا میموری-پہلا ڈیزائن فلسفہ اس طرف اشارہ کرتا ہے کہ GPU فن تعمیر کہاں جا رہے ہیں: سخت انضمام، متحد میموری پولز، اور انتہائی اہم کام کے بوجھ کے لیے خصوصی ہارڈ ویئر۔

حوالہ جات

-

NVIDIA بلیک ویل آرکیٹیکچر تکنیکی مختصر: https://resources.nvidia.com/en-us-blackwell-architecture

-

NVIDIA بلیک ویل آرکیٹیکچر: ایک گہری غوطہ: https://medium.com/@kvnagesh/nvidia-blackwell-architecture-a-deep-dive-into-the-next- Generation-of-ai-computing-79c2b1ce3c1b

-

AI سسٹمز پرفارمنس انجینئرنگ: https://learning.oreilly.com/library/view/ai-systems-performance/9798341627772/

-

GPU کی میموری کا درجہ بندی**:** https://www.arccompute.io/arc-blog/gpu-101-memory-hierarchy

-

GPU میموری بینڈوتھ اور کارکردگی پر اس کا اثر: https://www.digitalocean.com/community/tutorials/gpu-memory-bandwidth

-

AI سسٹمز گیم: https://medium.com/@adi.fu7/the-ai-systems-game-are-chip-to-chip-interconnects-the-future-of-inference-ec3bbda53eb3

-

CUDA GPU میموری کی اقسام: https://medium.com/@jghaly00/cuda-gpu-memory-types-a07428b3eb16